Trong phân tích hồi quy, một lỗi rất thường gặp nhưng cũng rất dễ bị bỏ qua là mối tương quan quá mạnh giữa các biến độc lập. Khi mới học phân tích dữ liệu, nhiều người chỉ nhìn vào R² cao rồi cho rằng mô hình tốt, nhưng thực tế mô hình vẫn có thể gặp vấn đề nghiêm trọng. Vì vậy, câu hỏi multicollinearity là gì luôn là nội dung cần hiểu sớm nếu bạn muốn đọc đúng kết quả hồi quy và tránh diễn giải sai.

Nói đơn giản, multicollinearity là gì? Đây là hiện tượng các biến độc lập trong cùng một mô hình hồi quy có quan hệ tuyến tính chặt chẽ với nhau. Khi đó, mô hình gặp khó khăn trong việc tách riêng tác động của từng biến lên biến phụ thuộc. Kết quả là hệ số hồi quy có thể trở nên kém ổn định, sai số chuẩn tăng lên và kiểm định ý nghĩa thống kê dễ cho kết luận sai.

Nếu bạn đang tìm hiểu đa cộng tuyến là gì, hiện tượng đa cộng tuyến, kiểm định đa cộng tuyến hay cách xử lý đa cộng tuyến, bài viết này sẽ đi thẳng vào bản chất vấn đề, các dấu hiệu nhận biết phổ biến và cách đọc chỉ số VIF, tolerance trong SPSS một cách dễ hiểu.

Mục lục

ToggleMulticollinearity trong mô hình hồi quy là gì?

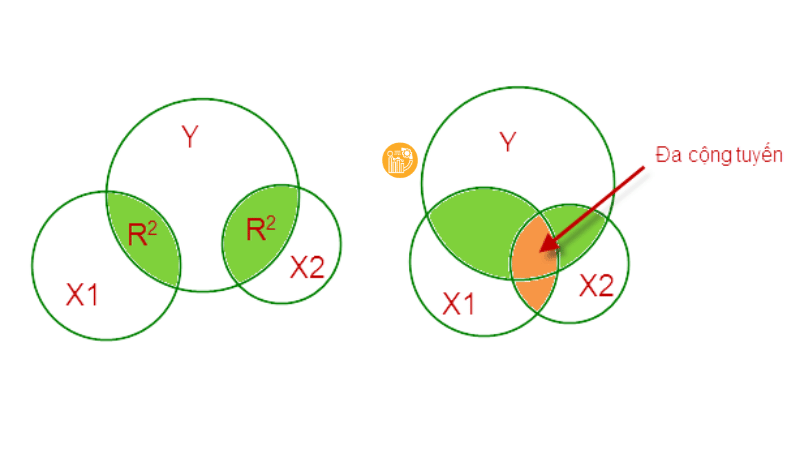

Để trả lời đúng multicollinearity là gì, trước hết cần nhớ rằng mô hình hồi quy tuyến tính giả định các biến độc lập không được phụ thuộc tuyến tính quá mạnh vào nhau. Khi một biến có thể được giải thích khá tốt bởi một hoặc nhiều biến độc lập còn lại, mô hình rơi vào trạng thái đa cộng tuyến trong hồi quy.

Hiểu theo cách đời thường, nếu hai biến gần như đang “nói cùng một điều”, mô hình sẽ khó biết nên phân bổ ảnh hưởng cho biến nào. Đây chính là bản chất của câu hỏi multicollinearity là gì. Vấn đề không nằm ở mối quan hệ giữa biến độc lập với biến phụ thuộc, mà nằm ở mối quan hệ giữa chính các biến độc lập với nhau.

Ví dụ, trong một mô hình giải thích lợi nhuận quỹ đầu tư, nếu bạn cùng lúc đưa chỉ số tăng trưởng S&P 500, chỉ số giá trị S&P 500 và thêm cả chỉ số S&P 500 tổng hợp, thì khả năng cao sẽ xuất hiện hiện tượng đa cộng tuyến. Lý do là chỉ số tổng hợp đã phản ánh phần lớn thông tin của hai chỉ số thành phần.

Vì sao hiện tượng đa cộng tuyến xuất hiện?

Khi tìm hiểu multicollinearity là gì, bạn cũng cần biết nguyên nhân thường gặp của nó. Hiện tượng này thường xuất hiện trong các tình huống sau:

- Đưa vào mô hình nhiều biến có nội dung đo lường gần giống nhau.

- Sử dụng đồng thời biến gốc và biến được biến đổi từ chính nó.

- Dùng nhiều chỉ số tổng hợp và chỉ số thành phần trong cùng một mô hình.

- Dữ liệu có xu hướng biến động cùng chiều mạnh trong thời gian dài.

- Mẫu nghiên cứu nhỏ nhưng số lượng biến độc lập lại nhiều.

Đây là lý do vì sao khi học đa cộng tuyến là gì, người làm phân tích dữ liệu không nên chỉ tập trung vào kỹ thuật chạy mô hình mà còn phải hiểu logic chọn biến. Một mô hình nhiều biến chưa chắc tốt hơn mô hình gọn, nếu các biến đó chồng lấn thông tin.

Tác động của đa cộng tuyến trong hồi quy

Phần quan trọng nhất sau khi hiểu multicollinearity là gì là nhận ra hậu quả của nó. Về mặt lý thuyết, đa cộng tuyến không nhất thiết làm cho ước lượng OLS bị chệch. Tuy nhiên, nó khiến các ước lượng trở nên thiếu chính xác và khó tin cậy hơn khi diễn giải.

Cụ thể, tác động phổ biến của đa cộng tuyến trong hồi quy gồm:

- Sai số chuẩn của hệ số hồi quy tăng lên.

- t-statistic giảm xuống, khiến biến dễ mất ý nghĩa thống kê.

- Dấu của hệ số có thể trở nên bất thường hoặc trái kỳ vọng.

- Hệ số hồi quy nhạy cảm mạnh khi thêm hoặc bớt một biến.

- Khó xác định ảnh hưởng riêng của từng biến độc lập.

Đây là điểm rất quan trọng khi giải thích multicollinearity là gì. Mô hình có thể vẫn cho R² cao, nghĩa là nhìn tổng thể vẫn giải thích được biến phụ thuộc, nhưng từng hệ số riêng lẻ lại không còn đáng tin. Điều này đặc biệt nguy hiểm nếu bạn dùng kết quả hồi quy để đưa ra kết luận quản trị hoặc khuyến nghị chính sách.

Dấu hiệu nhận biết đa cộng tuyến

Một trong những dấu hiệu nhận biết đa cộng tuyến kinh điển là: R² của mô hình khá cao nhưng nhiều hệ số riêng lẻ lại không có ý nghĩa thống kê. Đây cũng là dấu hiệu được nhắc đến rất nhiều khi người học hỏi multicollinearity là gì.

Bạn có thể nghi ngờ hiện tượng đa cộng tuyến khi gặp các biểu hiện sau:

- Mô hình có R² cao nhưng các t-test của nhiều biến lại không có ý nghĩa.

- Sai số chuẩn lớn bất thường so với kỳ vọng.

- Hệ số hồi quy thay đổi mạnh khi thêm hoặc bỏ một biến có liên quan.

- Các biến độc lập có tương quan cặp cao.

- Kết quả hồi quy trái logic thực tiễn dù dữ liệu có vẻ hợp lý.

Như vậy, khi ai đó hỏi multicollinearity là gì, câu trả lời đầy đủ không chỉ là định nghĩa mà còn phải gắn với biểu hiện thực tế trong bảng kết quả hồi quy.

Ví dụ dễ hiểu về hiện tượng đa cộng tuyến

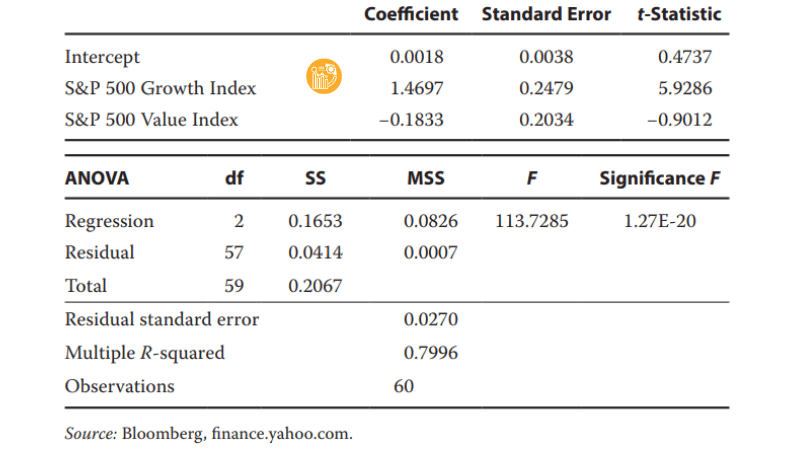

Dựa trên ví dụ trong bài gốc, giả sử ta hồi quy lợi nhuận của quỹ Fidelity Select Technology Portfolio (FSPTX) theo chỉ số tăng trưởng S&P 500 và chỉ số giá trị S&P 500 trong giai đoạn 01/2009 đến 12/2013. Kết quả đầu tiên cho thấy R² đạt khoảng 0,7996, tức gần 80% biến động lợi nhuận quỹ được giải thích bởi hai biến này.

Ở mô hình này, chỉ số tăng trưởng có t-statistic lớn và có ý nghĩa thống kê, còn chỉ số giá trị thì không đáng kể. Điều đó cho thấy mô hình vẫn hoạt động tương đối ổn khi chỉ dùng hai biến.

Nhưng khi thêm tiếp chỉ số S&P 500 tổng hợp vào mô hình, R² chỉ tăng nhẹ từ 0,7996 lên khoảng 0,8084. Mức tăng này gần như không đáng kể. Trong khi đó, sai số chuẩn của các hệ số tăng lên rõ rệt và các hệ số mất ý nghĩa thống kê. Đây là ví dụ rất điển hình để hiểu multicollinearity là gì trong thực hành: thêm biến không giúp giải thích tốt hơn bao nhiêu, nhưng lại làm mô hình khó diễn giải hơn.

Nói cách khác, chỉ số S&P 500 tổng hợp mang thông tin chồng lấn với hai chỉ số thành phần. Vì vậy, mô hình không thể phân định rạch ròi tác động riêng của từng biến. Đó chính là hiện tượng đa cộng tuyến ở dạng dễ nhận biết nhất.

Kiểm định đa cộng tuyến: hệ số VIF là gì?

Khi học multicollinearity là gì, bạn gần như chắc chắn sẽ gặp câu hỏi hệ số VIF là gì. VIF là viết tắt của Variance Inflation Factor, dùng để đo mức độ phương sai của hệ số hồi quy bị “phóng đại” lên do tương quan giữa các biến độc lập.

Nói ngắn gọn, VIF càng lớn thì nguy cơ đa cộng tuyến càng cao. Trong thực hành, nhiều tài liệu dùng các mốc tham khảo sau:

- VIF = 1: gần như không có đa cộng tuyến.

- 1 < VIF < 5: có tương quan nhưng thường chưa nghiêm trọng.

- VIF từ 5 trở lên: cần xem xét kỹ.

- VIF từ 10 trở lên: đa cộng tuyến mạnh, nên xử lý.

Vậy hệ số VIF là gì trong ý nghĩa thực tế? Nó không nói mô hình đúng hay sai hoàn toàn, mà cho bạn biết biến độc lập đó đang trùng lặp thông tin với các biến khác ở mức nào. Đây là bước rất quan trọng trong kiểm định đa cộng tuyến.

Tolerance trong SPSS là gì?

Bên cạnh VIF, người dùng SPSS còn rất hay hỏi tolerance trong SPSS là gì. Tolerance chính là nghịch đảo của VIF. Chỉ số này phản ánh tỷ lệ biến thiên của một biến độc lập không bị giải thích bởi các biến độc lập còn lại.

Thông thường:

- Tolerance càng nhỏ thì nguy cơ đa cộng tuyến càng lớn.

- Tolerance dưới 0,2 là mức cần chú ý.

- Tolerance dưới 0,1 thường được xem là dấu hiệu xấu.

Nếu bạn đang dùng SPSS và muốn hiểu sâu hơn multicollinearity là gì, hãy đọc VIF và tolerance cùng lúc thay vì chỉ nhìn một chỉ số. Đây là cách kiểm định đa cộng tuyến vừa nhanh vừa thực tế trong các bài nghiên cứu ứng dụng.

Cách xử lý đa cộng tuyến

Sau khi đã hiểu multicollinearity là gì và nhận diện được vấn đề, câu hỏi tiếp theo sẽ là cách xử lý đa cộng tuyến. Không có một công thức duy nhất cho mọi trường hợp, nhưng các hướng xử lý phổ biến gồm:

- Loại bớt biến độc lập bị trùng lặp thông tin. Đây là cách trực tiếp và thường hiệu quả nhất.

- Giữ lại biến có ý nghĩa lý thuyết mạnh hơn hoặc dễ diễn giải hơn.

- Gộp các biến tương đồng thành một chỉ số tổng hợp nếu phù hợp.

- Tăng kích thước mẫu nếu dữ liệu cho phép.

- Xem lại mô hình nghiên cứu để tránh đưa cả biến tổng và biến thành phần cùng lúc.

Trong ví dụ ở trên, cách xử lý đa cộng tuyến hợp lý là không đưa chỉ số S&P 500 tổng hợp vào nếu mô hình đã có chỉ số tăng trưởng và chỉ số giá trị. Lý do là chỉ số tổng hợp gần như phản ánh lại thông tin của hai biến kia, khiến mô hình bị chồng chéo.

Đây cũng là điểm rất thực tế khi trả lời multicollinearity là gì: giải pháp không chỉ nằm ở phần mềm mà nằm ở tư duy mô hình hóa. Nếu chọn biến đúng ngay từ đầu, bạn sẽ giảm đáng kể nguy cơ đa cộng tuyến trong hồi quy.

Một lưu ý quan trọng khi đọc kết quả hồi quy

Nhiều người mới học thường nghĩ rằng chỉ cần mô hình có R² cao thì kết quả đáng tin. Tuy nhiên, sau khi hiểu multicollinearity là gì, bạn sẽ thấy đây là suy nghĩ khá nguy hiểm. R² cao chỉ cho biết mô hình giải thích được bao nhiêu biến thiên của biến phụ thuộc, chứ không đảm bảo từng hệ số đều ổn để diễn giải.

Vì vậy, khi đọc kết quả hồi quy, đừng chỉ nhìn R². Hãy kiểm tra thêm t-statistic, sai số chuẩn, VIF, tolerance trong SPSS và cả logic lý thuyết giữa các biến. Đó mới là cách phân tích dữ liệu chắc tay và ít sai hơn.

Kết luận

Tóm lại, multicollinearity là gì? Đó là hiện tượng các biến độc lập trong mô hình hồi quy có quan hệ tuyến tính mạnh với nhau, làm cho việc ước lượng và diễn giải hệ số trở nên kém ổn định. Dù không luôn làm mô hình “sai”, nhưng nó khiến kết quả dễ nhiễu, giảm ý nghĩa thống kê và gây khó khăn khi rút ra kết luận.

Nếu bạn đang làm nghiên cứu, chạy SPSS hay viết luận văn, hãy luôn kiểm tra dấu hiệu nhận biết đa cộng tuyến, đọc VIF và tolerance cẩn thận, sau đó lựa chọn cách xử lý đa cộng tuyến phù hợp với mục tiêu nghiên cứu. Hiểu đúng multicollinearity là gì sẽ giúp bạn tránh được một trong những lỗi phổ biến nhất trong phân tích hồi quy.

Xem thêm các bài hướng dẫn tại xulysolieu.info hoặc liên hệ Xử lý số liệu qua số 0878968468 để được hỗ trợ phân tích dữ liệu, kiểm định mô hình và xử lý kết quả SPSS.