Các phương pháp hồi quy phổ biến trong nghiên cứu khoa học

Trong nghiên cứu khoa học và phân tích dữ liệu, việc lựa chọn đúng phương pháp hồi quy và đúng dạng mô hình hồi quy có ý nghĩa quyết định đến chất lượng kết quả. Mỗi phương pháp hồi quy không chỉ khác nhau về mục tiêu sử dụng mà còn có các dạng mô hình hồi quy đặc trưng, giúp người nghiên cứu linh hoạt trong việc mô tả và dự đoán mối quan hệ giữa các biến.

Phương pháp hồi quy là gì?

Phương pháp hồi quy là tập hợp các kỹ thuật thống kê dùng để mô hình hóa mối quan hệ giữa một biến phụ thuộc và một hoặc nhiều biến độc lập. Thông qua phương pháp hồi quy, nhà nghiên cứu có thể xây dựng mô hình thống kê nhằm giải thích cơ chế tác động hoặc dự đoán giá trị của biến kết quả.

Trong phân tích dữ liệu, phương pháp hồi quy được xem là nền tảng cho nhiều mô hình thống kê và mô hình dự báo hiện đại.

Hồi quy tuyến tính (Linear Regression)

Khái niệm

Hồi quy tuyến tính là phương pháp hồi quy dùng để mô tả mối quan hệ tuyến tính giữa biến phụ thuộc liên tục và các biến độc lập. Đây là phương pháp hồi quy cơ bản nhất và thường được sử dụng đầu tiên trong phân tích dữ liệu.

Các dạng mô hình hồi quy tuyến tính

- Hồi quy tuyến tính đơn: chỉ có một biến độc lập, mô tả mối quan hệ tuyến tính đơn giản giữa hai biến.

- Hồi quy tuyến tính đa biến: có từ hai biến độc lập trở lên, mỗi biến phản ánh một yếu tố tác động đến biến phụ thuộc.

- Hồi quy tuyến tính có biến giả: kết hợp biến định tính đã mã hóa (dummy variables) vào mô hình.

Ứng dụng

Hồi quy tuyến tính được sử dụng rộng rãi trong kinh tế, tài chính, giáo dục và khoa học xã hội, ví dụ dự đoán doanh thu, điểm số, chi phí hoặc mức tiêu thụ.

Hồi quy đa tuyến và hồi quy đa biến

Khái niệm

Hồi quy đa tuyến là một dạng quan trọng của hồi quy đa biến, trong đó biến phụ thuộc chịu ảnh hưởng đồng thời của nhiều biến độc lập và mối quan hệ vẫn mang tính tuyến tính.

Các dạng mô hình hồi quy đa biến

- Hồi quy đa tuyến chuẩn: tất cả biến độc lập tham gia trực tiếp vào mô hình.

- Hồi quy từng bước (Stepwise Regression): lựa chọn biến tự động dựa trên tiêu chí thống kê.

- Hồi quy phân cấp (Hierarchical Regression): đưa biến vào mô hình theo từng khối dựa trên lý thuyết.

- Hồi quy Ridge và Lasso: hồi quy có điều chuẩn, dùng khi xuất hiện đa cộng tuyến.

Ứng dụng

Hồi quy đa biến thường được sử dụng trong y học, kinh tế và khoa học xã hội khi hiện tượng nghiên cứu chịu tác động của nhiều yếu tố cùng lúc.

Hồi quy logistic

Khái niệm

Hồi quy logistic là phương pháp hồi quy dùng khi biến phụ thuộc là biến nhị phân. Mô hình này không dự đoán trực tiếp giá trị mà dự đoán xác suất xảy ra của một sự kiện.

Các dạng mô hình hồi quy logistic

- Hồi quy logistic nhị phân: biến phụ thuộc có hai trạng thái (0/1).

- Hồi quy logistic đa biến: nhiều biến độc lập cùng tác động đến biến nhị phân.

- Hồi quy logistic thứ tự (Ordinal Logistic): biến phụ thuộc có thứ bậc.

- Hồi quy logistic đa danh (Multinomial Logistic): biến phụ thuộc có nhiều nhóm không thứ tự.

Ứng dụng

Hồi quy logistic được sử dụng rộng rãi trong y học, marketing và khoa học xã hội để phân tích dữ liệu nhị phân và xây dựng mô hình dự báo hành vi.

Hồi quy phi tuyến (Nonlinear Regression)

Khái niệm

Hồi quy phi tuyến được sử dụng khi mối quan hệ giữa biến phụ thuộc và biến độc lập không tuân theo dạng đường thẳng.

Các dạng mô hình hồi quy phi tuyến

- Hồi quy đa thức: sử dụng các bậc cao của biến độc lập.

- Hồi quy hàm mũ: mô hình hóa tốc độ tăng hoặc giảm theo cấp số nhân.

- Hồi quy logarit: mô tả mối quan hệ tăng chậm dần.

- Mô hình tăng trưởng: thường dùng trong sinh học và kinh tế.

Ứng dụng

Hồi quy phi tuyến phổ biến trong khoa học tự nhiên, môi trường và sinh học, nơi các mối quan hệ thường phức tạp và không tuyến tính.

Hồi quy Bayesian

Khái niệm

Hồi quy Bayesian là phương pháp hồi quy dựa trên thống kê Bayesian, kết hợp dữ liệu quan sát với thông tin tiên nghiệm để ước lượng tham số.

Các dạng mô hình hồi quy Bayesian

- Hồi quy tuyến tính Bayesian: phiên bản Bayesian của hồi quy tuyến tính.

- Hồi quy logistic Bayesian: áp dụng cho biến nhị phân.

- Mô hình Bayesian phân cấp: xử lý dữ liệu có cấu trúc nhiều cấp.

Ứng dụng

Hồi quy Bayesian được sử dụng khi dữ liệu hạn chế hoặc cần tích hợp kiến thức chuyên gia vào mô hình thống kê.

Hồi quy cây quyết định (Decision Tree Regression)

Khái niệm

Hồi quy cây quyết định là phương pháp hồi quy phi tham số, sử dụng cấu trúc cây để phân chia dữ liệu thành các nhóm đồng nhất.

Các dạng mô hình hồi quy cây

- CART Regression Tree: cây hồi quy phổ biến nhất.

- Random Forest Regression: tập hợp nhiều cây để tăng độ chính xác.

- Gradient Boosting Regression: mô hình tăng cường dự báo.

Ứng dụng

Hồi quy cây quyết định được sử dụng trong tài chính, quản trị rủi ro và phân tích dữ liệu lớn nhờ khả năng diễn giải trực quan.

Kết luận

Các phương pháp hồi quy đóng vai trò trung tâm trong nghiên cứu khoa học và phân tích dữ liệu. Việc phân biệt rõ từng phương pháp hồi quy và các dạng mô hình hồi quy tương ứng giúp nhà nghiên cứu lựa chọn đúng công cụ, xây dựng mô hình thống kê phù hợp và nâng cao độ chính xác của kết quả.

Sai số chuẩn (Standard Error): Khái niệm và cách sử dụng

Trong phân tích dữ liệu và thống kê suy luận, bên cạnh các chỉ số quen thuộc như trung bình hay độ lệch chuẩn, sai số chuẩn là một khái niệm rất quan trọng nhưng thường bị hiểu nhầm. Việc nắm rõ sai số chuẩn là gì giúp người nghiên cứu đánh giá mức độ tin cậy của các ước lượng thống kê, đặc biệt là khi suy rộng kết quả từ mẫu ra tổng thể.

Sai số chuẩn là gì?

Sai số chuẩn là gì? Sai số chuẩn, trong tiếng Anh gọi là standard error, là thước đo phản ánh mức độ biến động của một ước lượng thống kê (thường là trung bình mẫu) so với giá trị thực của tổng thể. Nói cách khác, sai số chuẩn cho biết trung bình mẫu có thể “dao động” bao nhiêu nếu ta lặp lại việc lấy mẫu nhiều lần từ cùng một tổng thể.

Khi nhắc đến sai số chuẩn là gì trong bối cảnh phổ biến nhất, người ta thường nói đến sai số chuẩn của giá trị trung bình (Standard Error of the Mean – SEM). Chỉ số này cho biết mức độ chính xác của trung bình mẫu trong việc đại diện cho trung bình tổng thể.

Bản chất của sai số chuẩn trong thống kê

Để hiểu sâu sai số chuẩn là gì, cần phân biệt rõ giữa độ lệch chuẩn và sai số chuẩn. Độ lệch chuẩn mô tả mức độ phân tán của các quan sát trong một mẫu dữ liệu. Trong khi đó, sai số chuẩn mô tả mức độ không chắc chắn của một ước lượng thống kê.

Nói một cách đơn giản:

- Độ lệch chuẩn phản ánh sự phân tán của dữ liệu.

- Sai số chuẩn phản ánh độ chính xác của ước lượng trung bình.

Chính vì vậy, trong thống kê suy luận, sai số chuẩn đóng vai trò trung tâm khi xây dựng khoảng tin cậy và kiểm định giả thuyết.

Công thức tính sai số chuẩn của giá trị trung bình

Khi tìm hiểu sai số chuẩn là gì, công thức tính là nội dung không thể bỏ qua. Sai số chuẩn của giá trị trung bình được tính dựa trên độ lệch chuẩn của mẫu và kích thước mẫu.

Công thức:

SEM = SD / √N

Trong đó:

- SEM là sai số chuẩn của giá trị trung bình

- SD là độ lệch chuẩn của mẫu

- N là kích thước mẫu

Công thức này cho thấy sai số chuẩn giảm khi kích thước mẫu tăng. Điều này giải thích vì sao các nghiên cứu với cỡ mẫu lớn thường cho kết quả ước lượng chính xác hơn.

Ý nghĩa của sai số chuẩn là gì trong thống kê suy luận?

Sai số chuẩn là gì và vì sao nó quan trọng trong thống kê suy luận? Câu trả lời nằm ở khả năng suy rộng kết quả từ mẫu ra tổng thể.

Sai số chuẩn cho phép người nghiên cứu:

- Đánh giá độ tin cậy của trung bình mẫu.

- Xây dựng khoảng tin cậy cho trung bình tổng thể.

- Thực hiện kiểm định giả thuyết về trung bình.

Một sai số chuẩn nhỏ cho thấy trung bình mẫu là ước lượng tốt của trung bình tổng thể. Ngược lại, sai số chuẩn lớn cho thấy mức độ không chắc chắn cao hơn.

Sai số chuẩn và khoảng tin cậy

Một trong những ứng dụng quan trọng nhất khi hiểu sai số chuẩn là gì chính là xây dựng khoảng tin cậy. Khoảng tin cậy cho trung bình tổng thể thường được tính dựa trên trung bình mẫu cộng trừ một bội số của sai số chuẩn.

Ví dụ, với khoảng tin cậy 95%, công thức tổng quát thường là:

Trung bình mẫu ± 1,96 × SEM

Trong đó, SEM chính là sai số chuẩn. Nếu sai số chuẩn nhỏ, khoảng tin cậy sẽ hẹp hơn, thể hiện độ chính xác cao hơn của ước lượng trung bình.

So sánh sai số chuẩn và độ lệch chuẩn

Nhiều người mới học thống kê thường nhầm lẫn giữa hai khái niệm này. Để làm rõ sai số chuẩn là gì, cần nhấn mạnh sự khác biệt cơ bản:

- Độ lệch chuẩn đo mức độ phân tán của dữ liệu trong mẫu.

- Sai số chuẩn đo mức độ biến động của trung bình mẫu.

Về mặt số học, sai số chuẩn luôn nhỏ hơn độ lệch chuẩn, vì SEM = SD / √N. Khi kích thước mẫu tăng, sai số chuẩn giảm, trong khi độ lệch chuẩn của dữ liệu không nhất thiết thay đổi.

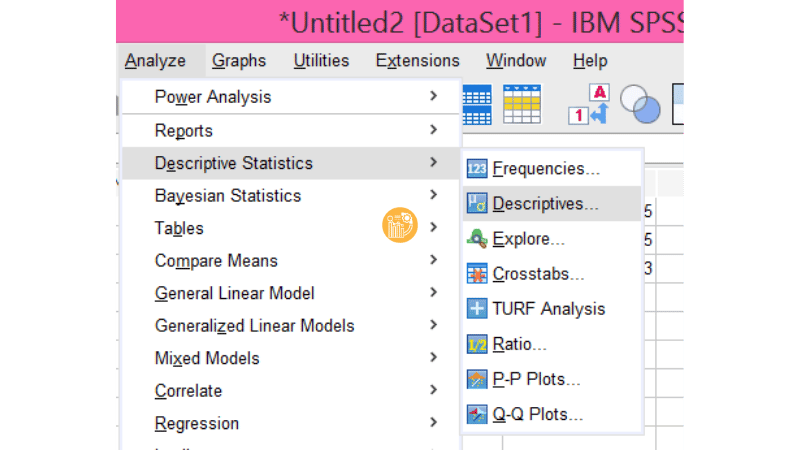

Tính sai số chuẩn trong SPSS

Trong thực hành phân tích dữ liệu, nhiều người quan tâm sai số chuẩn là gì trong phần mềm SPSS và cách tính nó như thế nào. SPSS cho phép tính sai số chuẩn một cách trực quan thông qua thống kê mô tả.

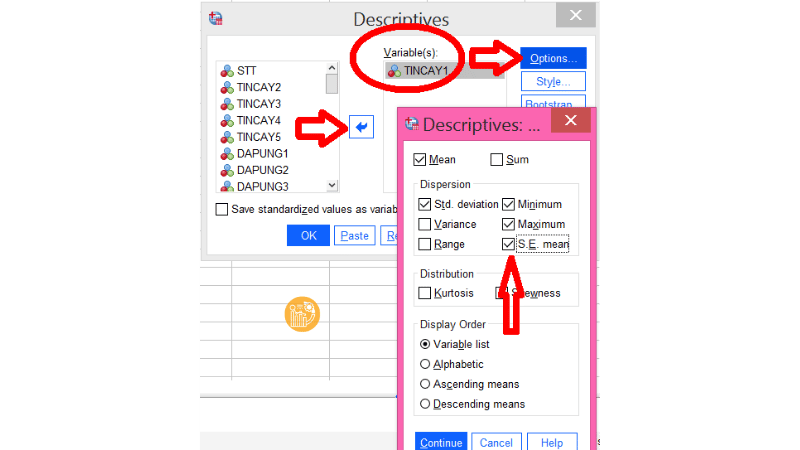

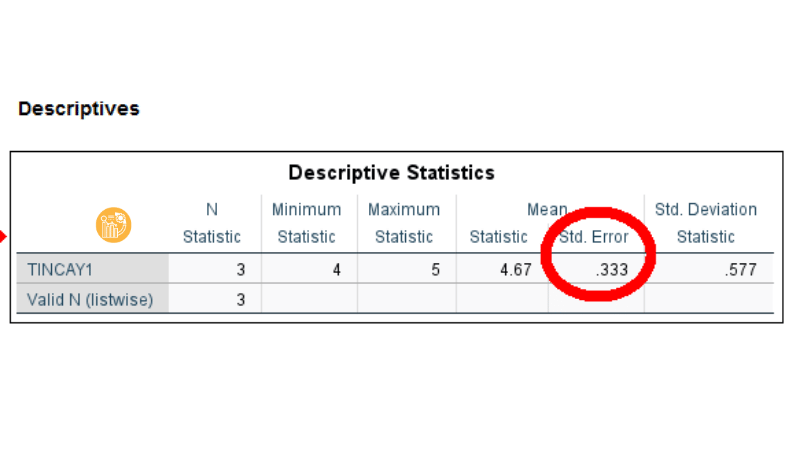

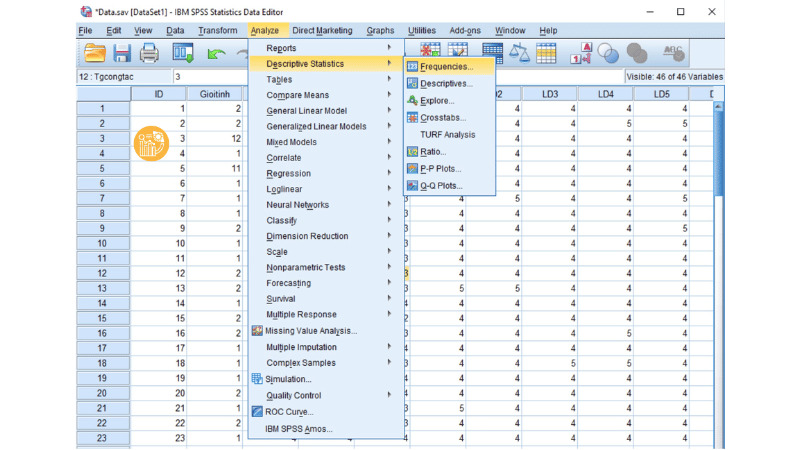

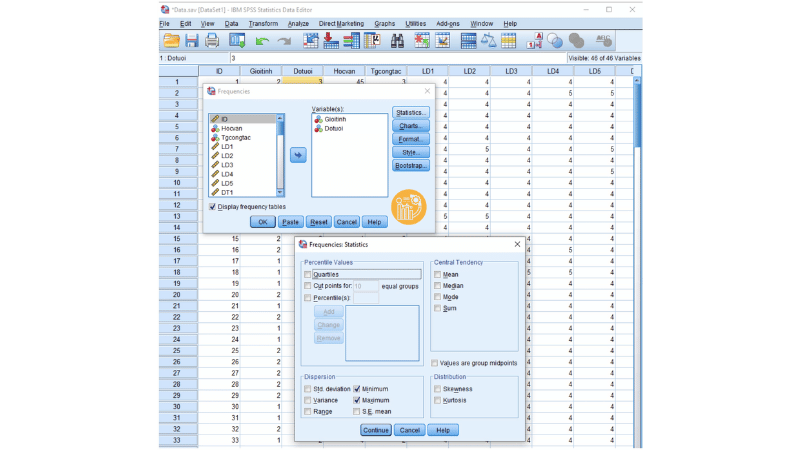

Các bước cơ bản:

- Mở SPSS và nạp bộ dữ liệu.

- Chọn Analyze trên thanh menu.

- Chọn Descriptive Statistics và tiếp tục chọn Descriptives.

- Đưa biến quan tâm vào ô Variable(s).

- Chọn Options và tích chọn Std. Error of Mean.

- Nhấn Continue và OK để xem kết quả.

Kết quả hiển thị trong bảng sẽ bao gồm sai số chuẩn của giá trị trung bình, giúp người dùng nhanh chóng đánh giá độ tin cậy của trung bình mẫu.

Ứng dụng của sai số chuẩn trong phân tích dữ liệu

Khi đã hiểu rõ sai số chuẩn là gì, bạn sẽ thấy chỉ số này xuất hiện rất nhiều trong các báo cáo và nghiên cứu khoa học. Một số ứng dụng phổ biến bao gồm:

- Ước lượng trung bình tổng thể từ dữ liệu mẫu.

- So sánh độ chính xác của các nghiên cứu với cỡ mẫu khác nhau.

- Phân tích kết quả thí nghiệm và khảo sát.

- Trình bày kết quả thống kê suy luận một cách khoa học.

Trong phân tích dữ liệu, việc báo cáo trung bình kèm sai số chuẩn giúp người đọc hiểu rõ mức độ chắc chắn của kết quả, thay vì chỉ nhìn vào một con số trung bình đơn lẻ.

Những lưu ý khi sử dụng sai số chuẩn

Mặc dù sai số chuẩn là chỉ số rất hữu ích, nhưng khi áp dụng cần lưu ý một số điểm:

- Sai số chuẩn không phản ánh mức độ phân tán của dữ liệu.

- Không nên dùng sai số chuẩn để mô tả dữ liệu thô.

- Cần phân biệt rõ sai số chuẩn và độ lệch chuẩn trong báo cáo.

- Sai số chuẩn phụ thuộc mạnh vào kích thước mẫu.

Hiểu đúng sai số chuẩn là gì sẽ giúp tránh những diễn giải sai trong phân tích và trình bày kết quả.

Kết luận

Sai số chuẩn là gì? Đây là một khái niệm nền tảng trong thống kê suy luận, giúp đánh giá độ chính xác của ước lượng trung bình và hỗ trợ xây dựng khoảng tin cậy. Việc nắm vững bản chất của standard error giúp người làm phân tích dữ liệu đưa ra kết luận chặt chẽ và đáng tin cậy hơn.

Trong thực tế nghiên cứu và phân tích dữ liệu, sai số chuẩn luôn đi kèm với trung bình mẫu để phản ánh mức độ không chắc chắn của kết quả. Do đó, hiểu và sử dụng đúng sai số chuẩn là gì là kỹ năng không thể thiếu đối với sinh viên, nhà nghiên cứu và người làm phân tích dữ liệu.

Phương sai (Variance) là gì? Công thức và ý nghĩa thống kê

Trong thống kê, khi phân tích dữ liệu định lượng, ngoài việc quan tâm đến giá trị trung bình, người nghiên cứu còn cần đánh giá mức độ phân tán của dữ liệu. Một trong những thước đo quan trọng nhất phản ánh mức độ này chính là phương sai. Hiểu rõ công thức phương sai giúp người học thống kê và người làm phân tích dữ liệu định lượng đánh giá chính xác mức độ biến động của tập dữ liệu, từ đó đưa ra nhận định và quyết định phù hợp.

Bài viết này do xulysolieu.info (Xử lý số liệu) biên soạn, nhằm giải thích rõ ràng phương sai là gì, bản chất của variance, công thức phương sai và cách diễn giải ý nghĩa của nó trong thống kê mô tả và phân tích dữ liệu.

Phương sai (Variance) là gì?

Phương sai, trong tiếng Anh là variance, là một đại lượng thống kê dùng để đo mức độ phân tán dữ liệu xung quanh giá trị trung bình. Nói cách khác, phương sai cho biết các giá trị trong tập dữ liệu nằm xa hay gần giá trị trung bình đến mức nào.

Trong thống kê, phương sai thường được ký hiệu là σ² đối với tổng thể và s² đối với mẫu. Đây là một chỉ tiêu cốt lõi trong thống kê mô tả, được sử dụng rộng rãi trong nhiều lĩnh vực như kinh tế, tài chính, y học và khoa học xã hội.

Khi nhắc đến công thức phương sai, cần hiểu rằng đây không chỉ là một phép tính kỹ thuật mà còn là công cụ để đánh giá độ phân tán dữ liệu và mức độ biến động của hiện tượng nghiên cứu.

Ý nghĩa của phương sai trong thống kê mô tả

Trong thống kê mô tả, phương sai giúp trả lời câu hỏi: dữ liệu có phân tán nhiều hay không? Hai tập dữ liệu có cùng giá trị trung bình nhưng phương sai khác nhau sẽ phản ánh mức độ biến động hoàn toàn khác nhau.

Một phương sai lớn cho thấy dữ liệu phân tán mạnh, các giá trị nằm xa trung bình và mức độ biến động cao. Ngược lại, phương sai nhỏ cho thấy dữ liệu tập trung quanh trung bình và ít biến động. Nếu phương sai bằng 0, điều đó có nghĩa tất cả các giá trị trong tập dữ liệu là giống hệt nhau.

Do đó, công thức phương sai đóng vai trò quan trọng trong việc mô tả cấu trúc dữ liệu, đặc biệt khi phân tích dữ liệu định lượng.

Công thức phương sai

Về bản chất, công thức phương sai được xây dựng dựa trên khoảng cách giữa từng giá trị quan sát và giá trị trung bình của tập dữ liệu. Các bước tính toán được thực hiện theo trình tự logic nhằm đảm bảo mọi sai lệch đều được ghi nhận.

Các bước cơ bản của công thức phương sai bao gồm:

- Tính giá trị trung bình của tập dữ liệu.

- Xác định độ lệch của từng quan sát so với giá trị trung bình.

- Bình phương các độ lệch để loại bỏ dấu âm.

- Tính trung bình của các độ lệch bình phương.

Dạng tổng quát của công thức phương sai tổng thể:

σ² = Σ(xi − μ)² / n

Trong đó:

- xi là giá trị của quan sát thứ i

- μ là giá trị trung bình của tổng thể

- n là số lượng quan sát

Đây là công thức phương sai được sử dụng khi dữ liệu bao gồm toàn bộ tổng thể.

Công thức phương sai mẫu

Trong thực tế nghiên cứu, chúng ta thường chỉ có dữ liệu mẫu thay vì dữ liệu tổng thể. Khi đó, công thức phương sai cần được điều chỉnh để tránh ước lượng sai lệch.

Công thức phương sai mẫu được viết như sau:

s² = Σ(xi − x̄)² / (n − 1)

Việc chia cho (n − 1) thay vì n giúp ước lượng phương sai tổng thể không bị đánh giá thấp. Đây là điểm rất quan trọng khi áp dụng công thức phương sai trong phân tích dữ liệu định lượng.

Mối quan hệ giữa phương sai và độ lệch chuẩn

Một đặc điểm quan trọng của phương sai là đơn vị đo của nó là bình phương đơn vị của dữ liệu gốc, điều này khiến phương sai khó diễn giải trực tiếp. Vì lý do này, người ta thường sử dụng căn bậc hai của phương sai, gọi là độ lệch chuẩn.

Độ lệch chuẩn giúp đưa thước đo độ phân tán dữ liệu trở về cùng đơn vị với dữ liệu ban đầu, từ đó dễ hiểu và dễ trình bày hơn. Tuy vậy, công thức phương sai vẫn là nền tảng để tính toán và hiểu bản chất của độ lệch chuẩn.

Cách sử dụng phương sai trong phân tích dữ liệu định lượng

Trong phân tích dữ liệu định lượng, phương sai được sử dụng để:

- So sánh mức độ biến động giữa các tập dữ liệu.

- Đánh giá rủi ro trong các bài toán tài chính và đầu tư.

- Làm cơ sở cho nhiều công thức thống kê nâng cao.

- Kiểm tra giả định trong các mô hình phân tích.

Trong tài chính, phương sai lợi nhuận của tài sản là chỉ tiêu phản ánh mức độ rủi ro. Một tài sản có phương sai lợi nhuận cao thường đi kèm với mức biến động lớn, đồng nghĩa với rủi ro cao hơn.

Nhờ công thức phương sai, nhà phân tích có thể lượng hóa rủi ro và đưa ra chiến lược phân bổ tài sản hợp lý.

Ưu điểm của phương sai

Phương sai có nhiều ưu điểm trong thống kê mô tả:

- Xem xét toàn bộ sai lệch của các quan sát so với trung bình.

- Không bị triệt tiêu sai lệch do các giá trị âm và dương.

- Là nền tảng cho nhiều phương pháp phân tích thống kê.

Nhờ những đặc điểm này, công thức phương sai trở thành công cụ chuẩn trong phân tích độ phân tán dữ liệu.

Hạn chế của phương sai

Bên cạnh ưu điểm, phương sai cũng tồn tại một số hạn chế:

- Nhạy cảm với các giá trị ngoại lai do việc bình phương sai lệch.

- Khó diễn giải trực tiếp vì đơn vị đo bị bình phương.

- Ít được trình bày trực tiếp trong báo cáo thực tế.

Chính vì vậy, trong nhiều trường hợp, người phân tích sử dụng độ lệch chuẩn để trình bày, nhưng vẫn dựa trên công thức phương sai để tính toán.

Ví dụ minh họa công thức phương sai

Giả sử lợi nhuận của một cổ phiếu trong ba năm lần lượt là 10%, 20% và -15%.

Bước 1: Tính giá trị trung bình: (10 + 20 – 15) / 3 = 5%

Bước 2: Tính độ lệch so với trung bình: 5%, 15% và -20%

Bước 3: Bình phương các độ lệch: 25, 225 và 400

Bước 4: Tính trung bình các độ lệch bình phương:

(25 + 225 + 400) / 3 = 216,67

Kết quả này chính là phương sai. Lấy căn bậc hai của giá trị trên sẽ thu được độ lệch chuẩn khoảng 14,72%.

Ví dụ trên cho thấy cách công thức phương sai được áp dụng trực tiếp trong phân tích dữ liệu định lượng và tài chính.

Kết luận

Phương sai là một thước đo cốt lõi trong thống kê mô tả, giúp đánh giá mức độ phân tán dữ liệu xung quanh giá trị trung bình. Việc nắm vững công thức phương sai không chỉ giúp người học thống kê hiểu rõ bản chất của dữ liệu mà còn là nền tảng cho nhiều phương pháp phân tích nâng cao.

Trong thực tế phân tích dữ liệu định lượng, phương sai thường được sử dụng kết hợp với độ lệch chuẩn và các công cụ thống kê khác để đưa ra nhận định chính xác và có ý nghĩa.

Tính R bình phương và R bình phương hiệu chỉnh trong hồi quy

Trong phân tích dữ liệu, một yêu cầu bắt buộc khi xây dựng mô hình hồi quy tuyến tính là phải đánh giá mức độ phù hợp của mô hình với dữ liệu thực tế. Để làm được điều này, nhà nghiên cứu thường sử dụng các chỉ số đo lường mức độ giải thích của mô hình. Trong số đó, tính R là nội dung được quan tâm nhiều nhất, đặc biệt khi làm việc với SPSS và các nghiên cứu định lượng.

Bài viết này tập trung giải thích bản chất của việc tính R, sự khác nhau giữa R bình phương và R bình phương hiệu chỉnh, cách diễn giải kết quả, cũng như các kỹ thuật thường dùng để cải thiện chỉ số này trong hồi quy tuyến tính. Nội dung được trình bày theo hướng giáo dục, dễ hiểu và sát với thực hành phân tích dữ liệu.

1. Tính R và vai trò trong hồi quy tuyến tính

Tính R trong hồi quy tuyến tính thường được hiểu thông qua hệ số xác định R bình phương, hay còn gọi là r squared. Đây là chỉ số phản ánh mức độ mà các biến độc lập giải thích được sự biến thiên của biến phụ thuộc trong mô hình.

Khi thực hiện hồi quy tuyến tính, dữ liệu quan sát của biến phụ thuộc luôn có sự biến thiên. Phần biến thiên này có thể được chia thành hai phần: phần được giải thích bởi mô hình hồi quy và phần còn lại do sai số ngẫu nhiên. Việc tính R giúp đo lường tỷ lệ phần biến thiên được mô hình giải thích so với tổng biến thiên quan sát được.

2. R bình phương là gì?

R bình phương là một chỉ số phổ biến trong đánh giá mô hình hồi quy. Giá trị của R bình phương nằm trong khoảng từ 0 đến 1. Khi giá trị này càng tiến về 1, mô hình hồi quy càng giải thích tốt sự biến thiên của biến phụ thuộc.

Ví dụ, nếu kết quả hồi quy cho thấy R bình phương bằng 0.7, điều đó có nghĩa là khoảng 70% sự biến thiên của biến phụ thuộc được giải thích bởi các biến độc lập trong mô hình. Phần còn lại 30% đến từ các yếu tố khác ngoài mô hình và sai số.

Tuy nhiên, một điểm quan trọng cần lưu ý khi tính R là R bình phương luôn có xu hướng tăng khi thêm biến độc lập vào mô hình, ngay cả khi biến đó không thực sự có ý nghĩa.

3. Hạn chế của R bình phương

Mặc dù được sử dụng rộng rãi, R bình phương tồn tại một hạn chế lớn. Cụ thể, chỉ số này không giảm khi thêm biến độc lập vào mô hình. Điều này có thể dẫn đến việc đánh giá quá cao mức độ phù hợp của mô hình, đặc biệt trong hồi quy tuyến tính đa biến.

Do đó, chỉ dựa vào R bình phương để đánh giá mô hình là chưa đủ an toàn trong phân tích dữ liệu. Đây chính là lý do R bình phương hiệu chỉnh ra đời.

4. R bình phương hiệu chỉnh là gì?

R bình phương hiệu chỉnh được phát triển dựa trên R bình phương nhằm khắc phục hạn chế kể trên. Khi tính R bình phương hiệu chỉnh, chỉ số này đã điều chỉnh theo số lượng biến độc lập và cỡ mẫu.

Khác với R bình phương, R bình phương hiệu chỉnh có thể tăng hoặc giảm khi thêm biến độc lập vào mô hình. Nếu biến mới không thực sự cải thiện khả năng giải thích, giá trị này sẽ giảm. Vì vậy, R bình phương hiệu chỉnh phản ánh sát hơn chất lượng thực sự của mô hình hồi quy tuyến tính.

Trong thực hành phân tích dữ liệu, việc tính R thường gắn liền với việc đọc và diễn giải R bình phương hiệu chỉnh thay vì chỉ nhìn vào R bình phương thông thường.

5. Ý nghĩa của R bình phương hiệu chỉnh

Giá trị R bình phương hiệu chỉnh cũng nằm trong khoảng từ 0 đến 1. Giá trị càng cao cho thấy mô hình có khả năng giải thích tốt hơn. Tuy nhiên, việc đạt giá trị gần bằng 1 là rất hiếm trong các nghiên cứu xã hội, kinh tế và hành vi.

Ví dụ, nếu R bình phương hiệu chỉnh bằng 0.72, điều đó có nghĩa là các biến độc lập trong mô hình giải thích được 72% sự biến thiên của biến phụ thuộc. Phần còn lại đến từ các yếu tố chưa được đưa vào mô hình và sai số ngẫu nhiên.

6. R bình phương hiệu chỉnh dưới 0.5 có chấp nhận được không

Một câu hỏi rất phổ biến khi tính R là liệu R bình phương hiệu chỉnh dưới 0.5 có làm mô hình bị loại hay không. Trên thực tế, không tồn tại một ngưỡng cứng nào cho R bình phương hiệu chỉnh.

Giá trị này phụ thuộc vào bản chất nghiên cứu, số lượng biến độc lập và lĩnh vực nghiên cứu. Trong các mô hình đơn giản hoặc nghiên cứu hành vi con người, R bình phương hiệu chỉnh dưới 0.5 vẫn hoàn toàn có thể chấp nhận được.

Việc yêu cầu R bình phương hiệu chỉnh luôn lớn hơn 0.5 trong mọi trường hợp là không phù hợp với lý thuyết thống kê và thực tiễn nghiên cứu.

7. Cách cải thiện giá trị khi tính R

Trong phân tích dữ liệu, có một số kỹ thuật giúp cải thiện kết quả tính R, đặc biệt là R bình phương hiệu chỉnh. Một trong những cách phổ biến nhất là kiểm tra và xử lý các giá trị ngoại lai.

Các điểm dữ liệu dị biệt có thể làm méo mó đường hồi quy và kéo giảm mức độ phù hợp của mô hình. Do đó, việc phát hiện và xử lý outliers là bước quan trọng trước khi kết luận về chất lượng mô hình.

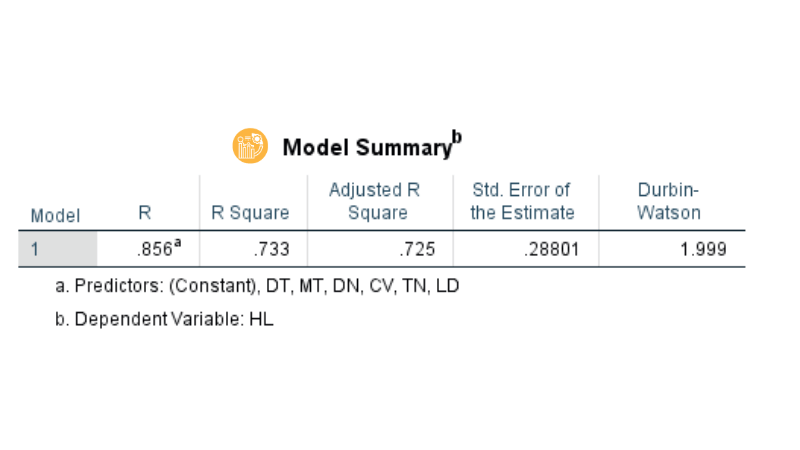

8. Cải thiện R bình phương thông qua đồ thị Scatter Plot hồi quy

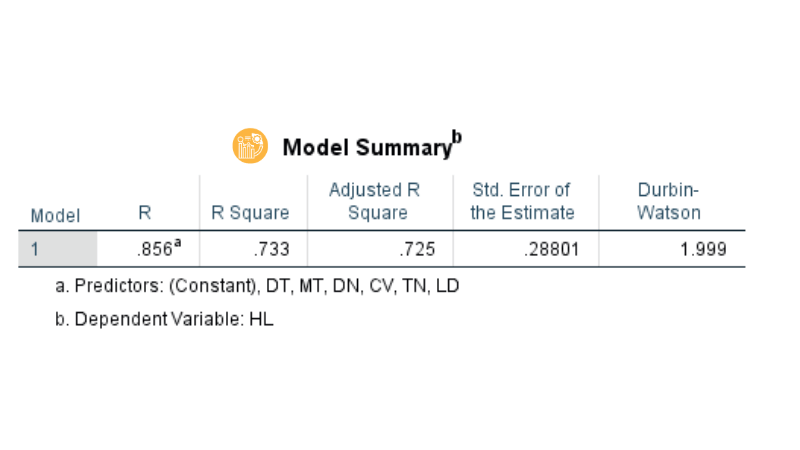

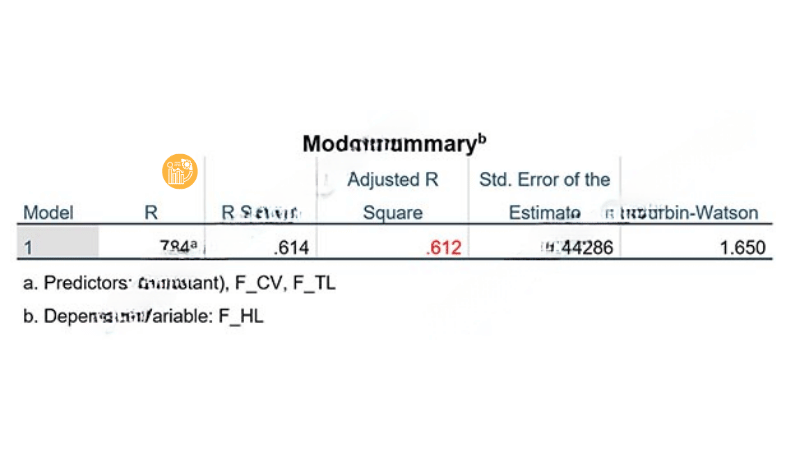

Xét một ví dụ hồi quy tuyến tính bội trong đó hai biến độc lập F_TL và F_CV được sử dụng để giải thích biến phụ thuộc F_HL. Trong bảng Model Summary, hệ số Adjusted R Square ban đầu đạt giá trị 0.478. Chỉ số này phản ánh mức độ phù hợp của mô hình hồi quy; giá trị càng tiến gần 1 cho thấy mô hình càng giải thích tốt sự biến thiên của biến phụ thuộc.

Cách tăng R bình phương trong SPSS

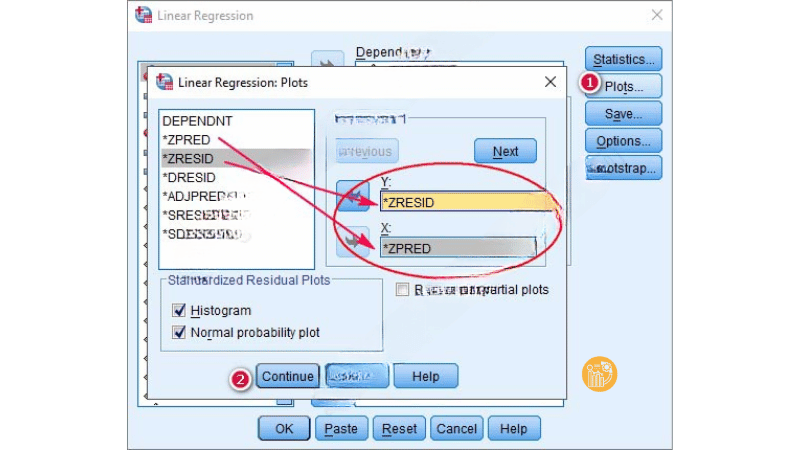

Để xây dựng đồ thị Scatter Plot khi chạy hồi quy tuyến tính bội trong SPSS, người phân tích truy cập vào mục Plots, sau đó:

- Đưa biến ZRESID vào trục Y

- Đưa biến ZPRED vào trục X

Thiết lập này cho phép quan sát mối quan hệ giữa phần dư chuẩn hóa và giá trị dự báo chuẩn hóa, từ đó phát hiện các quan sát bất thường.

Cách cải thiện Adjusted R Square trong SPSS

Việc thực hiện hồi quy cần tuân thủ đầy đủ quy trình phân tích để SPSS xuất ra toàn bộ bảng kết quả và đồ thị cần thiết, trong đó có Scatter Plot phục vụ đánh giá mô hình.

Theo quy luật Empirical (68–95–99.7) của phân phối chuẩn, các quan sát nằm ngoài khoảng từ –3 đến +3 độ lệch chuẩn trên cả hai trục thường được xem là điểm dị biệt. Trong đồ thị, có thể nhận thấy 5 quan sát (được đánh dấu khác biệt) nằm ngoài vùng phân bố chính.

Để xác định chính xác mã số các quan sát này, người dùng nhấp đúp vào đồ thị Scatter, kích hoạt chế độ hiển thị nhãn quan sát và đóng cửa sổ chỉnh sửa sau khi hoàn tất. Kết quả cho thấy các điểm dị biệt tương ứng với các quan sát: 11, 45, 149, 208 và 253.

Tiếp theo, tiến hành loại bỏ 5 quan sát trên khỏi tập dữ liệu. Để tránh nhầm lẫn, nên tạo một biến đánh số thứ tự cho các dòng dữ liệu và xóa theo thứ tự từ dòng có số lớn đến số nhỏ. Sau đó, chạy lại hồi quy tuyến tính bội với tập dữ liệu đã được làm sạch.

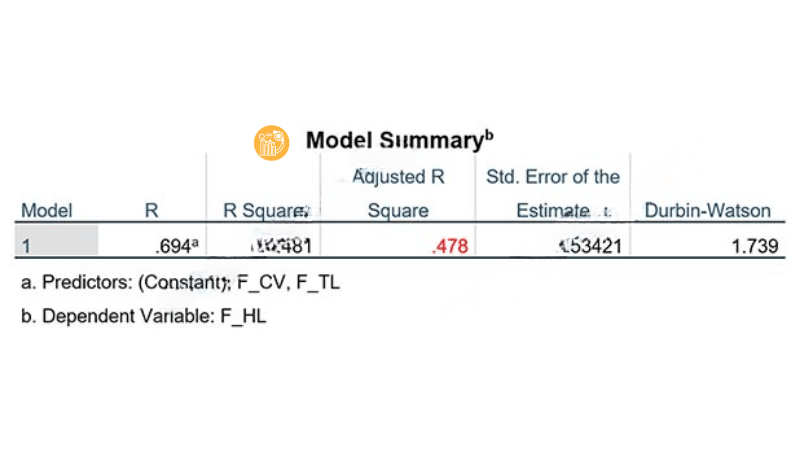

Kết quả cho thấy Adjusted R Square tăng lên 0.553, cao hơn đáng kể so với mức ban đầu 0.478. Mặc dù phải loại bỏ 5 quan sát, nhưng so với tổng cỡ mẫu 350, tỷ lệ này là rất nhỏ và hoàn toàn chấp nhận được để đổi lấy một mô hình hồi quy phù hợp hơn.

9. Cải thiện R bình phương bằng bảng Casewise Diagnostics

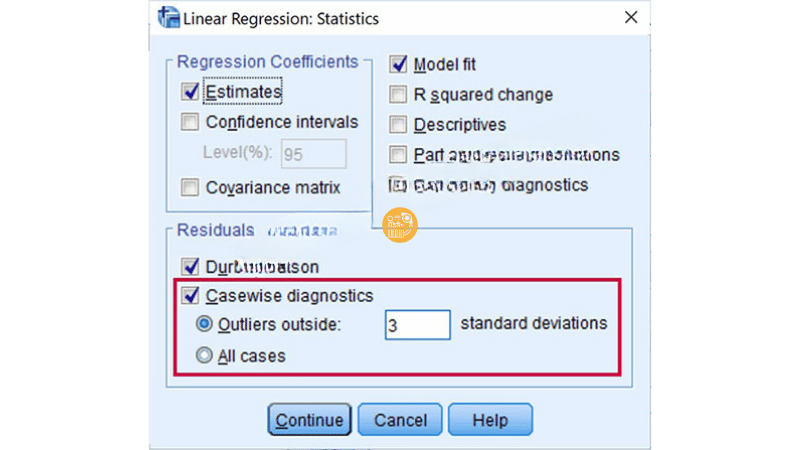

Ngoài Scatter Plot, SPSS còn cung cấp công cụ Casewise Diagnostics để tự động phát hiện các quan sát dị biệt trong phân tích hồi quy tuyến tính. Tại mục Statistics, người dùng tích chọn Casewise diagnostics và nhập ngưỡng 2 hoặc 3 độ lệch chuẩn vào ô Outliers outside.

Thông thường, nên bắt đầu với ngưỡng 3 độ lệch chuẩn. Nếu sau khi xử lý các điểm này mà mô hình vẫn chưa đạt yêu cầu, có thể xem xét tiếp các điểm nằm ngoài 2 độ lệch chuẩn.

Cách tăng R² trong SPSS bằng Casewise Diagnostics

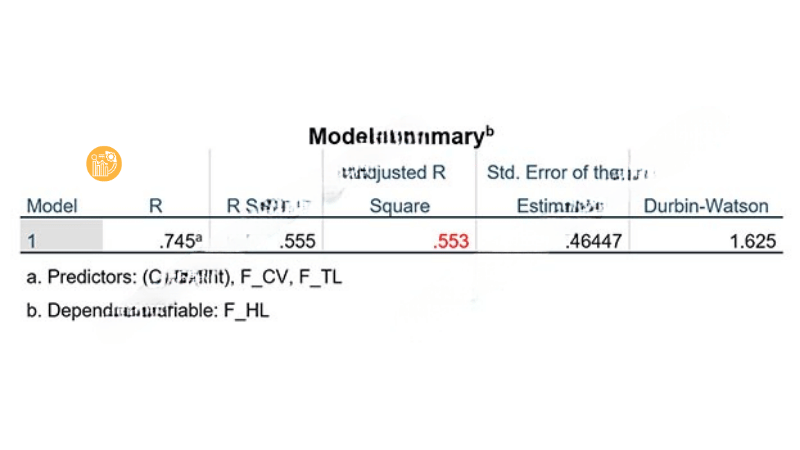

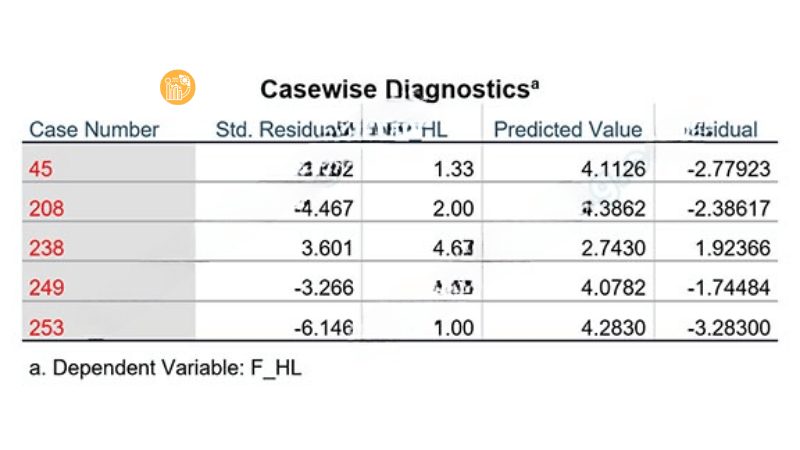

Tiếp tục phân tích hồi quy với hai biến độc lập F_TL và F_CV tác động lên F_HL, thiết lập Casewise Diagnostics với ngưỡng 3 độ lệch chuẩn. Kết quả ban đầu cho thấy Adjusted R Square vẫn ở mức 0.478, đồng thời bảng Casewise Diagnostics xác định các quan sát dị biệt gồm: 45, 208, 238, 249 và 253.

Tiến hành loại bỏ 5 quan sát này khỏi dữ liệu (lưu ý thao tác xóa từ dòng có số thứ tự lớn xuống nhỏ), sau đó chạy lại mô hình hồi quy.

Kết quả cuối cùng cho thấy Adjusted R Square tăng lên 0.612, cao hơn đáng kể so với giá trị ban đầu. Điều này cho thấy việc loại bỏ các quan sát dị biệt đã giúp mô hình hồi quy cải thiện rõ rệt về mức độ phù hợp.

10. Lưu ý khi cải thiện R bình phương

Mặc dù việc loại bỏ outliers giúp tăng giá trị khi tính R, nhưng cần thực hiện một cách thận trọng. Việc loại bỏ dữ liệu phải có cơ sở thống kê và logic thực tế, tránh việc loại bỏ tùy tiện chỉ để làm đẹp kết quả.

Mục tiêu của phân tích dữ liệu không phải là tối đa hóa R bình phương bằng mọi giá, mà là xây dựng một mô hình có ý nghĩa và phản ánh đúng bản chất hiện tượng nghiên cứu.

Ứng dụng thực tế trong phân tích dữ liệu

Tại xulysolieu.info và Xử lý số liệu, nội dung về tính R, đánh giá mô hình hồi quy và đọc kết quả SPSS luôn được hướng dẫn chi tiết trong các khóa học phân tích dữ liệu. Người học không chỉ biết cách chạy hồi quy mà còn hiểu rõ ý nghĩa từng chỉ số.

Kết luận

Tóm lại, tính R là bước quan trọng để đánh giá mức độ phù hợp của mô hình hồi quy tuyến tính. Trong thực hành, R bình phương hiệu chỉnh là chỉ số nên được ưu tiên sử dụng vì phản ánh sát hơn chất lượng mô hình.

Chỉ số OR là gì? Cách tính Odds Ratio trong SPSS

Trong phân tích dữ liệu, đặc biệt là phân tích dữ liệu y học và xã hội học, chỉ số OR (Odds Ratio) xuất hiện rất thường xuyên trong các bảng kết quả SPSS. Tuy nhiên, không ít người có thể chạy được mô hình nhưng lại chưa thật sự hiểu rõ bản chất và cách tính Odds Ratio trong SPSS, dẫn đến việc diễn giải sai kết quả hoặc kết luận chưa chính xác.

Bài viết này sẽ giúp bạn hiểu rõ chỉ số OR là gì, bản chất thống kê của Odds Ratio, cách tính OR trong SPSS bằng hồi quy logistic, cũng như cách đọc spss output và diễn giải kết quả một cách đúng đắn, dễ hiểu và đúng chuẩn nghiên cứu.

1. Chỉ số OR (Odds Ratio) là gì?

Odds Ratio, viết tắt là OR, là tỷ số chênh giữa hai odds. Odds là thước đo khả năng xảy ra của một biến cố so với khả năng không xảy ra biến cố đó. Trong thống kê, odds được tính bằng:

Odds = Số trường hợp xảy ra biến cố / Số trường hợp không xảy ra biến cố

Chỉ số OR được định nghĩa là tỷ số giữa odds của nhóm phơi nhiễm và odds của nhóm không phơi nhiễm. Đây là chỉ số cốt lõi trong phân tích rủi ro, đặc biệt trong các nghiên cứu hồi quy logistic và phân tích dữ liệu y học.

OR = Odds1 / Odds2

Nhờ chỉ số này, nhà nghiên cứu có thể đánh giá mức độ liên quan giữa một yếu tố nguy cơ và một kết cục nhị phân (có/không, đúng/sai, mắc bệnh/không mắc bệnh).

2. Ý nghĩa thống kê của Odds Ratio

Trước khi đi sâu vào cách tính OR trong SPSS, bạn cần nắm rõ ý nghĩa của giá trị OR:

- OR = 1: Không có mối liên quan giữa yếu tố nguy cơ và biến cố

- OR > 1: Yếu tố làm tăng khả năng xảy ra biến cố

- OR < 1: Yếu tố có tác dụng bảo vệ, làm giảm khả năng xảy ra biến cố

Như vậy, OR không chỉ cho biết có mối liên quan hay không, mà còn cho biết chiều hướng và mức độ của mối liên quan đó.

3. Ví dụ minh họa bản chất của OR

Giả sử có 100 học sinh, trong đó một nhóm tham gia học thêm và một nhóm không học thêm. Sau kỳ thi, ta ghi nhận số học sinh thi trượt và thi đậu ở mỗi nhóm.

Nếu odds thi trượt của nhóm học thêm thấp hơn odds thi trượt của nhóm không học thêm, thì OR sẽ nhỏ hơn 1. Điều này cho thấy học thêm có tác dụng làm giảm nguy cơ thi trượt.

Ví dụ này giúp bạn hình dung rõ hơn bản chất của Odds Ratio trước khi áp dụng cách tính OR trong SPSS.

4. Khi nào cần tính Odds Ratio trong SPSS?

Cách tính OR trong SPSS thường được sử dụng trong các trường hợp sau:

- Biến phụ thuộc là biến nhị phân (0/1)

- Phân tích mối liên quan giữa yếu tố nguy cơ và kết cục

- Nghiên cứu y học, dịch tễ học, xã hội học

- Sử dụng hồi quy logistic đơn biến hoặc đa biến

Trong SPSS, OR không xuất hiện trực tiếp trong các mô hình hồi quy tuyến tính mà chủ yếu được trích xuất từ kết quả hồi quy logistic.

5. Cách tính Odds Ratio trong SPSS bằng hồi quy logistic

Dưới đây là hướng dẫn chi tiết cách tính OR trong SPSS thông qua hồi quy logistic nhị phân.

5.1. Chuẩn bị dữ liệu

Trước khi chạy mô hình, cần đảm bảo:

- Biến phụ thuộc là biến nhị phân (0 và 1)

- Biến độc lập có thể là định danh hoặc định lượng

- Dữ liệu đã được làm sạch, không sai mã hóa

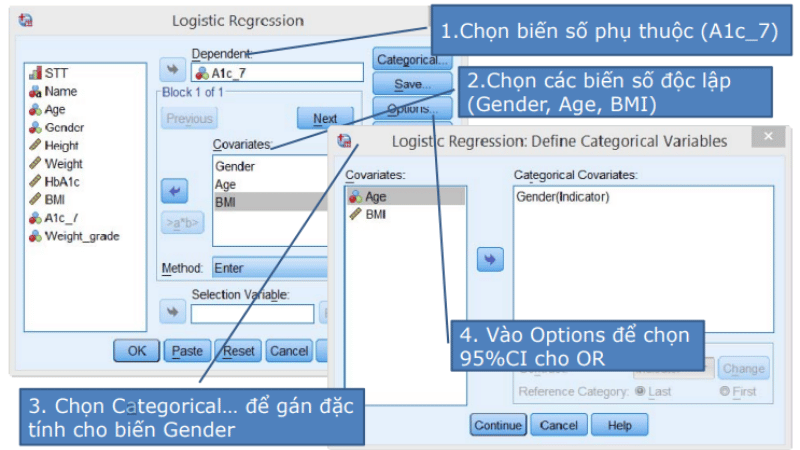

5.2. Các bước thực hiện trên SPSS

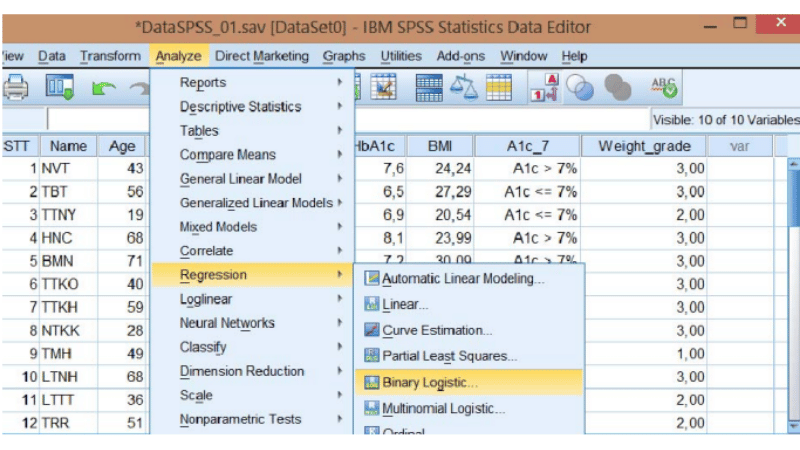

Bước 1: Trên thanh menu, chọn Analyze → Regression → Binary Logistic.

Bước 2: Đưa biến phụ thuộc vào ô Dependent.

Bước 3: Đưa biến độc lập vào ô Covariates. Với biến định danh, chọn Categorical để khai báo.

Bước 4: Chọn Options và tích chọn khoảng tin cậy 95% cho Exp(B).

Bước 5: Nhấn OK để chạy mô hình và xem kết quả.

Toàn bộ quá trình trên chính là cách tính OR trong SPSS được sử dụng phổ biến nhất trong thực hành.

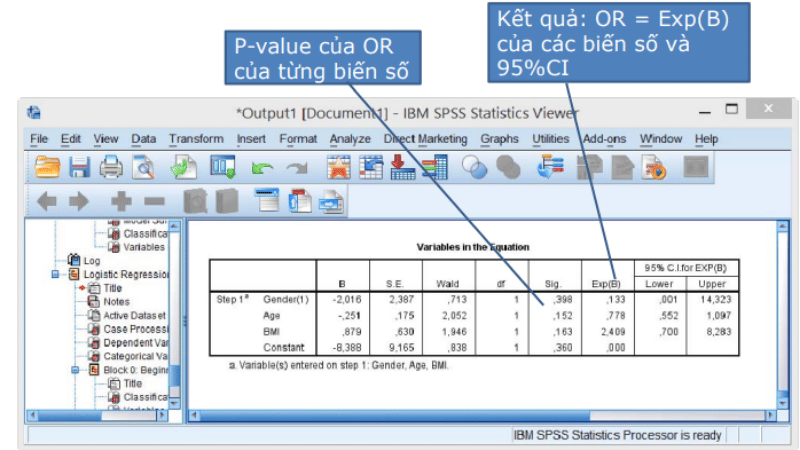

6. Đọc kết quả OR trong bảng SPSS output

Sau khi chạy hồi quy logistic, SPSS output sẽ hiển thị bảng Variables in the Equation. Trong bảng này, bạn cần chú ý các cột sau:

- B: hệ số hồi quy logistic

- Sig.: giá trị p của kiểm định Wald

- Exp(B): chính là Odds Ratio

- 95% CI for Exp(B): khoảng tin cậy của OR

Giá trị Exp(B) chính là kết quả cốt lõi khi bạn thực hiện cách tính OR trong SPSS.

7. Cách diễn giải OR trong hồi quy logistic

Việc diễn giải OR cần tuân theo một trình tự logic:

- Bước 1: Kiểm tra Sig. Nếu Sig. < 0.05, OR có ý nghĩa thống kê

- Bước 2: Xem giá trị Exp(B) lớn hơn hay nhỏ hơn 1

- Bước 3: Diễn giải ý nghĩa thực tế của OR

Ví dụ: Exp(B) = 0.6 và Sig. < 0.05 cho thấy biến độc lập làm giảm 40% odds xảy ra biến cố so với nhóm tham chiếu.

8. OR đơn biến và OR đa biến

Cách tính OR trong SPSS có thể áp dụng cho hai trường hợp:

- OR đơn biến: phân tích từng biến độc lập riêng lẻ

- OR đa biến: phân tích đồng thời nhiều biến độc lập trong cùng mô hình

OR đơn biến phản ánh mối liên quan thô, trong khi OR đa biến phản ánh mối liên quan đã được hiệu chỉnh cho các yếu tố gây nhiễu khác.

9. Mối quan hệ giữa OR và RR

OR và RR (Relative Risk) đều được dùng trong phân tích rủi ro. Tuy nhiên:

- OR là tỷ số của odds

- RR là tỷ số của xác suất

Trong các nghiên cứu hồi quy logistic, OR được sử dụng thay cho RR do tính chất toán học của mô hình. Khi tỷ lệ biến cố thấp, OR xấp xỉ RR; khi tỷ lệ cao, OR có xu hướng lớn hơn RR.

10. Những lỗi thường gặp khi diễn giải OR

- Nhầm lẫn giữa OR và xác suất

- Diễn giải OR khi Sig. > 0.05

- Bỏ qua khoảng tin cậy 95%

- Không xác định rõ nhóm tham chiếu

Hiểu đúng cách tính OR trong SPSS giúp bạn tránh được các sai lầm này và nâng cao chất lượng bài phân tích.

11. Ứng dụng của OR trong phân tích dữ liệu y học

Trong phân tích dữ liệu y học, OR được sử dụng để đánh giá:

- Mối liên quan giữa yếu tố nguy cơ và bệnh tật

- Hiệu quả của can thiệp điều trị

- Tác động của lối sống đến sức khỏe

Nhờ hồi quy logistic và cách tính OR trong SPSS, các nhà nghiên cứu có thể đưa ra kết luận khoa học có giá trị thực tiễn cao.

12. Hỗ trợ chạy SPSS và phân tích OR

Nếu bạn gặp khó khăn trong việc áp dụng cách tính OR trong SPSS, đọc spss output hoặc diễn giải kết quả hồi quy logistic cho luận văn, đề tài nghiên cứu hay báo cáo y học, bạn có thể tham khảo dịch vụ tại xulysolieu.info – Xử lý số liệu.

Đội ngũ chuyên môn hỗ trợ từ chuẩn bị dữ liệu, chạy hồi quy logistic, phân tích rủi ro đến viết diễn giải kết quả đúng chuẩn học thuật.

Quy trình nghiên cứu khoa học: 8 bước cơ bản cho người mới

Đối với sinh viên và người mới bắt đầu, việc nắm vững các bước quy trình nghiên cứu khoa học là điều kiện tiên quyết để triển khai một đề tài bài bản và có giá trị học thuật. Trên thực tế, rất nhiều đề tài gặp khó khăn không phải vì thiếu dữ liệu hay công cụ phân tích, mà do chưa hiểu rõ quy trình nghiên cứu và triển khai các bước một cách rời rạc, thiếu hệ thống.

Bài viết này trình bày chi tiết các bước quy trình nghiên cứu khoa học theo cách dễ hiểu, đi thẳng vào thực hành, phù hợp với định hướng giáo dục về phân tích dữ liệu. Nội dung đặc biệt hữu ích cho sinh viên đại học, cao học và những người lần đầu tiếp cận nghiên cứu khoa học.

1. Xác định vấn đề nghiên cứu

Bước đầu tiên và quan trọng nhất trong các bước quy trình nghiên cứu khoa học là xác định vấn đề nghiên cứu. Đây là nền tảng quyết định toàn bộ hướng đi của đề tài.

Ở bước này, người nghiên cứu cần lựa chọn một chủ đề phù hợp với chuyên ngành, có ý nghĩa thực tiễn và khả năng triển khai. Một đề tài tốt không nhất thiết phải quá phức tạp, mà cần rõ ràng, cụ thể và có khả năng thu thập dữ liệu.

Song song với việc chọn đề tài, người nghiên cứu cần đặt ra câu hỏi nghiên cứu. Câu hỏi này đóng vai trò định hướng cho toàn bộ quy trình nghiên cứu, từ thiết kế nghiên cứu, thu thập dữ liệu cho đến phân tích dữ liệu và viết báo cáo khoa học.

2. Nghiên cứu tài liệu liên quan

Trong các bước quy trình nghiên cứu khoa học, nghiên cứu tài liệu là bước giúp người nghiên cứu hiểu rõ bối cảnh học thuật của đề tài. Đây là giai đoạn tìm kiếm, đọc và tổng hợp các công trình nghiên cứu trước đó có liên quan.

Thông qua việc nghiên cứu tài liệu, người nghiên cứu xác định được những vấn đề đã được giải quyết, những kết quả đã đạt được và những hạn chế còn tồn tại. Đây chính là cơ sở để phát hiện khoảng trống nghiên cứu và khẳng định tính cần thiết của đề tài.

Bước này cũng giúp người nghiên cứu làm quen với các khái niệm, mô hình và phương pháp thường được sử dụng trong lĩnh vực, từ đó hỗ trợ cho các bước tiếp theo trong quy trình nghiên cứu.

3. Xây dựng khung lý thuyết và giả thuyết nghiên cứu

Sau khi đã nắm được tổng quan tài liệu, bước tiếp theo trong các bước quy trình nghiên cứu khoa học là xây dựng khung lý thuyết. Khung lý thuyết thể hiện cách người nghiên cứu tiếp cận vấn đề dựa trên các lý thuyết và mô hình đã có.

Từ khung lý thuyết, người nghiên cứu đề xuất các giả thuyết nghiên cứu. Giả thuyết là những nhận định có cơ sở khoa học, cần được kiểm định bằng dữ liệu thực nghiệm. Việc xây dựng giả thuyết rõ ràng giúp quá trình phân tích dữ liệu sau này trở nên logic và có định hướng.

4. Thiết kế nghiên cứu

Thiết kế nghiên cứu là một trong những nội dung cốt lõi của các bước quy trình nghiên cứu khoa học. Ở bước này, người nghiên cứu cần quyết định phương pháp nghiên cứu phù hợp với câu hỏi và giả thuyết đã đề ra.

Tùy vào mục tiêu nghiên cứu, có thể lựa chọn phương pháp định lượng, định tính hoặc kết hợp cả hai. Đồng thời, người nghiên cứu cần xây dựng kế hoạch chi tiết cho việc thu thập dữ liệu, xác định đối tượng nghiên cứu, công cụ đo lường và phương pháp phân tích dữ liệu.

Một thiết kế nghiên cứu tốt sẽ giúp giảm thiểu sai sót và nâng cao độ tin cậy của kết quả nghiên cứu.

5. Thu thập dữ liệu

Thu thập dữ liệu là bước chuyển từ lý thuyết sang thực nghiệm trong các bước quy trình nghiên cứu khoa học. Đây là giai đoạn người nghiên cứu triển khai khảo sát, phỏng vấn, quan sát hoặc khai thác dữ liệu thứ cấp theo kế hoạch đã xây dựng.

Trong quá trình thu thập dữ liệu, cần đảm bảo dữ liệu được ghi chép đầy đủ, chính xác và lưu trữ một cách khoa học. Việc quản lý dữ liệu tốt ngay từ đầu sẽ giúp quá trình phân tích dữ liệu diễn ra thuận lợi hơn.

6. Phân tích dữ liệu

Phân tích dữ liệu là bước trung tâm trong các bước quy trình nghiên cứu khoa học, nơi các giả thuyết nghiên cứu được kiểm định bằng các phương pháp thống kê và công cụ phân tích phù hợp.

Người nghiên cứu cần thực hiện xử lý dữ liệu, làm sạch dữ liệu và lựa chọn kỹ thuật phân tích phù hợp với thiết kế nghiên cứu. Sau đó, các kết quả phân tích được diễn giải dựa trên câu hỏi nghiên cứu và khung lý thuyết ban đầu.

Việc phân tích dữ liệu không chỉ dừng lại ở việc chạy phần mềm, mà quan trọng hơn là khả năng hiểu và giải thích ý nghĩa của kết quả.

7. Viết báo cáo khoa học

Trong các bước quy trình nghiên cứu khoa học, viết báo cáo khoa học là bước tổng hợp toàn bộ quá trình nghiên cứu thành một sản phẩm hoàn chỉnh. Báo cáo thường được trình bày theo cấu trúc chuẩn gồm mở đầu, tổng quan tài liệu, phương pháp nghiên cứu, kết quả, thảo luận và kết luận.

Người nghiên cứu cần đảm bảo nội dung trình bày rõ ràng, logic và nhất quán giữa các phần. Việc chỉnh sửa, rà soát lỗi và hoàn thiện ngôn ngữ là bước không thể bỏ qua để nâng cao chất lượng báo cáo.

8. Trình bày và bảo vệ nghiên cứu

Bước cuối cùng trong các bước quy trình nghiên cứu khoa học là trình bày và bảo vệ nghiên cứu. Đây là cơ hội để người nghiên cứu giới thiệu kết quả, chứng minh giá trị khoa học và thực tiễn của đề tài.

Người nghiên cứu cần chuẩn bị bài trình bày ngắn gọn, tập trung vào mục tiêu, phương pháp, kết quả chính và đóng góp của nghiên cứu. Đồng thời, cần sẵn sàng trả lời các câu hỏi và phản biện từ hội đồng hoặc giảng viên.

Ứng dụng thực tế trong học tập và nghiên cứu

Các bước quy trình nghiên cứu khoa học luôn được lồng ghép trong các khóa học về phương pháp nghiên cứu và phân tích dữ liệu. Học viên không chỉ học lý thuyết mà còn được hướng dẫn cách áp dụng từng bước vào đề tài cụ thể.

Việc nắm vững các bước quy trình nghiên cứu khoa học giúp sinh viên chủ động hơn trong học tập, giảm áp lực khi làm luận văn và nâng cao chất lượng nghiên cứu.

Kết luận

Tóm lại, các bước quy trình nghiên cứu khoa học là kim chỉ nam giúp người mới tiếp cận nghiên cứu một cách hệ thống và hiệu quả. Từ xác định vấn đề, thiết kế nghiên cứu, thu thập dữ liệu, phân tích dữ liệu đến viết báo cáo khoa học, mỗi bước đều có vai trò riêng và liên kết chặt chẽ với nhau.

Nếu bạn đang gặp khó khăn trong việc triển khai các bước quy trình nghiên cứu khoa học hoặc cần hỗ trợ về phân tích dữ liệu, bạn có thể liên hệ Xử lý số liệu qua số điện thoại 0878968468 để được tư vấn chi tiết.

Hệ số Beta và hồi quy B trong SPSS: Cách đọc và diễn giải

Trong quá trình phân tích hồi quy, rất nhiều người học SPSS có thể chạy được mô hình nhưng lại gặp khó khăn khi diễn giải kết quả, đặc biệt là khi xuất hiện hệ số hồi quy âm. Trên thực tế, việc hiểu đúng ý nghĩa của hệ số beta trong bảng Coefficients là điều bắt buộc nếu bạn muốn phân tích hồi quy một cách chính xác và có giá trị học thuật.

Bài viết này sẽ giúp bạn hiểu rõ bản chất của hệ số beta, sự khác nhau giữa hệ số B và Beta, cách đọc kết quả hồi quy tuyến tính trên SPSS, cũng như cách diễn giải trường hợp hệ số hồi quy mang giá trị âm mà không bị nhầm lẫn.

1. Vai trò của hệ số hồi quy trong phân tích hồi quy

Trong phân tích hồi quy tuyến tính, mục tiêu chính là xác định xem các biến độc lập có ảnh hưởng biến độc lập đến biến phụ thuộc hay không, và nếu có thì mức độ ảnh hưởng mạnh hay yếu như thế nào. SPSS cung cấp câu trả lời cho vấn đề này thông qua bảng Coefficients.

Bảng Coefficients thường bao gồm các thông tin quan trọng:

- Giá trị sig của kiểm định t

- Hệ số hồi quy chưa chuẩn hóa B

- Hệ số hồi quy chuẩn hóa Beta (beta coefficient)

Trong đó, hệ số beta là chỉ số được sử dụng rất phổ biến để so sánh mức độ tác động tương đối giữa các biến độc lập trong cùng một mô hình.

2. Phân biệt hệ số B và hệ số Beta

Trước khi đi sâu vào diễn giải hệ số beta âm hay dương, bạn cần phân biệt rõ hai loại hệ số hồi quy thường gặp trong SPSS regression:

- Hệ số B: là hệ số hồi quy chưa chuẩn hóa, phản ánh mức thay đổi tuyệt đối của biến phụ thuộc khi biến độc lập tăng một đơn vị (giữ các biến khác không đổi).

- Hệ số beta: là hệ số hồi quy đã chuẩn hóa, phản ánh mức độ ảnh hưởng biến độc lập trong điều kiện các biến được chuẩn hóa về cùng thang đo.

Trong nghiên cứu thực nghiệm, hệ số beta thường được sử dụng để đánh giá biến nào tác động mạnh hơn đến biến phụ thuộc.

3. Điều kiện tiên quyết trước khi diễn giải hệ số beta

Một sai lầm rất phổ biến là nhìn vào dấu âm hoặc dương của hệ số beta mà bỏ qua giá trị sig kiểm định t. Trên thực tế, thứ tự diễn giải trong phân tích hồi quy phải tuân thủ đúng logic sau:

- Bước 1: Kiểm tra sig của kiểm định t

- Bước 2: Nếu sig < 0.05, biến độc lập có ảnh hưởng biến độc lập đến biến phụ thuộc

- Bước 3: Khi đó mới xét đến hệ số beta là âm hay dương

Nếu sig > 0.05, biến độc lập không có ý nghĩa thống kê. Trong trường hợp này, dù hệ số beta âm hay dương thì cũng không được diễn giải vì bản chất biến đó không có tác động.

4. Ý nghĩa của hệ số beta dương

Khi hệ số beta mang giá trị dương và sig < 0.05, ta kết luận rằng biến độc lập có tác động thuận chiều đến biến phụ thuộc. Điều này có nghĩa là:

Biến độc lập tăng thì biến phụ thuộc cũng tăng, và ngược lại.

Ví dụ, trong mô hình hồi quy tuyến tính về sự hài lòng khách hàng, nếu biến Khuyến mãi có hệ số beta dương, điều đó cho thấy khi mức độ khuyến mãi tăng thì sự hài lòng của khách hàng cũng tăng.

5. Ý nghĩa của hệ số beta âm trong SPSS

Hệ số beta âm thường gây bối rối cho người mới học phân tích hồi quy. Tuy nhiên, về mặt lý thuyết, ý nghĩa của hệ số beta âm rất rõ ràng.

Khi hệ số beta âm và sig < 0.05, biến độc lập có ảnh hưởng biến độc lập đến biến phụ thuộc theo chiều nghịch. Cụ thể:

Biến độc lập tăng thì biến phụ thuộc giảm, và ngược lại.

Ví dụ, biến Giá cả sản phẩm có hệ số beta âm trong mô hình hồi quy sự hài lòng khách hàng. Điều này có nghĩa là khi giá cả tăng lên, mức độ hài lòng của khách hàng có xu hướng giảm xuống.

Như vậy, hệ số beta âm không hề “sai” hay “bất thường”, mà chỉ phản ánh đúng bản chất mối quan hệ nghịch chiều giữa các biến.

6. Ví dụ diễn giải hệ số beta trong SPSS regression

Giả sử bạn thực hiện phân tích hồi quy tuyến tính với:

- Biến phụ thuộc: Sự hài lòng của khách hàng

- Biến độc lập: Giá cả sản phẩm, Khuyến mãi, Dịch vụ sau mua hàng, Chất lượng sản phẩm

Kết quả bảng Coefficients cho thấy:

- Giá cả sản phẩm: sig < 0.05, hệ số beta âm

- Khuyến mãi: sig < 0.05, hệ số beta dương

- Dịch vụ sau mua hàng: sig < 0.05, hệ số beta dương

- Chất lượng sản phẩm: sig > 0.05

Trong trường hợp này, ta kết luận rằng Giá cả sản phẩm có ảnh hưởng biến độc lập đến sự hài lòng theo chiều nghịch, trong khi Khuyến mãi và Dịch vụ sau mua hàng tác động thuận chiều. Biến Chất lượng sản phẩm không có ý nghĩa nên không được đưa vào phương trình.

7. Viết phương trình hồi quy với hệ số beta

Khi viết phương trình hồi quy chuẩn hóa, bạn cần giữ nguyên dấu của hệ số beta. Ví dụ:

Hài lòng = -0.334 × Giá cả + 0.322 × Khuyến mãi + 0.543 × Dịch vụ sau mua hàng + ε

Phương trình này cho thấy hệ số beta âm và dương cùng tồn tại và mỗi hệ số đều phản ánh đúng chiều tác động của biến độc lập.

8. Những lỗi thường gặp khi diễn giải hệ số beta

- Chỉ nhìn vào dấu âm/dương mà bỏ qua giá trị sig

- Cho rằng hệ số beta âm là “không tốt” hoặc “không hợp lý”

- So sánh hệ số B thay vì hệ số beta khi đánh giá mức độ tác động

- Đưa biến không có ý nghĩa thống kê vào phương trình hồi quy

Hiểu đúng hệ số beta giúp bạn tránh được các lỗi này và nâng cao chất lượng phân tích hồi quy.

9. Khi nào nên ưu tiên dùng hệ số beta?

Trong SPSS regression, hệ số beta nên được sử dụng khi bạn cần:

- So sánh mức độ tác động giữa các biến độc lập

- Trình bày kết quả nghiên cứu mang tính học thuật

- Đánh giá tầm quan trọng tương đối của từng biến

Trong khi đó, hệ số B phù hợp hơn khi bạn cần diễn giải ý nghĩa thực tế theo đơn vị đo lường gốc.

10. Hỗ trợ phân tích hồi quy và đọc hệ số beta

Nếu bạn gặp khó khăn trong việc chạy mô hình hồi quy, đọc bảng Coefficients, hoặc diễn giải hệ số beta trong SPSS, bạn có thể tham khảo dịch vụ tại xulysolieu.info – Xử lý số liệu. Đội ngũ chuyên môn hỗ trợ từ phân tích hồi quy, kiểm định mô hình đến viết diễn giải kết quả đúng chuẩn luận văn và bài báo khoa học.

Liên hệ: 0878968468 hoặc truy cập xulysolieu.info để được tư vấn chi tiết.

Hồi quy Logistic đa biến và đơn biến trong phân tích dữ liệu

Trong phân tích dữ liệu hiện đại, đặc biệt là các nghiên cứu y học, xã hội học, kinh tế và marketing, hồi quy logistic được xem là một trong những phương pháp quan trọng nhất để phân tích dữ liệu nhị phân. Trong đó, hồi quy logistic đa biến đóng vai trò then chốt khi nhà nghiên cứu cần đánh giá đồng thời ảnh hưởng của nhiều yếu tố đến một kết quả có hai trạng thái. Việc hiểu và áp dụng đúng hồi quy logistic đa biến giúp xây dựng mô hình dự báo chính xác và có ý nghĩa thực tiễn cao.

Bài viết này do xulysolieu.info (Xử lý số liệu) biên soạn, nhằm trình bày một cách có hệ thống và dễ hiểu về hồi quy Logistic đơn biến và hồi quy logistic đa biến, tập trung vào bản chất, cách diễn giải kết quả và ứng dụng trong phân tích dữ liệu nhị phân.

Tổng quan về hồi quy Logistic

Hồi quy logistic là một phương pháp phân tích thống kê dùng để mô hình hóa mối quan hệ giữa một biến phụ thuộc dạng nhị phân (0/1, có/không, xảy ra/không xảy ra) với một hoặc nhiều biến độc lập. Không giống hồi quy tuyến tính, hồi quy logistic không dự đoán trực tiếp giá trị của biến phụ thuộc mà ước lượng xác suất xảy ra của một sự kiện.

Trong thực hành nghiên cứu, hồi quy logistic được chia thành hai dạng chính: hồi quy logistic đơn biến và hồi quy logistic đa biến. Cả hai đều là nền tảng của phân tích đa biến khi làm việc với dữ liệu nhị phân.

Hồi quy Logistic đơn biến là gì?

Hồi quy logistic đơn biến là mô hình chỉ xem xét mối quan hệ giữa một biến độc lập và một biến phụ thuộc nhị phân. Mục tiêu của phân tích này là đánh giá ảnh hưởng riêng lẻ của từng yếu tố đến kết quả nghiên cứu.

Trong giai đoạn đầu của phân tích dữ liệu, hồi quy logistic đơn biến thường được sử dụng để:

- Sàng lọc các biến độc lập tiềm năng.

- Đánh giá mối liên quan thô giữa từng yếu tố và biến kết cục.

- Xác định các biến có ý nghĩa thống kê để đưa vào mô hình hồi quy logistic đa biến.

Mặc dù đơn giản, hồi quy logistic đơn biến không kiểm soát được các yếu tố nhiễu. Vì vậy, kết quả từ phân tích này chỉ mang tính tham khảo ban đầu.

Hồi quy logistic đa biến là gì?

Hồi quy logistic đa biến là mô hình mở rộng của hồi quy logistic, trong đó nhiều biến độc lập được đưa vào cùng lúc để phân tích ảnh hưởng đồng thời của chúng lên một biến phụ thuộc nhị phân. Đây là kỹ thuật cốt lõi trong phân tích đa biến và được sử dụng rộng rãi trong nghiên cứu khoa học.

Bản chất của hồi quy logistic đa biến là ước lượng xác suất xảy ra của kết quả nghiên cứu khi đã kiểm soát các yếu tố khác trong mô hình. Nhờ đó, hồi quy logistic đa biến giúp:

- Loại bỏ hoặc giảm thiểu ảnh hưởng của yếu tố nhiễu.

- Đánh giá tác động độc lập của từng biến.

- Xây dựng mô hình dự báo có độ chính xác cao.

Trong phân tích dữ liệu nhị phân, hồi quy logistic đa biến gần như là lựa chọn tiêu chuẩn khi nghiên cứu có nhiều biến giải thích.

Mối liên hệ giữa hồi quy Logistic đơn biến và đa biến

Trong thực tế, hồi quy logistic đơn biến và hồi quy logistic đa biến không tách rời nhau mà được sử dụng theo một quy trình logic. Thông thường, nhà nghiên cứu sẽ:

- Thực hiện hồi quy logistic đơn biến cho từng biến độc lập.

- Lựa chọn các biến có ý nghĩa thống kê hoặc có ý nghĩa thực tiễn.

- Đưa các biến này vào mô hình hồi quy logistic đa biến.

Cách tiếp cận này giúp mô hình hồi quy logistic đa biến vừa gọn nhẹ vừa đảm bảo ý nghĩa khoa học.

Diễn giải hệ số và Odds Ratio trong hồi quy logistic đa biến

Một trong những khái niệm quan trọng nhất khi làm việc với hồi quy logistic đa biến là odds ratio. Odds ratio phản ánh mức độ thay đổi của odds xảy ra kết quả khi biến độc lập tăng một đơn vị, trong điều kiện các biến khác không đổi.

Trong hồi quy logistic đa biến:

- Odds ratio > 1 cho thấy biến độc lập làm tăng khả năng xảy ra kết quả.

- Odds ratio < 1 cho thấy biến độc lập làm giảm khả năng xảy ra kết quả.

- Odds ratio = 1 cho thấy không có mối liên quan.

Điểm cần lưu ý là odds ratio trong hồi quy logistic đa biến là odds ratio đã được hiệu chỉnh, nghĩa là đã kiểm soát ảnh hưởng của các biến khác trong mô hình. Điều này làm cho kết quả có giá trị suy luận cao hơn so với phân tích đơn biến.

Vai trò của hồi quy logistic đa biến trong mô hình dự báo

Trong nhiều lĩnh vực, hồi quy logistic đa biến được sử dụng như một mô hình dự báo xác suất xảy ra của sự kiện. Ví dụ:

- Dự báo nguy cơ mắc bệnh dựa trên nhiều yếu tố nguy cơ.

- Dự đoán khả năng khách hàng rời bỏ dịch vụ.

- Ước lượng xác suất thành công hay thất bại của một chiến lược marketing.

Nhờ khả năng xử lý nhiều biến độc lập cùng lúc, hồi quy logistic đa biến cho phép xây dựng mô hình dự báo sát với thực tế hơn so với các phương pháp đơn giản.

Điều kiện áp dụng hồi quy logistic đa biến

Để sử dụng hồi quy logistic đa biến một cách hiệu quả, cần đảm bảo một số điều kiện cơ bản:

- Biến phụ thuộc phải là dữ liệu nhị phân.

- Các quan sát độc lập với nhau.

- Không có đa cộng tuyến nghiêm trọng giữa các biến độc lập.

- Kích thước mẫu đủ lớn để ước lượng ổn định.

Việc kiểm tra các điều kiện này là bước không thể thiếu trong phân tích đa biến, giúp mô hình hồi quy logistic đa biến đạt độ tin cậy cao.

Ưu điểm và hạn chế của hồi quy logistic đa biến

Hồi quy logistic đa biến có nhiều ưu điểm nổi bật:

- Phù hợp với phân tích dữ liệu nhị phân.

- Kiểm soát được nhiều yếu tố nhiễu.

- Dễ diễn giải thông qua odds ratio.

- Ứng dụng rộng rãi trong nghiên cứu và thực tiễn.

Tuy nhiên, phương pháp này cũng có một số hạn chế:

- Nhạy cảm với kích thước mẫu nhỏ.

- Khó diễn giải khi mô hình có quá nhiều biến.

- Phụ thuộc nhiều vào chất lượng dữ liệu đầu vào.

Kết luận

Hồi quy logistic đơn biến và hồi quy logistic đa biến là hai công cụ không thể thiếu trong phân tích dữ liệu nhị phân. Trong đó, hồi quy logistic đa biến giữ vai trò trung tâm trong phân tích đa biến, giúp kiểm soát yếu tố nhiễu và xây dựng mô hình dự báo có giá trị khoa học và thực tiễn.

Việc hiểu đúng bản chất, cách sử dụng và cách diễn giải hồi quy logistic đa biến sẽ giúp nhà nghiên cứu nâng cao chất lượng phân tích và độ tin cậy của kết quả nghiên cứu.

Nếu bạn cần hỗ trợ phân tích dữ liệu, xây dựng mô hình dự báo, thực hiện logistic regression đa biến hoặc viết báo cáo nghiên cứu, hãy tham khảo tại xulysolieu.info (Xử lý số liệu) hoặc liên hệ 0878968468 để được tư vấn chuyên sâu.

Làm sạch số liệu bằng SPSS: Quy trình và lỗi thường gặp

Trong bất kỳ nghiên cứu hay dự án phân tích nào, dữ liệu thô gần như luôn tồn tại sai sót. Nếu đưa dữ liệu chưa được kiểm tra vào phân tích, kết quả thu được có thể sai lệch nghiêm trọng. Vì vậy, làm sạch số liệu bằng SPSS là bước bắt buộc trước khi tiến hành các kỹ thuật thống kê hay mô hình hóa. Thực hiện làm sạch số liệu bằng SPSS ngay từ đầu không chỉ giúp kết quả chính xác hơn mà còn tiết kiệm rất nhiều thời gian ở giai đoạn phân tích.

Bài viết này do xulysolieu.info (Xử lý số liệu) biên soạn, trình bày chi tiết quy trình làm sạch số liệu bằng SPSS, các công cụ thường dùng, những lỗi phổ biến và cách khắc phục, theo hướng dễ hiểu và phù hợp cho người học phân tích dữ liệu.

Vì sao cần làm sạch số liệu bằng SPSS?

Làm sạch số liệu bằng SPSS là quá trình kiểm tra, phát hiện và chỉnh sửa các sai sót trong dữ liệu trước khi phân tích. Những sai sót này có thể phát sinh từ quá trình thu thập, nhập liệu hoặc mã hóa biến.

Nếu không thực hiện data cleaning cẩn thận, dữ liệu có thể gặp các vấn đề như:

- Giá trị nhập sai hoặc vượt ngoài phạm vi hợp lý.

- Dữ liệu thiếu nhưng không được xử lý đúng cách.

- Outlier làm méo kết quả thống kê.

- Mâu thuẫn logic giữa các biến.

Do đó, làm sạch số liệu bằng SPSS là nền tảng quan trọng để đảm bảo chất lượng phân tích dữ liệu SPSS.

Tổng quan quy trình làm sạch số liệu bằng SPSS

Một quy trình làm sạch số liệu bằng SPSS thường bao gồm các bước chính:

- Kiểm tra lỗi nhập liệu và giá trị bất thường.

- Phát hiện dữ liệu thiếu và xử lý dữ liệu thiếu.

- Kiểm tra logic giữa các biến.

- Sắp xếp, lọc và chỉnh sửa dữ liệu sai.

- Chuẩn hóa dữ liệu để sẵn sàng cho phân tích.

Các bước này có thể lặp lại nhiều lần cho đến khi dữ liệu đạt trạng thái “sạch”.

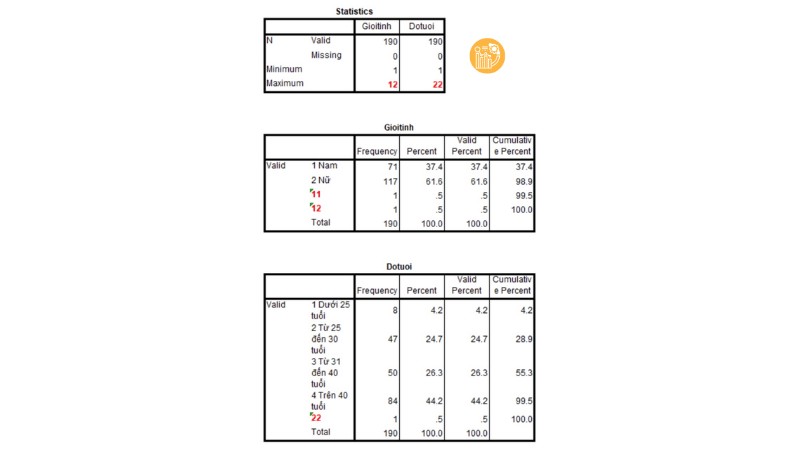

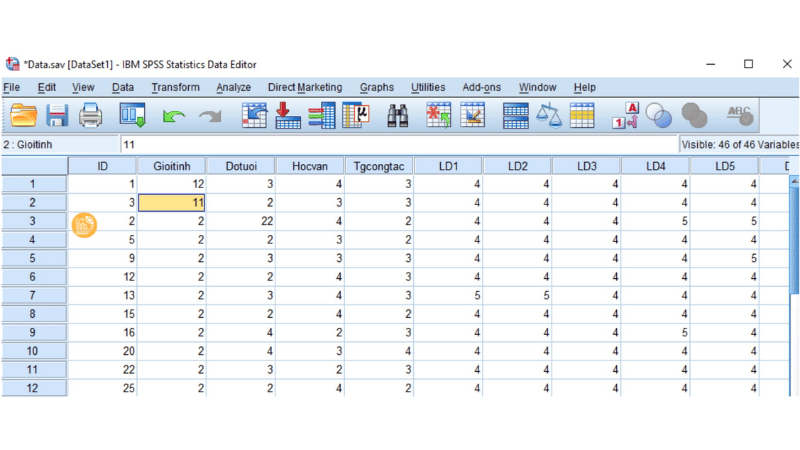

Kiểm tra lỗi dữ liệu bằng Frequencies

Một trong những cách cơ bản nhất để làm sạch số liệu bằng SPSS là sử dụng bảng Frequencies. Công cụ này đặc biệt hữu ích với các biến định tính hoặc biến mã hóa.

Cách thực hiện:

- Vào Analyze, chọn Descriptive Statistics, sau đó chọn Frequencies.

- Đưa biến cần kiểm tra vào ô Variables.

- Chọn Statistics, tích vào Minimum và Maximum.

- Nhấn OK để xem kết quả.

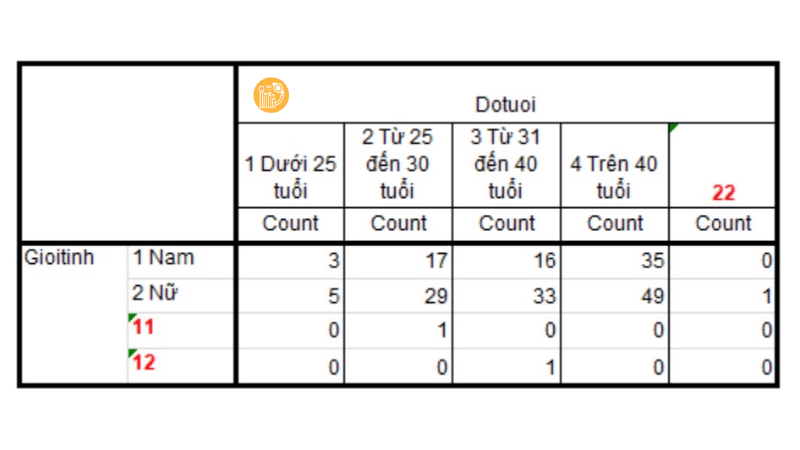

Dựa trên kết quả, người phân tích có thể phát hiện các giá trị không hợp lý. Ví dụ, biến giới tính chỉ có giá trị 1 và 2 nhưng lại xuất hiện 11 hoặc 12, đây rõ ràng là lỗi nhập liệu và cần sửa.

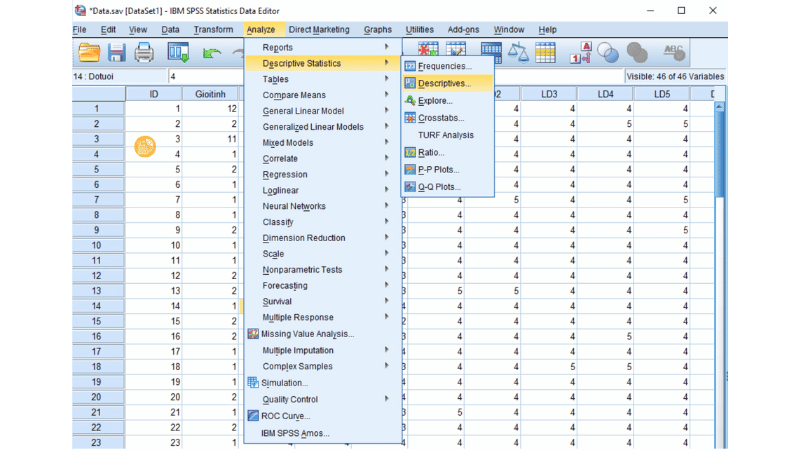

Kiểm tra lỗi bằng Descriptives

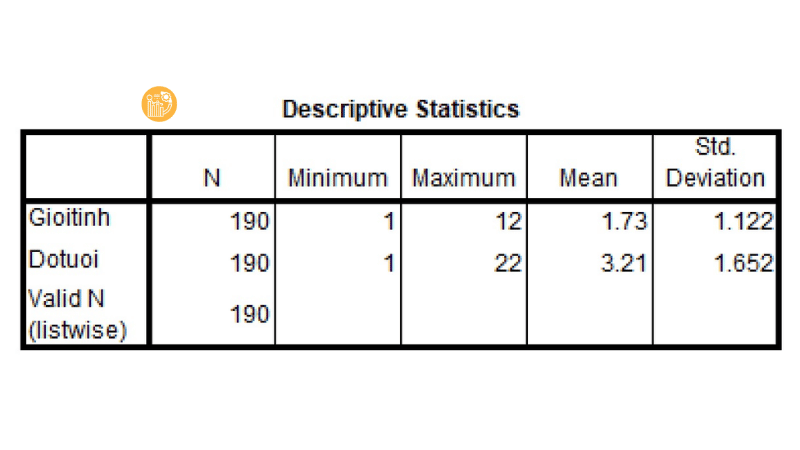

Bên cạnh Frequencies, bảng Descriptives cũng là công cụ quan trọng trong làm sạch số liệu bằng SPSS, đặc biệt với biến định lượng.

Các bước thực hiện:

- Chọn Analyze, vào Descriptive Statistics, chọn Descriptives.

- Đưa các biến cần kiểm tra vào danh sách.

- Chọn Options và tích Mean, Std. Deviation, Minimum, Maximum.

- Nhấn OK để xem Output.

Khi xem kết quả, cần đặt câu hỏi: giá trị nhỏ nhất và lớn nhất có hợp lý không? Giá trị trung bình và độ lệch chuẩn có phản ánh đúng bản chất biến không? Nếu có outlier, giá trị trung bình sẽ bị kéo lệch rõ rệt.

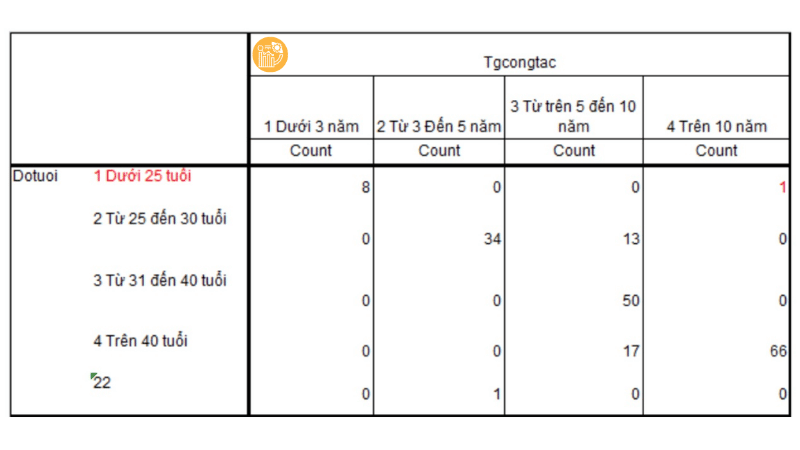

Phát hiện lỗi bằng bảng kết hợp và logic dữ liệu

Một bước nâng cao trong làm sạch số liệu bằng SPSS là kiểm tra tính logic giữa các biến. Cách này rất hiệu quả để phát hiện lỗi mà các thống kê đơn biến không chỉ ra.

Ví dụ: kết hợp biến độ tuổi và thời gian công tác. Nếu một người dưới 25 tuổi nhưng thời gian công tác lại trên 10 năm thì đây là điểm bất thường. Lỗi này có thể đến từ việc nhập sai tuổi hoặc sai thời gian công tác.

Việc phát hiện outlier và lỗi logic giúp quá trình data cleaning trở nên toàn diện hơn.

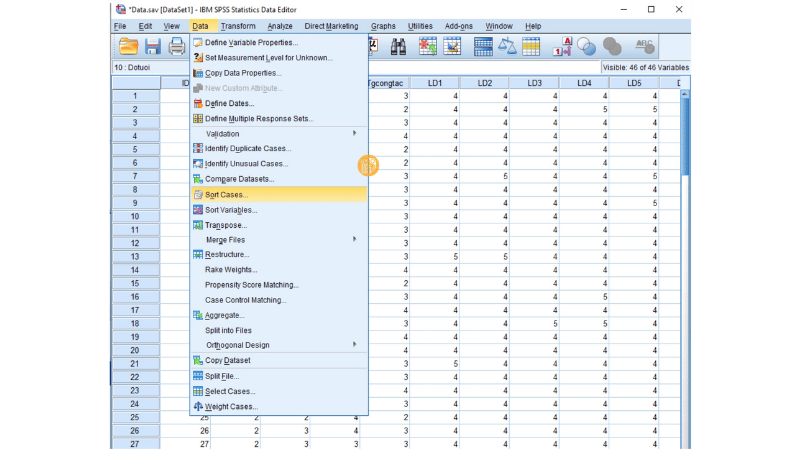

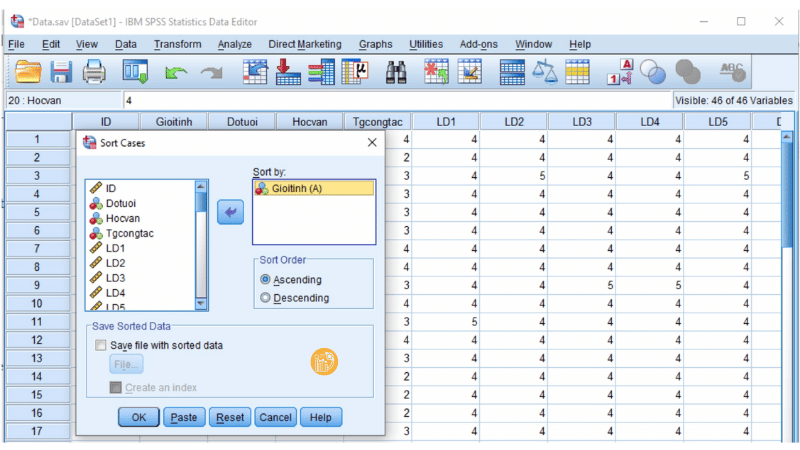

Sắp xếp dữ liệu để sửa lỗi nhanh hơn

Sau khi phát hiện lỗi, bước tiếp theo trong làm sạch số liệu bằng SPSS là sửa lỗi. Một kỹ thuật giúp tiết kiệm thời gian là sắp xếp dữ liệu.

Cách thực hiện:

- Vào Data, chọn Sort Cases.

- Chọn biến nghi ngờ có lỗi và đưa vào ô Sort by.

- Chọn sắp xếp tăng dần hoặc giảm dần.

- Nhấn OK để sắp xếp.

Sau khi sắp xếp, các giá trị bất thường thường sẽ nằm ở đầu hoặc cuối bảng dữ liệu, rất thuận tiện cho việc chỉnh sửa.

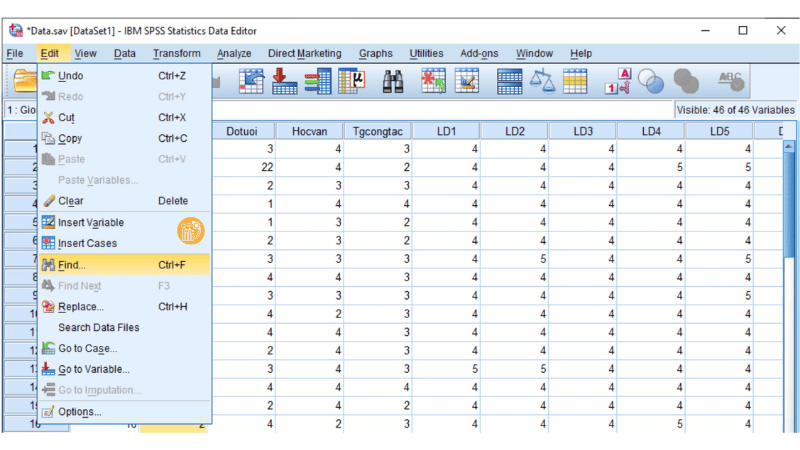

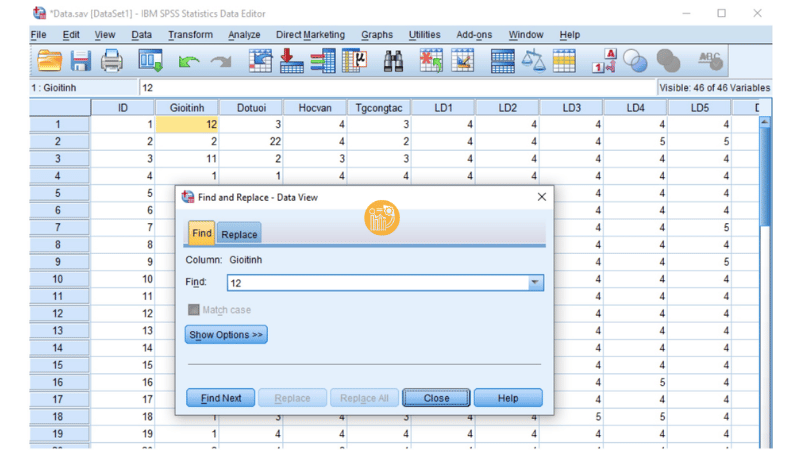

Sửa lỗi bằng công cụ Find

Với các lỗi nhập liệu cụ thể, công cụ Find trong SPSS rất hữu ích cho làm sạch số liệu bằng SPSS.

Cách dùng:

- Chọn cột chứa dữ liệu lỗi.

- Vào Edit, chọn Find hoặc nhấn Ctrl + F.

- Nhập giá trị cần tìm và tiến hành sửa.

Cách này phù hợp khi lỗi có dạng lặp lại, ví dụ nhiều dòng cùng nhập sai giá trị.

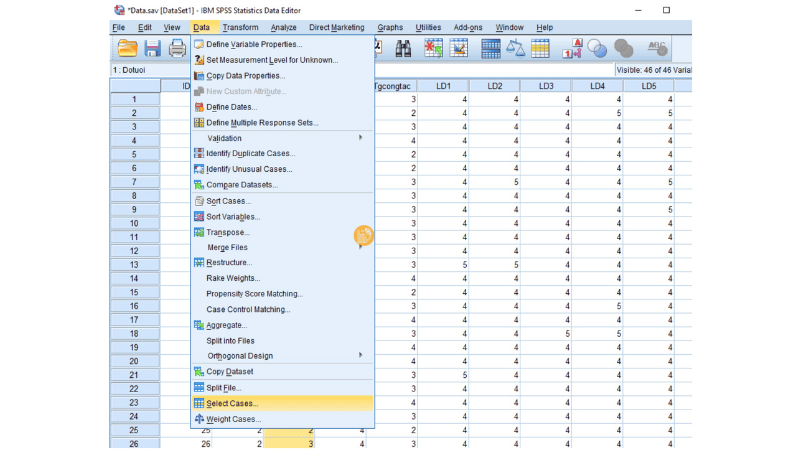

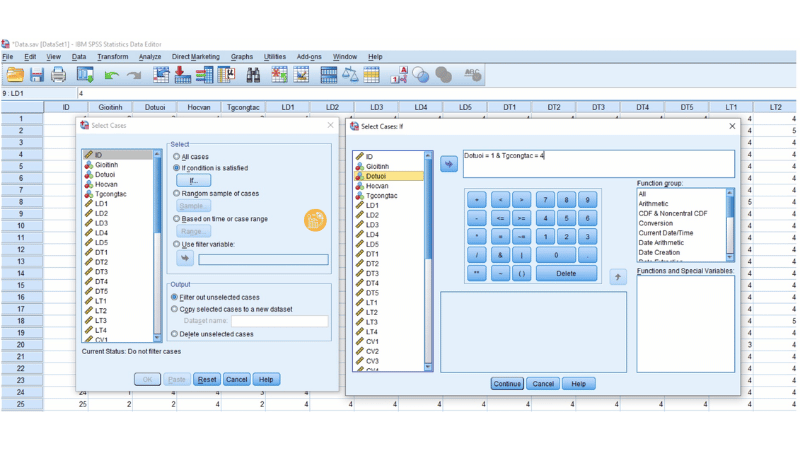

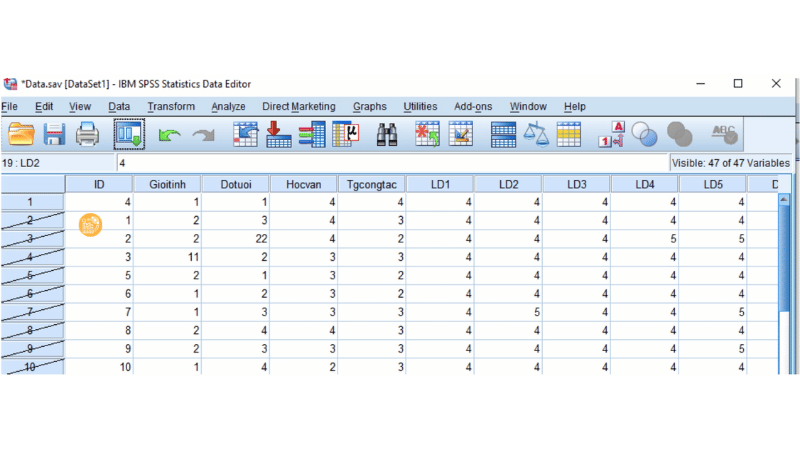

Sửa lỗi nâng cao bằng Select Cases

Select Cases là công cụ mạnh trong làm sạch số liệu bằng SPSS, đặc biệt khi lỗi được phát hiện dựa trên điều kiện logic.

Ví dụ: lọc các trường hợp có độ tuổi thấp nhưng thời gian công tác cao. Các bước:

- Vào Data, chọn Select Cases.

- Chọn If condition is satisfied.

- Nhập điều kiện logic để lọc dữ liệu bất thường.

- Nhấn OK để thực hiện.

SPSS sẽ tạo một biến lọc tạm thời, giúp người phân tích dễ dàng xác định các dòng dữ liệu sai và tiến hành chỉnh sửa.

Xử lý dữ liệu thiếu và chuẩn hóa dữ liệu

Bên cạnh lỗi nhập liệu, xử lý dữ liệu thiếu là phần không thể thiếu trong làm sạch số liệu bằng SPSS. Người phân tích cần xác định dữ liệu thiếu là ngẫu nhiên hay có hệ thống, từ đó chọn phương pháp xử lý phù hợp.

Sau khi dữ liệu đã được sửa lỗi và xử lý thiếu, bước cuối cùng là chuẩn hóa dữ liệu. Việc này giúp dữ liệu sẵn sàng cho các bước phân tích dữ liệu SPSS như hồi quy, phân tích nhân tố hay mô hình dự báo.

Các lỗi thường gặp khi làm sạch số liệu bằng SPSS

Một số lỗi phổ biến trong quá trình làm sạch số liệu bằng SPSS bao gồm:

- Chỉ kiểm tra dữ liệu một lần và bỏ sót lỗi.

- Không kiểm tra logic giữa các biến.

- Sửa dữ liệu nhưng không ghi chú lại.

- Nhầm lẫn giữa outlier thực sự và giá trị hợp lệ.

Nhận diện được các lỗi này giúp nâng cao chất lượng data cleaning và độ tin cậy của kết quả.

Kết luận

Làm sạch số liệu bằng SPSS là bước không thể thiếu trong mọi quy trình phân tích dữ liệu. Việc kiểm tra lỗi, phát hiện outlier, xử lý dữ liệu thiếu và chuẩn hóa dữ liệu giúp đảm bảo rằng các kết quả thống kê phản ánh đúng bản chất dữ liệu.

Thực hiện làm sạch số liệu bằng SPSS một cách có hệ thống sẽ giúp quá trình phân tích dữ liệu SPSS trở nên hiệu quả, chính xác và đáng tin cậy hơn.

Nếu bạn cần hỗ trợ data cleaning, phân tích dữ liệu SPSS, xử lý dữ liệu khảo sát hoặc xây dựng báo cáo nghiên cứu, hãy tham khảo tại xulysolieu.info (Xử lý số liệu) hoặc liên hệ 0878968468 để được tư vấn chi tiết.

Độ chệch Bias là gì? Khái niệm và ví dụ trong nghiên cứu khoa học

Trong phân tích dữ liệu và nghiên cứu khoa học, không chỉ độ lớn của sai số mà bản chất của sai số cũng quyết định chất lượng kết quả. Một trong những khái niệm cốt lõi nhưng thường bị hiểu chưa đầy đủ chính là độ chệch (bias). Việc hiểu đúng bản chất và cách tính độ chệch bias giúp nhà nghiên cứu đánh giá chính xác độ tin cậy của ước lượng, thiết kế nghiên cứu phù hợp và tránh những kết luận sai lệch.

Bài viết này trình bày khái niệm độ chệch bias, bản chất thống kê, cách tính độ chệch bias, các dạng bias phổ biến trong hồi quy, học máy và nghiên cứu thực nghiệm, cùng những biện pháp giảm thiểu bias trong thực hành phân tích dữ liệu.

1. Độ chệch Bias là gì?

Độ chệch, hay bias thống kê, là sai số hệ thống phản ánh sự khác biệt có tính quy luật giữa giá trị trung bình của các ước lượng và giá trị tham số thực. Khác với sai số ngẫu nhiên, bias không tự triệt tiêu khi kích thước mẫu tăng lên mà tồn tại dai dẳng nếu phương pháp ước lượng hoặc thiết kế nghiên cứu không phù hợp.

Nói một cách đơn giản, nếu một phương pháp ước lượng luôn cho kết quả cao hơn hoặc thấp hơn giá trị thực theo một hướng nhất định, thì phương pháp đó bị chệch. Việc nhận diện và cách tính độ chệch bias là bước quan trọng để đánh giá độ chính xác ước lượng.

2. Định nghĩa toán học và cách tính độ chệch Bias

Trong thống kê, độ chệch của một ước lượng được định nghĩa là hiệu giữa kỳ vọng của ước lượng và tham số thực:

Bias(θ̂) = E[θ̂] − θ

Trong đó θ̂ là ước lượng của tham số θ. Nếu Bias bằng 0, ước lượng được gọi là không chệch (unbiased). Ngược lại, nếu Bias khác 0, ước lượng bị chệch.

Trong thực tế, giá trị kỳ vọng E[θ̂] hiếm khi được tính trực tiếp, do đó cách tính độ chệch bias thường dựa trên các phương pháp xấp xỉ hoặc mô phỏng.

3. Các phương pháp thực hành để tính độ chệch Bias

Trong nghiên cứu ứng dụng và phân tích dữ liệu, cách tính độ chệch bias thường được triển khai thông qua ba nhóm phương pháp chính:

3.1. Mô phỏng Monte Carlo

Monte Carlo là phương pháp phổ biến để đánh giá bias thống kê. Người nghiên cứu tạo ra N bộ dữ liệu giả lập từ mô hình biết trước tham số thật, sau đó ước lượng tham số trên từng mẫu. Độ chệch được xấp xỉ bằng:

Bias ≈ (1/N) ∑ θ̂i − θ

Cách tính độ chệch bias này giúp đánh giá xu hướng sai lệch của phương pháp ước lượng trong điều kiện kiểm soát.

3.2. Phân tích lý thuyết

Trong một số mô hình đơn giản, bias có thể được suy ra bằng phân tích toán học, thường thông qua khai triển Taylor. Phương pháp này giúp hiểu rõ nguồn gốc bias nhưng đòi hỏi nền tảng lý thuyết vững.

3.3. Bootstrap

Bootstrap là kỹ thuật tái lấy mẫu từ dữ liệu thực để ước lượng phân phối của ước lượng. Thông qua so sánh trung bình bootstrap với ước lượng ban đầu, người ta có thể ước lượng và điều chỉnh bias. Đây là cách tính độ chệch bias rất phổ biến trong phân tích dữ liệu hiện đại.

4. Bias trong mô hình hồi quy

Trong hồi quy tuyến tính và kinh tế lượng, bias xuất hiện khi các giả thiết nền tảng của mô hình bị vi phạm. Một số dạng sai lệch dữ liệu thường gặp gồm:

4.1. Omitted-variable bias

Khi mô hình bỏ sót một biến quan trọng có tương quan với biến giải thích, ước lượng hệ số sẽ bị chệch. Đây là dạng bias phổ biến trong phân tích hồi quy và là nguyên nhân khiến kết quả không phản ánh đúng quan hệ nhân quả.

4.2. Measurement error bias

Lỗi đo lường trong biến độc lập làm hệ số hồi quy bị suy giảm, khiến ước lượng nhỏ hơn giá trị thực. Trong trường hợp này, cách tính độ chệch bias giúp đánh giá mức độ sai lệch và lựa chọn phương pháp hiệu chỉnh phù hợp.

4.3. Endogeneity

Khi biến giải thích tương quan với sai số, ước lượng OLS bị chệch và không nhất quán. Các phương pháp như biến công cụ hoặc ước lượng hai giai đoạn được sử dụng để giảm bias thống kê.

5. Bias trong học máy và phân tích dữ liệu

Trong học máy, bias được xem là thành phần hệ thống của sai số tổng thể. Sai số dự đoán thường được phân rã thành:

MSE = (Bias)2 + Variance + σ2

Mô hình quá đơn giản thường dẫn đến high bias (underfitting), trong khi mô hình quá phức tạp gây high variance (overfitting). Việc cân bằng giữa hai yếu tố này là mục tiêu cốt lõi trong thiết kế mô hình.

Ở đây, cách tính độ chệch bias không chỉ mang ý nghĩa lý thuyết mà còn giúp điều chỉnh mô hình để cải thiện khả năng khái quát.

6. Biện pháp giảm thiểu độ chệch Bias

Giảm bias là nhiệm vụ xuyên suốt từ thiết kế nghiên cứu đến phân tích dữ liệu. Một số chiến lược quan trọng bao gồm:

- Ngẫu nhiên hóa trong thiết kế nghiên cứu để giảm selection bias

- Che giấu thông tin (blinding) để hạn chế observer bias

- Điều chỉnh biến gây nhiễu bằng hồi quy đa biến

- Sử dụng propensity score để giảm confounding bias

- Regularization và cross-validation trong học máy

Việc áp dụng đúng chiến lược không chỉ làm giảm sai lệch dữ liệu mà còn nâng cao độ chính xác ước lượng.

7. Phát hiện và đánh giá Bias trong thực hành

Ngoài cách tính độ chệch bias, nhà phân tích cần phát hiện bias thông qua các công cụ chẩn đoán:

- Đồ thị phần dư để phát hiện cấu trúc sai lệch

- Bootstrap và jackknife để đánh giá bias của ước lượng

- Bland–Altman plot để so sánh hai phương pháp đo

Các công cụ này giúp nhận diện sai số hệ thống trước khi đưa ra kết luận nghiên cứu.

8. Ảnh hưởng của Bias đến kết luận nghiên cứu

Bias nếu không được kiểm soát có thể dẫn đến kết luận sai lầm, từ đánh giá quá cao hiệu ứng đến che giấu mối quan hệ quan trọng. Trong nghiên cứu ứng dụng, bias làm giảm khả năng khái quát và ảnh hưởng trực tiếp đến quyết định chính sách hoặc chiến lược.

Do đó, việc hiểu rõ cách tính độ chệch bias và kiểm soát nó là yêu cầu bắt buộc trong nghiên cứu khoa học hiện đại.

9. Hỗ trợ xử lý số liệu và đánh giá Bias

Nếu bạn gặp khó khăn trong việc xác định sai lệch dữ liệu, cách tính độ chệch bias hay điều chỉnh mô hình để nâng cao độ chính xác ước lượng, bạn có thể tham khảo dịch vụ tại xulysolieu.info – Xử lý số liệu. Đội ngũ chuyên môn hỗ trợ từ thiết kế nghiên cứu, phân tích dữ liệu đến diễn giải kết quả theo chuẩn học thuật.

Liên hệ: 0878968468 hoặc truy cập xulysolieu.info để được tư vấn chi tiết.