SEM là gì? Tổng quan về Search Engine Marketing 2025

Trong thế giới marketing số ngày nay, sem là gì luôn là câu hỏi trung tâm của các doanh nghiệp và nhà tiếp thị. SEM hay Search Engine Marketing là chiến lược thúc đẩy khả năng hiển thị của doanh nghiệp trên các trang kết quả của công cụ tìm kiếm như Google, Bing. Qua bài viết này, chúng ta sẽ cùng khám phá những khía cạnh chi tiết của SEM, đặc biệt là trong bối cảnh 2025, với các phân tích chuyên sâu về mô hình phương trình cấu trúc (SEM), các chỉ số đo lường hiệu quả, và ứng dụng của các công cụ phân tích hiện đại như Phân tích nhân tố xác nhận (CFA), Phân tích đường dẫn SmartPLS cùng Chỉ số phù hợp mô hình (CFI, RMSEA). Đây đều là những kiến thức không thể thiếu dành cho những ai muốn hiểu rõ về biến tiềm ẩn SEM và tối ưu hóa chiến lược marketing của mình.

SEM là gì và Ứng dụng của SEM trong Nghiên cứu?

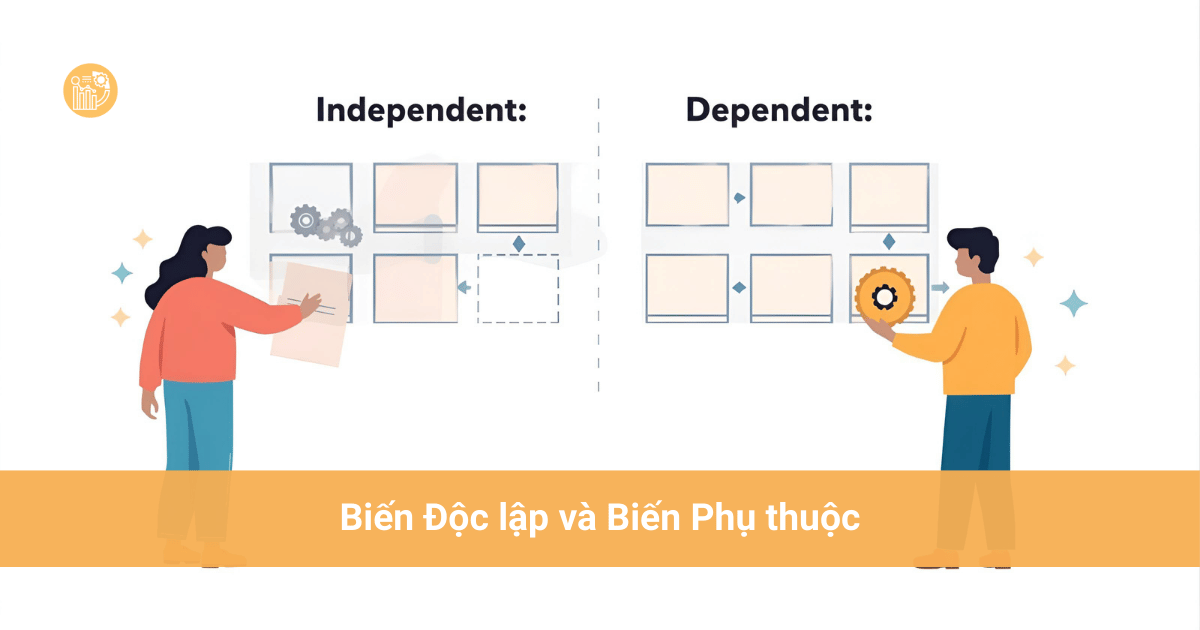

SEM là gì? Đây là một phương pháp nghiên cứu đa dạng, tích hợp giữa các kỹ thuật thống kê như phân tích nhân tố, phân tích đường dẫn, giúp các nhà nghiên cứu và doanh nghiệp xác định các mối quan hệ phức tạp giữa các biến độc lập và biến phụ thuộc. Đặc biệt, SEM không chỉ đơn thuần là công cụ phân tích dữ liệu thông thường mà còn là một phương pháp giúp kiểm định lý thuyết, phác thảo mô hình hành vi tiêu dùng hay dự báo xu hướng thị trường. Trong bối cảnh nghiên cứu, SEM phù hợp để kiểm tra các giả thuyết nghiên cứu liên quan đến mối quan hệ giữa các yếu tố tiềm ẩn như Thương hiệu, Độ tin cậy, Sự hài lòng, từ đó nâng cao khả năng ra quyết định chiến lược cho doanh nghiệp.

Trong thực tiễn, ứng dụng của SEM ngày càng phổ biến trong các lĩnh vực như quản trị kinh doanh, marketing, tâm lý học và kinh tế, đặc biệt là trong nghiên cứu chiến lược xây dựng thương hiệu hay phân tích hành vi khách hàng trực tuyến. Các nhà phân tích sử dụng SEM để tạo ra các mô hình dự báo, phân tích tác động của các yếu tố nhằm giúp doanh nghiệp tối ưu các chiến dịch truyền thông và quảng cáo, nâng cao hiệu quả chung của hoạt động marketing. Các kỹ thuật này còn giúp đo lường mức độ phù hợp của mô hình, qua đó xác định chính xác các yếu tố ảnh hưởng chính trong các chiến dịch SEM.

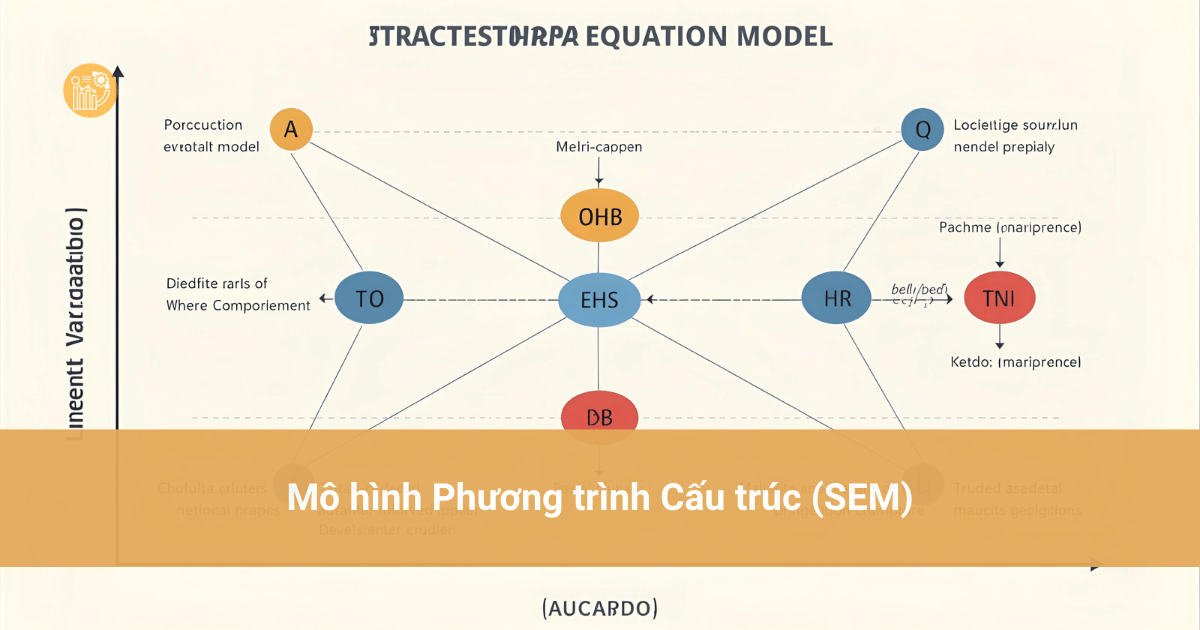

Mô hình Phương trình Cấu trúc (SEM)

Mô hình phương trình cấu trúc (Mô hình SEM) là công cụ trung tâm để thể hiện các mối quan hệ giữa các biến tiềm ẩn và biến quan sát trong nghiên cứu. Trong đó, các biến tiềm ẩn không thể đo lường trực tiếp, như cảm xúc, niềm tin hay sự trung thành, cần được xác định thông qua các chỉ số đo lường gián tiếp. Các bước thực hiện mô hình này bao gồm việc xác định giả thuyết, xây dựng mô hình, thu thập dữ liệu, hiệu chỉnh mô hình và cuối cùng là kiểm định sự phù hợp của mô hình dựa trên các chỉ số như CFI, RMSEA. Quá trình này đòi hỏi sự cẩn trọng và phân tích sâu để đảm bảo mô hình phản ánh đúng thực tế nghiên cứu.

Ngoài ra, các mô hình SEM còn có khả năng phân tích đa dạng các mối liên hệ phức tạp, từ đó cung cấp các cái nhìn toàn diện về các mối quan hệ nhân quả trong nghiên cứu. Trong thực tế, các nhà phân tích thường sử dụng phần mềm như AMOS hoặc SmartPLS để xây dựng và kiểm định mô hình, giúp dự đoán các tác động có thể xảy ra trong chiến lược marketing hoặc các chiến dịch quảng cáo trực tuyến. Việc hiểu rõ các bước thực hiện này là rất cần thiết để xây dựng các mô hình tin cậy, phù hợp và có khả năng ứng dụng cao trong lĩnh vực công nghiệp số.

Phân tích Nhân tố Xác nhận (CFA)

Phân tích nhân tố xác nhận (CFA) là một phần quan trọng trong SEM, giúp kiểm tra tính hợp lý của các biến đo lường liên quan đến các biến tiềm ẩn. Đây là bước xác nhận rằng các chỉ số quan sát thực tế phản ánh đúng các khái niệm lý thuyết đã đề ra ban đầu. Với CFA, các nhà nghiên cứu có thể đánh giá độ tin cậy của các thước đo, kiểm tra tính nhất quán nội bộ, cũng như loại trừ các yếu tố gây nhiễu. Thực hành CFA yêu cầu sự hiểu biết về mô hình lý thuyết, kỹ thuật phân tích về chỉ số như riêng rẽ (factor loadings), tỉ lệ phần trăm phương sai được giải thích, và các tiêu chuẩn phù hợp nhằm đảm bảo mô hình phù hợp với dữ liệu thu thập.

Trong đời sống thực tế, CFA còn giúp các doanh nghiệp xác định các yếu tố ảnh hưởng chính đến sự hài lòng, trung thành của khách hàng dựa trên các chỉ số đo lường khách quan. Ví dụ, trong nghiên cứu về trải nghiệm khách hàng, CFA giúp xác định xem các chỉ số như Chất lượng dịch vụ, Giá cả, Giao hàng có thực sự phản ánh các khái niệm chính khách hàng hướng tới hay không. Kết quả từ CFA còn đóng vai trò là nền tảng để xây dựng mô hình đường dẫn, tạo ra các dự báo chính xác hơn, từ đó tối ưu hóa các chiến lược tiếp thị.

Ứng dụng Phân tích Đường dẫn (Path Analysis) với SmartPLS

Phân tích đường dẫn (Path Analysis) là một kỹ thuật mạnh mẽ để thể hiện các mối quan hệ nhân quả trong SEM, đặc biệt khi làm việc với dữ liệu nhỏ hoặc dữ liệu không phù hợp để phân tích dựa trên giả định phân phối chuẩn. SmartPLS là một công cụ phần mềm phổ biến trong phân tích SEM, giúp các nhà nghiên cứu dễ dàng xây dựng và ước lượng các mô hình dựa trên phương pháp Partial Least Squares (PLS). Phân tích đường dẫn qua SmartPLS không chỉ đơn thuần chú trọng vào tính chính xác của mô hình mà còn tập trung vào khả năng dự báo các yếu tố ảnh hưởng đến nhau, giúp tối đa hóa việc đưa ra các khuyến nghị thực tiễn.

Việc ứng dụng Path Analysis trong SmartPLS còn mang lại lợi ích lớn trong các nghiên cứu về hành vi tiêu dùng hoặc dự báo xu hướng thị trường số. Với khả năng xử lý mô hình phức tạp, công cụ này giúp các nhà quản trị thiếp lập các chiến lược dựa trên dữ liệu thực tế, đồng thời có thể linh hoạt điều chỉnh các yếu tố trong mô hình để phù hợp với tình hình thị trường. Nhờ đó, các nhà phân tích có thể đưa ra các dự báo chính xác hơn, giúp doanh nghiệp đưa ra các quyết định chiến lược phù hợp và kịp thời.

Chỉ số Phù hợp Mô hình CFI

Chỉ số CFI (Comparative Fit Index) là một trong những tiêu chuẩn phổ biến giúp đánh giá mức độ phù hợp của mô hình SEM so với mô hình độc lập không có mối quan hệ nào giữa các biến. Chỉ số này phản ánh khả năng mô hình phù hợp với dữ liệu, trong đó giá trị càng gần 1 cho thấy mô hình phù hợp càng cao. Thông thường, một giá trị CFI từ 0.90 trở lên đã được chấp nhận như tiêu chuẩn đánh giá mô hình phù hợp, mang lại độ tin cậy cao trong kết quả phân tích.

Ý nghĩa của chỉ số CFI nằm ở khả năng giúp các nhà phân tích dễ dàng so sánh các mô hình, từ đó lựa chọn ra mô hình tối ưu phù hợp với dữ liệu thu thập. Trong thực tế, nếu mô hình có CFI thấp, các nhà nghiên cứu cần xem xét lại cấu trúc mô hình, có thể bổ sung hoặc loại bỏ các yếu tố chưa phù hợp, hoặc điều chỉnh các giả thuyết nghiên cứu. Việc hiểu rõ chỉ số CFI và cách đánh giá chính xác là chìa khóa để đảm bảo kết quả của SEM luôn phản ánh đúng thực tế và nâng cao tính khả thi của các dự báo, dự án marketing.

Chỉ số RMSEA

Chỉ số RMSEA (Root Mean Square Error of Approximation) đo lường mức độ phù hợp của mô hình dựa trên lỗi xấp xỉ trung bình trong các giả thuyết mô hình. Nó phản ánh mức độ khác biệt giữa mô hình đề xuất và dữ liệu quan sát, trong đó giá trị RMSEA thấp hơn biểu thị mô hình phù hợp tốt hơn. Theo các tiêu chuẩn chung, một RMSEA nhỏ hơn 0,08 thể hiện mô hình phù hợp trung bình, còn dưới 0,05 là phù hợp cao, mang lại độ chính xác và tin cậy tối đa.

Trong thực tiễn, RMSEA giúp các nhà phân tích xác định xem mô hình có phù hợp thực tế hay không, đồng thời cảnh báo những điểm chưa rõ ràng hoặc còn thiếu tối ưu trong mô hình nghiên cứu. Việc nghiên cứu mô hình phù hợp với RMSEA thấp còn giúp tăng tính khả thi của các dự báo dựa trên mô hình, từ đó hỗ trợ đưa ra các quyết định chiến lược chính xác hơn trong các dự án SEM ứng dụng marketing hoặc phân tích nhân tố trong nghiên cứu thị trường số.

Biến Tiềm ẩn (Latent Variable) trong SEM: Vai trò và Cách đo lường

Biến tiềm ẩn SEM đóng vai trò trung tâm trong mô hình, đại diện cho các khái niệm trừu tượng như niềm tin, sự hài lòng hay trải nghiệm khách hàng mà không thể đo lường trực tiếp. Thay vào đó, chúng được phản ánh qua các biến quan sát thông qua các chỉ số đo lường phù hợp, giúp các nhà phân tích dễ dàng kiểm tra mức độ phù hợp của giả thuyết nghiên cứu. Việc xác định rõ các biến tiềm ẩn trong mô hình giúp tăng tính toàn diện, phản ánh đúng các yếu tố tác động trong thực tế.

Cách đo lường Biến tiềm ẩn trong SEM thường dựa trên các chỉ số như factor loadings, tỉ lệ phương sai được giải thích và các tiêu chuẩn phù hợp như Chỉ số phù hợp mô hình (CFI, RMSEA). Khi mô hình có các biến tiềm ẩn được xác định chính xác, các dự báo về mối quan hệ nhân quả sẽ có độ tin cậy cao hơn, hỗ trợ các nhà phân tích đưa ra các chiến lược marketing dựa trên dữ liệu rõ ràng và chứng cứ vững chắc.

So sánh AMOS và SmartPLS trong Phân tích SEM: Ưu điểm và Nhược điểm

AMOS là phần mềm truyền thống, thường dùng cho các mô hình SEM dựa trên giả định phân phối chuẩn, phù hợp với các dữ liệu lớn và có tính phù hợp cao khi xây dựng các mô hình phức tạp. Trong khi đó, SmartPLS lại nổi bật với khả năng xử lý các mô hình nhỏ hơn, dữ liệu phi phân phối và giảm thiểu yêu cầu về giả định thống kê. Sự khác biệt này khiến lựa chọn giữa hai công cụ phụ thuộc vào mục đích nghiên cứu, quy mô dữ liệu và độ phức tạp của mô hình.

Trong thực tế, AMOS phù hợp hơn trong các nghiên cứu đòi hỏi mô hình có tính chuẩn xác cao, còn SmartPLS là lựa chọn tối ưu cho các dự án marketing số, phân tích hành vi khách hàng hoặc dự báo xu hướng thị trường trực tuyến. Các nhà phân tích cần tổng hợp ưu nhược điểm của từng công cụ để lựa chọn phù hợp, nhằm tối đa hóa hiệu quả phân tích và ra quyết định nhanh chóng, chính xác hơn trong thực tế kinh doanh.

Tiêu chí Đánh giá Độ tin cậy và Giá trị hội tụ trong SEM

Độ tin cậy của mô hình SEM thể hiện qua các chỉ số như Cronbach’s alpha và Composite Reliability (CR), giúp xác định mức độ nhất quán của các thước đo trong mô hình. Đồng thời, giá trị hội tụ thể hiện khả năng các biến đo lường thể hiện đúng các khái niệm mong muốn, thường được đánh giá qua Hệ số hợp lý (AVE). Các chỉ số này rất quan trọng để đảm bảo rằng mô hình không chỉ phù hợp về mặt thống kê mà còn có khả năng phản ánh thực tiễn chính xác.

Trong thực tế, việc đánh giá độ tin cậy và giá trị hội tụ giúp các nhà phân tích xác định mức độ phù hợp của các thước đo, tránh các sai số gây mất uy tín và độ chính xác của kết quả nghiên cứu. Một mô hình có độ tin cậy cao sẽ giúp các chiến dịch SEM đạt hiệu quả tốt hơn, từ đó củng cố niềm tin của các nhà quản trị và khách hàng đối với chiến lược của doanh nghiệp.

Các lỗi thường gặp và cách khắc phục trong Phân tích SEM

Trong quá trình phân tích SEM, các nhà nghiên cứu thường gặp phải những lỗi phổ biến như mô hình chưa phù hợp, số lượng mẫu nhỏ hoặc dữ liệu không đầy đủ. Ngoài ra, việc chọn sai phần mềm, hoặc chưa tối ưu hóa các chỉ số phù hợp như CFI, RMSEA cũng ảnh hưởng lớn đến kết quả cuối cùng. Để khắc phục, cần kiểm tra kỹ các giả thuyết, đảm bảo dữ liệu đủ tiêu chuẩn và sử dụng các công cụ phân tích hiện đại để hiệu chỉnh mô hình phù hợp hơn.

Tiến trình khắc phục lỗi còn bao gồm việc tinh chỉnh mô hình dựa trên dữ liệu thực tế, thực hiện kiểm định lại các chỉ số phù hợp hoặc loại bỏ các biến không phù hợp. Đồng thời, việc nâng cao kiến thức về Mô hình phương trình cấu trúc (SEM), về Phân tích nhân tố xác nhận (CFA) và Phân tích đường dẫn SmartPLS sẽ giúp các nhà nghiên cứu thực hiện các phân tích chính xác và hiệu quả hơn, từ đó nâng cao độ tin cậy của các dự báo và chiến lược marketing.

Tổng kết

Trong bối cảnh 2025, SEM vẫn tiếp tục là một công cụ phân tích không thể thiếu đối với các chiến lược marketing, nghiên cứu thị trường, tâm lý khách hàng và quản trị doanh nghiệp. Hiểu rõ sem là gì và các thành phần của nó như mô hình phương trình cấu trúc, phân tích nhân tố xác nhận hay Phân tích đường dẫn không chỉ giúp các nhà nghiên cứu có các dự báo chính xác mà còn giúp tối ưu chiến lược dựa trên dữ liệu khách quan, có căn cứ. Việc chọn lựa các công cụ phù hợp như AMOS hay SmartPLS, cùng với việc đảm bảo các chỉ số như CFI, RMSEA đạt tiêu chuẩn, sẽ nâng cao hiệu quả phân tích. Điều quan trọng nhất vẫn là sự kiên trì, kiến thức chuyên sâu và khả năng thích nghi với các diễn biến thị trường ngày càng tinh vi để vận dụng SEM một cách linh hoạt, hiệu quả.

SEM không chỉ là công cụ phân tích dữ liệu, mà còn là cầu nối giúp doanh nghiệp chuyển đổi dữ liệu thành lợi thế cạnh tranh rõ ràng và bền vững trên thị trường toàn cầu. Các nhà nghiên cứu và nhà marketing hãy luôn cập nhật các kiến thức mới, kỹ thuật phân tích tiên tiến để khai thác tối đa giá trị từ SEM và góp phần hình thành các chiến lược đột phá trong kỷ nguyên số.

Phương sai và độ lệch chuẩn: Hướng dẫn cách giải chi tiết

Trong lĩnh vực thống kê, phương sai và độ lệch chuẩn đóng vai trò là những chỉ số quan trọng giúp chúng ta hiểu rõ hơn về mức độ phân tán của dữ liệu. Việc nắm vững cách tính và ứng dụng của hai chỉ số này không chỉ nâng cao khả năng phân tích dữ liệu mà còn giúp ra quyết định chính xác hơn trong nhiều lĩnh vực khác nhau.

Giới thiệu về phương sai và độ lệch chuẩn

Phương sai và độ lệch chuẩn là hai khái niệm liên quan chặt chẽ, giúp đánh giá mức độ biến động của tập dữ liệu. Hiểu rõ về chúng sẽ làm nền tảng cho việc phân tích dữ liệu, từ đó áp dụng hiệu quả vào các khâu nghiên cứu, quản lý hoặc dự báo.

Định nghĩa phương sai

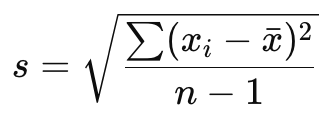

Phương sai (sx²) là một chỉ số đo mức độ phân tán của dữ liệu so với trung bình. Nó thể hiện mức độ mà các phần tử trong dữ liệu lệch khỏi trung tâm, giúp xác định dữ liệu có đồng đều hay không. Trong thực tế, phương sai cho biết mức độ dao động của các giá trị xung quanh trung bình chung, từ đó cung cấp cái nhìn sâu sắc về tính ổn định của dữ liệu.

Phương sai càng lớn thường biểu thị dữ liệu trải rộng nhiều hơn, tức là có nhiều giá trị nằm xa trung bình. Ngược lại, phương sai nhỏ thể hiện dữ liệu có tính gắn kết chặt chẽ quanh trung bình, ít biến động. Điều này rất hữu ích trong các phân tích về phân phối dữ liệu, rủi ro hoặc tính ổn định của hệ thống.

Định nghĩa độ lệch chuẩn

Độ lệch chuẩn (sx) là căn bậc hai của phương sai, mang ý nghĩa là mức độ phân tán tính theo đơn vị của dữ liệu ban đầu. Nó giúp ta dễ hình dung hơn so với phương sai bởi vì đơn vị đo của độ lệch chuẩn giống với dữ liệu gốc. Độ lệch chuẩn phản ánh mức độ mà các phần tử của dữ liệu phân bổ so với trung bình, từ đó dễ dàng hơn để diễn giải ý nghĩa thực tiễn của phân tán.

Trong thực tế, độ lệch chuẩn có thể xem là “các bức tường” giới hạn phạm vi biến động của dữ liệu, giúp các nhà phân tích xác định phạm vi nội tại của dữ liệu trong một tập hợp các giá trị. Nhờ đó, người dùng có thể đưa ra các giả thuyết hoặc dự đoán phù hợp hơn dựa trên độ rộng của phân phối dữ liệu.

Tầm quan trọng của phương sai và độ lệch chuẩn trong thống kê

Phương sai và độ lệch chuẩn không chỉ là những chỉ số mô tả dữ liệu, mà còn là công cụ định lượng giúp ra quyết định trong các mô hình phân tích dữ liệu phức tạp như Ma trận hiệp phương sai hay Giả định ANOVA trong SPSS. Chúng cho phép các nhà thống kê xác định mức độ biến động của dữ liệu, phân biệt các nhóm dữ liệu, hoặc xác định mức độ ổn định trong các hệ thống vận hành.

Trong các lĩnh vực như khoa học xã hội, y học, kinh tế, hay kỹ thuật, việc hiểu rõ về phương sai và độ lệch chuẩn giúp các nhà nghiên cứu phát hiện những yếu tố gây biến động lớn hoặc điều chỉnh phương pháp phân tích phù hợp. Chính vì vậy, hai chỉ số này có vai trò nền tảng trong quá trình phân tích dữ liệu, từ đó đưa ra các kết luận chính xác, khách quan hơn.

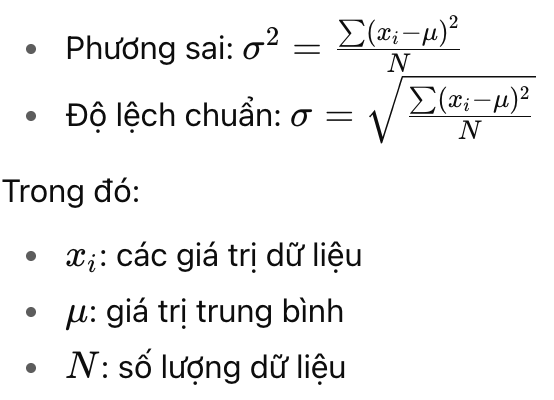

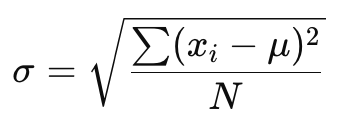

Công thức tính phương sai và độ lệch chuẩn

Phương pháp tính phương sai và độ lệch chuẩn được xây dựng dựa trên công thức toán học rõ ràng và chính xác nhằm đảm bảo tính đúng đắn và tin cậy của dữ liệu phân tích. Trong thực hành, các công thức này còn có thể thay đổi phù hợp với từng loại dữ liệu như dữ liệu mẫu hay toàn bộ.

Trong công thức tính phương sai, ta tính trung bình cộng của các phần tử đã được chuẩn hóa bằng trung bình, rồi lấy tổng bình phương chênh lệch này. Đối với dữ liệu dạng phân phối tần số hoặc ghép lớp, ta có thể áp dụng công thức phù hợp để dễ dàng tính toán. Độ lệch chuẩn được xác định bằng căn bậc hai của phương sai, giúp biểu diễn mức độ phân tán theo cùng một đơn vị với dữ liệu gốc, làm cho việc diễn giải trở nên trực quan hơn.

Ứng dụng của phương sai và độ lệch chuẩn trong thực tế

Phương sai và độ lệch chuẩn có mặt trong rất nhiều lĩnh vực, đóng vai trò như các công cụ phân tích dữ liệu giúp nâng cao hiệu quả nghiên cứu, quản lý và dự báo.

Phân tích dữ liệu trong khoa học xã hội

Trong nghiên cứu xã hội, dữ liệu về hành vi, thái độ hoặc thu nhập thường biến động rất lớn. Việc sử dụng phương sai và độ lệch chuẩn giúp các nhà nghiên cứu xác định mức độ biến động này là bao nhiêu, từ đó điều chỉnh phương pháp thu thập dữ liệu hoặc phân tích phù hợp hơn. Đặc biệt, trong các bài phân tích về hành vi nhóm, các chỉ số này cung cấp cái nhìn sâu rộng về mức độ đa dạng trong mẫu khảo sát.

Chẳng hạn, khi phân tích điểm số của sinh viên, việc tính phương sai giúp nhận biết liệu lớp học có sự chênh lệch lớn về kết quả hay không. Trong các nghiên cứu về sự khác biệt giữa các nhóm xã hội, những số liệu này còn giúp xác định độ đồng đều của mẫu, từ đó đưa ra các kết luận hợp lý và chính xác hơn.

Quản lý chất lượng sản phẩm

Trong công nghiệp, việc kiểm tra phương sai của các thông số sản phẩm như kích thước, trọng lượng hoặc tính năng giúp các nhà quản lý đảm bảo sản phẩm đáp ứng tiêu chuẩn. Dữ liệu về độ lệch chuẩn thể hiện mức độ biến đổi của quá trình sản xuất, từ đó phát hiện những điểm bất ổn hoặc các yếu tố gây lỗi trong quy trình.

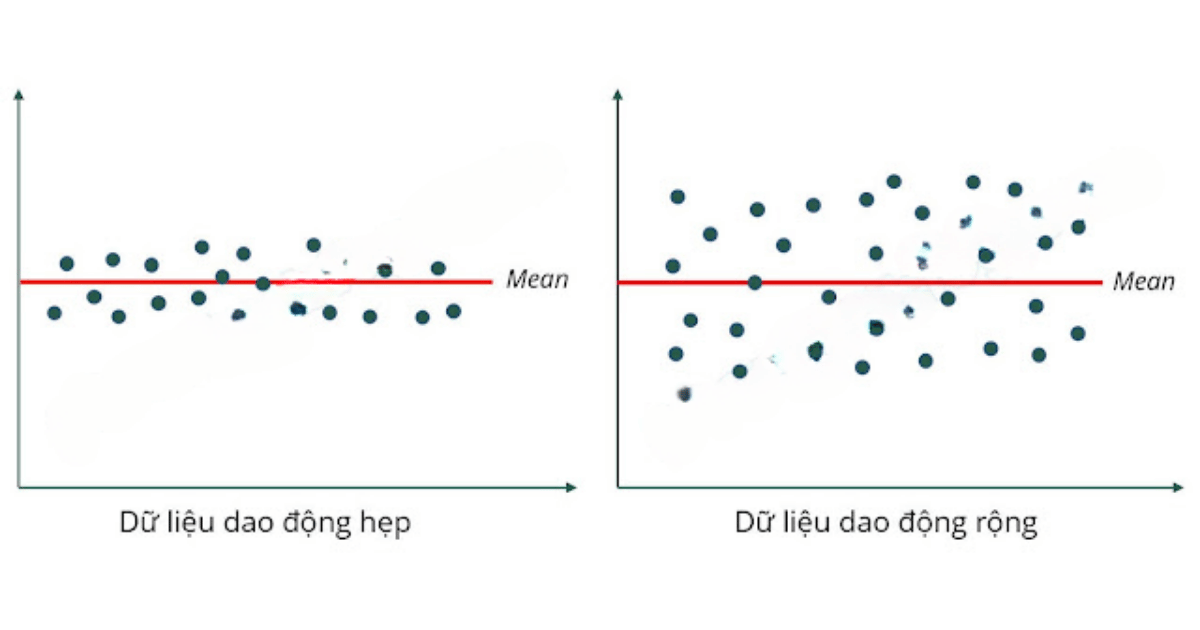

Chẳng hạn như, trong kiểm định chất lượng bóng đèn, dùng phương sai để đo độ đồng nhất của các bóng đèn sản xuất ra, từ đó điều chỉnh quy trình để hạn chế lỗi. Cùng với đó, hệ số biến thiên (CV) còn cho biết mức độ biến động so với trung bình, giúp nhà quản lý nhanh chóng nhận diện các vấn đề cần giải quyết, nâng cao năng suất và chất lượng sản phẩm.

Đánh giá rủi ro tài chính

Trong lĩnh vực tài chính, phương sai và độ lệch chuẩn được sử dụng để đo lường mức độ biến động của tỷ suất sinh lợi, giúp các nhà đầu tư hoặc quản lý danh mục đầu tư đưa ra các quyết định phù hợp. Chẳng hạn, một khoản đầu tư có độ lệch chuẩn cao thường đi kèm với rủi ro cao hơn nhưng tiềm năng lợi nhuận lớn hơn.

Ngoài ra, việc phân tích Ma trận hiệp phương sai còn giúp xác định các quan hệ tương tác giữa các khoản đầu tư, từ đó xây dựng danh mục tối ưu nhằm giảm thiểu rủi ro tổng thể. Trong phân tích tài chính, giả định ANOVA trong SPSS cũng có thể được áp dụng để kiểm tra sự khác biệt về hiệu quả đầu tư giữa các nhóm hoặc điều kiện thị trường khác nhau.

So sánh phân phối dữ liệu giữa các nhóm khác nhau

Khi muốn đánh giá sự khác biệt giữa các nhóm, như giữa các lớp học, các khu vực hoặc các thời kỳ, các chỉ số phương sai và độ lệch chuẩn giúp phản ánh rõ ràng sự phân phối của dữ liệu. Toàn bộ quá trình này còn thông qua các phương pháp như Kiểm tra chuẩn (Shapiro-Wilk) để xác định xem dữ liệu có phân phối chuẩn hay không — yếu tố quyết định trong việc chọn các phương pháp phân tích phù hợp.

Việc so sánh các chỉ số này còn giúp đánh giá tính đồng nhất của các nhóm, cũng như xác định xem các sự khác biệt là có ý nghĩa thực tiễn hay chỉ là ngẫu nhiên. Dựa trên đó, các nhà phân tích sẽ quyết định sử dụng các kiểm định phù hợp để đưa ra kết luận chính xác.

Các bước để tính phương sai và độ lệch chuẩn từ dữ liệu

Để tính phương sai và độ lệch chuẩn một cách chính xác, cần thực hiện theo các bước rõ ràng và có hệ thống. Quá trình này đảm bảo tính khách quan của phân tích và giúp tránh các sai sót không đáng có.

Thu thập dữ liệu chính xác

Chất lượng của dữ liệu quyết định trực tiếp đến tính đúng đắn của các chỉ số phân tán. Vì vậy, việc thu thập dữ liệu phải cẩn thận, chính xác, đầy đủ và rõ ràng, tránh các yếu tố gây nhiễu loạn hoặc nhầm lẫn trong quá trình nhập liệu.

Các phương pháp thu thập dữ liệu phù hợp như khảo sát, quan sát hoặc đo lường đều cần đảm bảo độ chính xác cao nhất có thể. Đồng thời, kiểm tra dữ liệu đầu vào để phát hiện các dữ liệu ngoại lai hoặc thiếu sót giúp quá trình phân tích về sau chính xác hơn, hạn chế ảnh hưởng của các yếu tố này tới kết quả cuối cùng.

Tính trung bình dữ liệu

Sau khi có dữ liệu, bước tiếp theo là tính trung bình cộng (x̄). Công thức đơn giản nhưng rất quan trọng, vì trung bình sẽ làm trung tâm cho các phép tính tiếp theo. Việc này giúp xác định điểm “gốc” để đo mức độ phân tán của từng phần tử quanh trung tâm đó.

Trong quá trình tính, cần chú ý sử dụng các phần mềm hoặc công cụ tính toán để đảm bảo độ chính xác, thay vì tính tay dễ gây sai sót. Trong các phần mềm thống kê như SPSS, R hoặc Excel, việc tính trung bình diễn ra nhanh chóng và chính xác, hạn chế các sai sót không đáng có.

Tính chênh lệch từng phần tử so với trung bình

Bước này nhằm xác định khoảng cách của từng phần tử khỏi trung bình, thể hiện bằng công thức (x_i – x̄). Những chênh lệch này phản ánh các mức độ lệch của từng giá trị, là cơ sở để tính phương sai và độ lệch chuẩn.

Quan trọng là phải tính đúng số chênh lệch và chú ý xem xét các dữ liệu ngoại lai hoặc bất thường. Các phần mềm thống kê cho phép dễ dàng thực hiện bước này, giúp tránh sai sót trong tính toán thủ công và đảm bảo độ tin cậy của kết quả. Đồng thời, việc này còn giúp các nhà phân tích hiểu rõ hơn về phân phối của dữ liệu, từ đó có thể điều chỉnh hoặc xử lý các dữ liệu bất thường phù hợp.

Tích luỹ và chia theo công thức phù hợp

Cuối cùng, dựa vào các chênh lệch đã tính, ta sẽ tích luỹ các bình phương chênh lệch rồi chia theo công thức phù hợp để có phương sai. Phương pháp này giúp đo lường chính xác mức độ phân tán của dữ liệu quanh trung bình.

Tuỳ vào mục đích và loại dữ liệu, chúng ta có thể tính phương sai dựa trên toàn bộ dữ liệu (khi có dữ liệu của toàn bộ tổng thể) hoặc mẫu dữ liệu (khi chỉ lấy đại diện). Các phần mềm thống kê hiện đại sẽ giúp tự động thực hiện các thao tác này, giảm thiểu công việc thủ công và sai sót trong tính toán.

Các yếu tố ảnh hưởng đến phương sai và độ lệch chuẩn

Chất lượng và tính phản ánh của các chỉ số phương sai, độ lệch chuẩn còn phụ thuộc vào những yếu tố như đặc điểm dữ liệu, phương pháp xử lý dữ liệu ngoại lai hoặc dữ liệu thiếu.

Đặc điểm của dữ liệu (phân phối, kích thước mẫu)

Phân phối dữ liệu có tác động lớn đến cách tính và giải thích các chỉ số này. Các dữ liệu phân phối chuẩn thường dựa vào các giả định như giả định ANOVA trong SPSS, hoặc kiểm tra Kiểm tra chuẩn (Shapiro-Wilk) để xác định xem dữ liệu có phân phối chuẩn hay không. Nếu dữ liệu không phù hợp với giả định này, việc phân tích phải điều chỉnh phù hợp.

Kích thước mẫu cũng ảnh hưởng đến độ chính xác của các chỉ số. Mẫu quá nhỏ có thể dẫn tới kết quả không ổn định, trong khi mẫu lớn hơn sẽ phản ánh rõ nét hơn về đặc điểm phân phối của tổng thể. Chính vì vậy, việc xác định đúng kích cỡ mẫu là một phần quan trọng trong quá trình phân tích thống kê.

Độ biến động của dữ liệu

Dữ liệu có mức độ biến động cao sẽ dẫn đến các phương sai và độ lệch chuẩn lớn hơn. Đặc biệt, các yếu tố như tính ngẫu nhiên, biến thiên tự nhiên hoặc sự thay đổi của các yếu tố môi trường sẽ làm tăng độ phân tán của dữ liệu.

Trong phân tích thực tế, việc đánh giá rõ ràng độ biến động giúp nhà nghiên cứu quyết định có nên tiếp tục phân tích hay không, hoặc cần xử lý dữ liệu để giảm thiểu tác động của các yếu tố gây nhiễu. Bao gồm việc loại bỏ dữ liệu ngoại lai hoặc biến dạng dữ liệu để tăng tính chính xác của các chỉ số thống kê.

Cách xử lý dữ liệu ngoại lai và dữ liệu thiếu

Dữ liệu ngoại lai hoặc thiếu sẽ gây ảnh hưởng lớn đến phương sai và độ lệch chuẩn, làm cho các số liệu này không phản ánh đúng thực tế. Để xử lý tốt, cần có các biện pháp như loại bỏ ngoại lai, chuẩn hóa dữ liệu hoặc sử dụng các phương pháp thay thế phù hợp.

Chẳng hạn, việc áp dụng Ước lượng Bootstrap giúp tăng độ tin cậy của kết quả khi dữ liệu có nhiều ngoại lai hoặc ít dữ liệu. Ngoài ra, cần đảm bảo dữ liệu đầy đủ, tránh bỏ sót phần lớn thông tin quan trọng, để đảm bảo các phân tích sau này phản ánh chính xác tình hình thực tế của tập dữ liệu.

So sánh phương sai và độ lệch chuẩn trong các tình huống cụ thể

Việc lựa chọn sử dụng phương sai hay độ lệch chuẩn phụ thuộc vào mục đích phân tích cũng như tính chất của dữ liệu.

Khi nào sử dụng phương sai

Phương sai thích hợp khi bạn cần đo lường mức độ phân tán của dữ liệu trong các phân tích tổng thể, đặc biệt trong các mô hình thống kê phức tạp như Ma trận hiệp phương sai hoặc phân tích phương pháp ANOVA. Phương sai thường được dùng trong các tính toán lý thuyết và mô hình, giúp các nhà thống kê có thể viết các công thức, dự báo hoặc phân tích giả thuyết.

Trong các bài toán tính độ phân tán của các dữ liệu lớn, dữ liệu có phạm vi rộng hoặc yêu cầu phân tích chi tiết, phương sai là chỉ số phù hợp hơn. Tuy nhiên, khi cần diễn giải trực quan hoặc trình bày các kết quả cho người không chuyên, độ lệch chuẩn sẽ là lựa chọn tối ưu do dễ hiểu hơn.

Khi nào nên dùng độ lệch chuẩn

Độ lệch chuẩn phù hợp để mô tả phân tán dữ liệu trong các tình huống thực tế khi cần đưa ra các kết luận dễ hiểu, trực quan về mức độ biến động như phạm vi của dữ liệu, độ đồng đều hoặc phân phối của các giá trị. Nó phù hợp trong các báo cáo dữ liệu, thuyết trình hoặc phân tích các biến số riêng lẻ.

Ngoài ra, hệ số biến thiên (CV) cũng thường dùng để so sánh độ phân tán giữa các dữ liệu có đơn vị khác nhau hoặc trung bình khác nhau. Trong nhiều trường hợp, mức độ phân tán được thể hiện tốt nhất qua độ lệch chuẩn, giúp người đọc dễ hình dung và so sánh hơn.

Ưu điểm và nhược điểm của từng chỉ số

Phương sai có ưu điểm là thể hiện chi tiết mức độ phân tán, phù hợp cho các mô hình lý thuyết và tính toán chính xác. Tuy nhiên, nhược điểm là không trực quan bằng độ lệch chuẩn do đơn vị đo không giống dữ liệu gốc, gây khó hiểu khi diễn giải.

Ngược lại, độ lệch chuẩn dễ hiểu hơn, giúp hình dung rõ ràng mức độ biến động, phù hợp cho các ứng dụng thực tế, nhưng lại mang ý nghĩa ít chính xác hơn trong các phân tích lý thuyết hay mô hình dự báo vì không phản ánh chi tiết các phần tử phân tán.

Các vấn đề thường gặp khi tính toán và diễn giải

Không ít người gặp khó khăn hoặc hiểu sai khi làm việc với phương sai và độ lệch chuẩn, dẫn tới các kết luận không chính xác hoặc gây nhầm lẫn trong quá trình phân tích.

Nhầm lẫn giữa phương sai và độ lệch chuẩn

Nhiều người dễ nhầm lẫn giữa hai chỉ số này, đặc biệt trong quá trình diễn giải kết quả. Phương sai là giá trị bình phương của độ lệch chuẩn, do đó khi so sánh phải lưu ý đến mối liên hệ này để tránh hiểu sai về mức độ phân tán của dữ liệu.

Chẳng hạn, một số người nghĩ rằng phương sai nhỏ hơn độ lệch chuẩn, điều này đúng theo nghĩa toán học nhưng gây nhầm lẫn khi trình bày kết quả. Tuy nhiên, hiểu rõ mối quan hệ này giúp phân tích chính xác và rõ ràng hơn, từ đó tránh các sai sót trong báo cáo hoặc phân tích dữ liệu.

Sai sót trong làm tròn số và tính toán

Việc làm tròn số quá mức hoặc tính toán thủ công dễ gây ra sai lệch, đặc biệt khi dữ liệu lớn hoặc số lượng phần tử nhiều. Việc sử dụng các phần mềm như SPSS, Excel hoặc R là giải pháp tối ưu để giảm thiểu các sai sót này, đồng thời đảm bảo độ chính xác của kết quả.

Ngoài ra, việc kiểm tra lại các phép tính, đặc biệt trong giai đoạn chuẩn bị dữ liệu hoặc xử lý ngoại lai, cũng rất quan trọng để duy trì độ chính xác của phân tích. Hạn chế tối đa việc làm tròn quá sớm khi tính toán để tránh sai lệch trong bước cuối cùng.

Hiểu nhầm ý nghĩa của các chỉ số trong phân tích

Một thách thức lớn là hiểu đúng vai trò và ý nghĩa của phương sai và độ lệch chuẩn. Nhiều người chỉ chú ý đến giá trị số, mà bỏ qua ý nghĩa thực tiễn của chúng trong bối cảnh của từng lĩnh vực: như mức độ ổn định của hệ thống, sự khác biệt giữa các nhóm hoặc tính chất phân phối của dữ liệu.

Việc này đòi hỏi phải có kiến thức nền tảng về thống kê, cũng như sự phân tích ngữ cảnh để diễn giải các số liệu một cách chính xác, phù hợp nhằm cung cấp kết luận có giá trị thực tiễn.

Câu hỏi thường gặp

Phương sai khác gì so với độ lệch chuẩn?

Phương sai là bình phương của độ lệch chuẩn, nên nó cung cấp một thước đo chính xác hơn về mức độ phân tán của dữ liệu, nhưng không thân thiện trong việc diễn giải. Độ lệch chuẩn biểu thị mức độ phân tán theo cùng đơn vị dữ liệu gốc, dễ hiểu hơn để hình dung phạm vi biến động.

Tại sao độ lệch chuẩn lại phổ biến hơn phương sai?

Vì độ lệch chuẩn có đơn vị đo giống với dữ liệu ban đầu, giúp dễ dàng hình dung và so sánh hơn so với phương sai, vốn có đơn vị bình phương của dữ liệu. Điều này giúp các nhà thống kê và người dùng cuối đưa ra nhận xét rõ ràng hơn về mức độ biến động của dữ liệu.

Làm thế nào để giảm thiểu phương sai trong dữ liệu?

Để giảm phương sai, cần kiểm soát các yếu tố gây biến động lớn như dữ liệu ngoại lai, lỗi nhập dữ liệu hoặc phân phối không đều. Các biện pháp như chuẩn hóa dữ liệu, loại bỏ ngoại lai, hoặc thu thập dữ liệu chất lượng cao hơn góp phần giảm phương sai và làm dữ liệu thống nhất hơn.

Có thể sử dụng phương sai và độ lệch chuẩn để dự đoán không?

Chúng được dùng để mô tả và xác định mức độ biến động của dữ liệu, song không trực tiếp để dự báo chính xác các giá trị tương lai. Tuy nhiên, chúng cung cấp các thông tin quan trọng để xây dựng các mô hình dự báo có độ chính xác cao hơn, đặc biệt khi kết hợp với các phương pháp thống kê khác.

Những hạn chế của phương sai và độ lệch chuẩn là gì?

Chúng không phản ánh được hình dạng phân phối dữ liệu, đặc biệt khi dữ liệu không phân phối chuẩn hoặc có nhiều ngoại lai. Ngoài ra, chúng còn có thể bị ảnh hưởng lớn bởi các ngoại lai hoặc dữ liệu thiếu, gây ra kết quả không chính xác hoặc gây hiểu nhầm.

Kết luận

Phương sai và độ lệch chuẩn là những chỉ số trung tâm trong thống kê, giúp nâng cao khả năng phân tích dữ liệu, ra quyết định chính xác và tin cậy hơn. Việc hiểu rõ về công thức tính, ứng dụng thực tế, cũng như các yếu tố ảnh hưởng, sẽ giúp các nhà nghiên cứu, nhà phân tích khai thác tối đa giá trị của dữ liệu. Chọn đúng công cụ, áp dụng phù hợp và diễn giải chính xác các chỉ số sẽ là yếu tố quyết định đưa đến thành công trong các dự án phân tích dữ liệu.

Tổng kết: Việc nắm vững và vận dụng đúng cách phương sai và độ lệch chuẩn sẽ giúp bạn phân tích dữ liệu một cách hiệu quả, chính xác và ứng dụng vào đa dạng lĩnh vực như khoa học xã hội, quản lý chất lượng, tài chính hay so sánh nhóm dữ liệu. Đặc biệt, các phương pháp nâng cao như Ma trận hiệp phương sai, Giả định ANOVA trong SPSS hay Ước lượng Bootstrap sẽ làm phong phú thêm khả năng phân tích và dự báo của bạn trong nghiên cứu và thực tiễn.

Hướng dẫn phân tích thành phần chính Principal Component Analysis (PCA) – Phần 2

Trong quá trình nghiên cứu và xử lý dữ liệu, PCA đã trở thành công cụ mạnh mẽ để giảm chiều dữ liệu, khai thác đặc trưng và trực quan hóa. Phần 2 của bài viết này sẽ đi sâu vào mối quan hệ giữa PCA và SVD, cách lựa chọn Thành phần chính thứ hai, các phương pháp nâng cao và những ứng dụng thực tế. Đối tượng hướng tới không chỉ là người mới bắt đầu mà còn những nhà phân tích dữ liệu muốn nâng cao kiến thức về PCA và các kỹ thuật mở rộng. Với nội dung giàu tính học thuật và thực hành, chúng ta sẽ cùng khám phá các lý thuyết đi kèm các ví dụ thực tế bằng Python.

Ở bài viết này ta mở rộng từ phần 1 để xem mối liên hệ giữa PCA và SVD, cách chọn chiều K, một số lưu ý thực tế và hai ứng dụng tiêu biểu: Eigenface và Unsupervised Anomaly Detection.

1. Mối liên hệ giữa PCA và SVD

1.1. SVD và xấp xỉ ma trận hạng thấp

Nếu cần xấp xỉ một ma trận X bằng một ma trận A có hạng không vượt quá k, nghiệm tối ưu chính là Truncated SVD:

Nếu X = U Σ V^T thì xấp xỉ hạng-k là A = U_k Σ_k V_k^T.

1.2. Ý tưởng PCA

PCA tìm ma trận trực giao U_k và biểu diễn thấp chiều Z để tối thiểu hóa sai số tái tạo:

min_{U_k,Z} ||X - U_k Z||_F s.t. U_k^T U_k = I

1.3. Kết luận

Khi dữ liệu đã được chuẩn hóa (mean = 0), nghiệm PCA rút ra trực tiếp từ Truncated SVD: U_k là các cột đầu của ma trận U trong SVD và Z = Σ_k V_k^T. Do đó, về bản chất, PCA là một trường hợp đặc biệt của SVD.

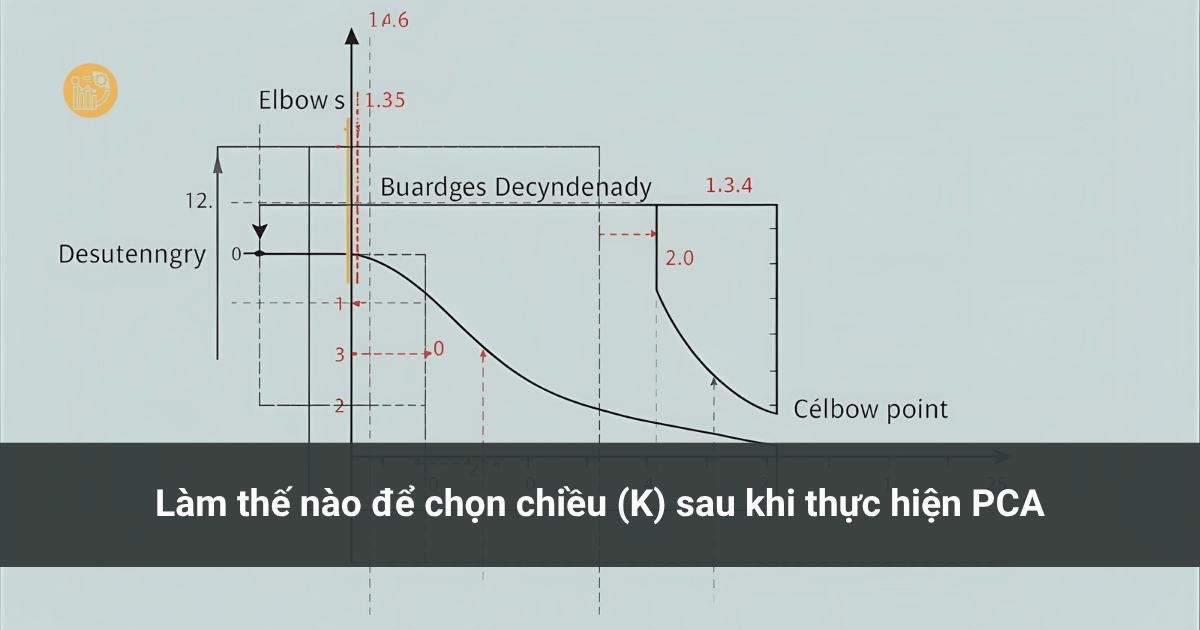

2. Cách chọn số chiều K

Một phương pháp phổ biến là dựa vào tỉ lệ phương sai được giữ lại. Nếu λ1..D là các trị riêng giảm dần của ma trận hiệp phương sai, thì:

rK = (Σi=1..K λi) / (Σj=1..D λj)

Chọn K nhỏ nhất sao cho r_K đạt ngưỡng mong muốn (ví dụ 0.95 hoặc 0.99). Khi dữ liệu nằm gần một subspace, vài trị riêng đầu thường chiếm phần lớn phương sai — khi đó K có thể rất nhỏ.

3. Lưu ý khi áp dụng PCA trong thực tế

3.1. Trường hợp D > N (số chiều nhiều hơn số mẫu)

Khi D > N, ma trận hiệp phương sai S = (1/N) X X^T có hạng ≤ N. Thay vì tính trị riêng của S (kích thước D×D), ta có thể tính trị riêng của T = X^T X (kích thước N×N) rồi suy ra vector riêng của S bằng X u. Cách này tiết kiệm bộ nhớ và thời gian.

3.2. Chuẩn hóa các vector riêng

Với ma trận đối xứng, vector riêng tương ứng với các trị riêng khác nhau là trực giao. Kết hợp Gram–Schmidt, ta chuẩn hóa để thu được hệ trực chuẩn U_k cho PCA.

3.3. PCA quy mô lớn (Large-scale PCA)

Với dữ liệu rất lớn (triệu ảnh, nghìn chiều), tính trực tiếp trị riêng không khả thi. Power Iteration là một phương pháp xấp xỉ nhanh trị riêng lớn nhất. Dùng deflation để tìm các trị riêng kế tiếp. Kỹ thuật này được dùng trong nhiều hệ thống quy mô lớn (ví dụ PageRank).

4. Ví dụ minh họa

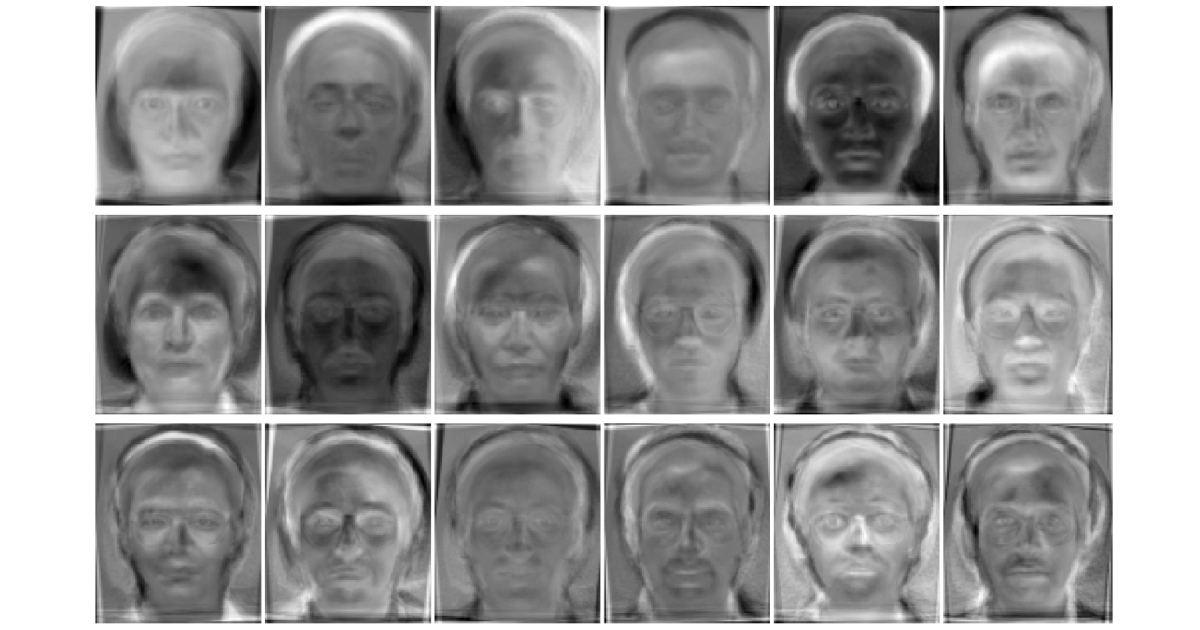

4.1. Eigenface — nén ảnh khuôn mặt bằng PCA

Eigenface là ứng dụng kinh điển của PCA trong nhận dạng khuôn mặt. Mỗi ảnh (ví dụ 116×98 = 11.368 chiều) có thể được nén xuống vài trăm chiều với PCA, giữ đặc trưng cần thiết cho nhận dạng.

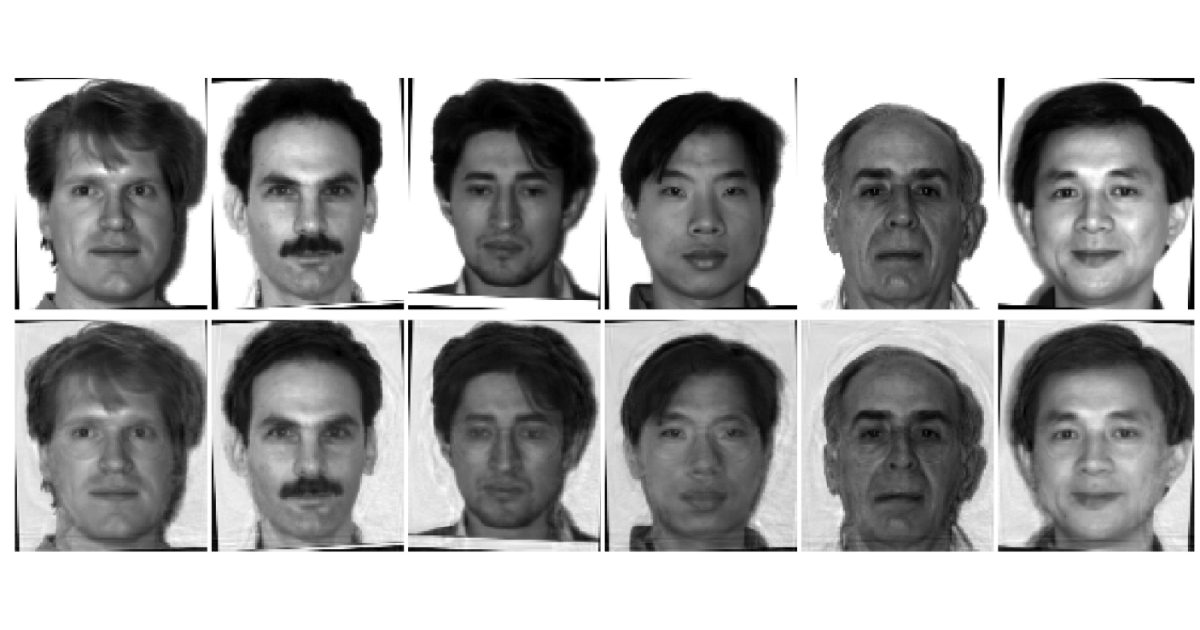

Ví dụ về ảnh của một người trong Yale Face Database

Đoạn mã minh họa dùng sklearn (lưu ý: sklearn xử lý mẫu theo hàng — nếu dữ liệu bạn theo cột, hãy transpose):

import numpy as np

from scipy import misc

from sklearn.decomposition import PCA

path = 'unpadded/'

ids = range(1, 16)

states = ['centerlight','glasses','happy','leftlight','noglasses','normal',

'rightlight','sad','sleepy','surprised','wink']

h, w, K = 116, 98, 100

D, N = h*w, len(states)*15

X = np.zeros((D, N))

cnt = 0

for i in ids:

for s in states:

fn = f"{path}subject{str(i).zfill(2)}.{s}.pgm"

X[:, cnt] = misc.imread(fn).reshape(D)

cnt += 1

pca = PCA(n_components=K)

pca.fit(X.T)

U = pca.components_.T

Khi tái tạo ảnh từ K = 100 thành phần chính, ảnh thu được sẽ có nhiễu nhưng vẫn giữ các đặc trưng khuôn mặt — cho thấy PCA nén dữ liệu hiệu quả.

Các eigenfaces tìm được bằng PCA.

Hàng trên: các ảnh gốc. Hàng dưới: các ảnh được suy ra từ eigenfaces. Ảnh ở hàng dưới có nhiều nhiễu nhưng vẫn mang những đặc điểm riêng mà mắt người có thể phân biệt được.

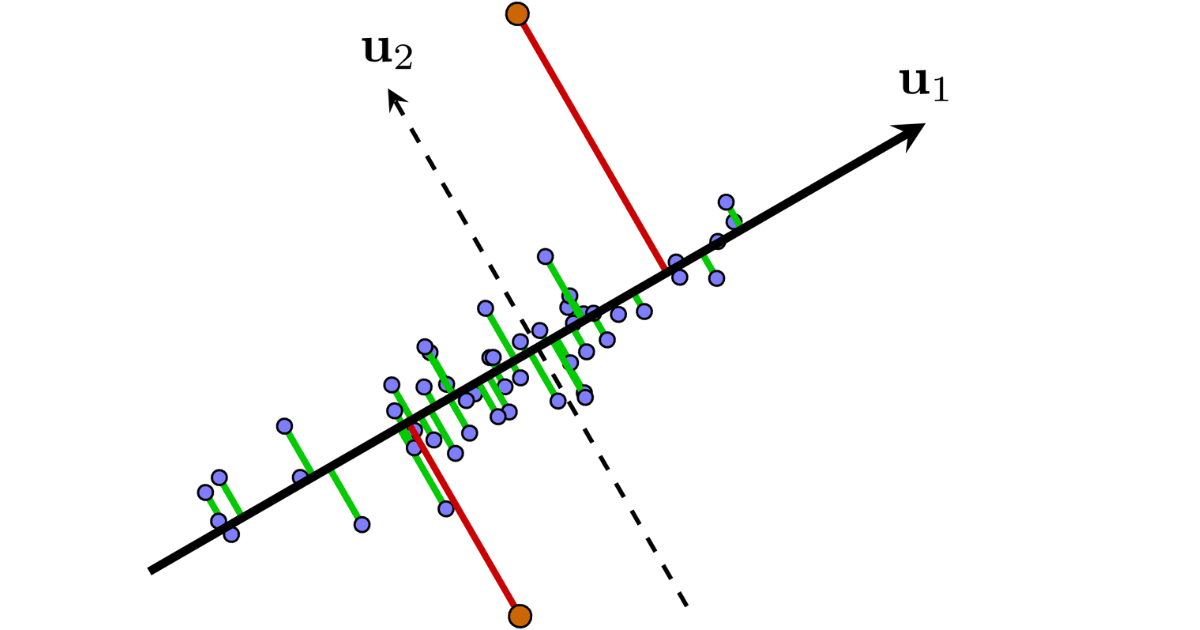

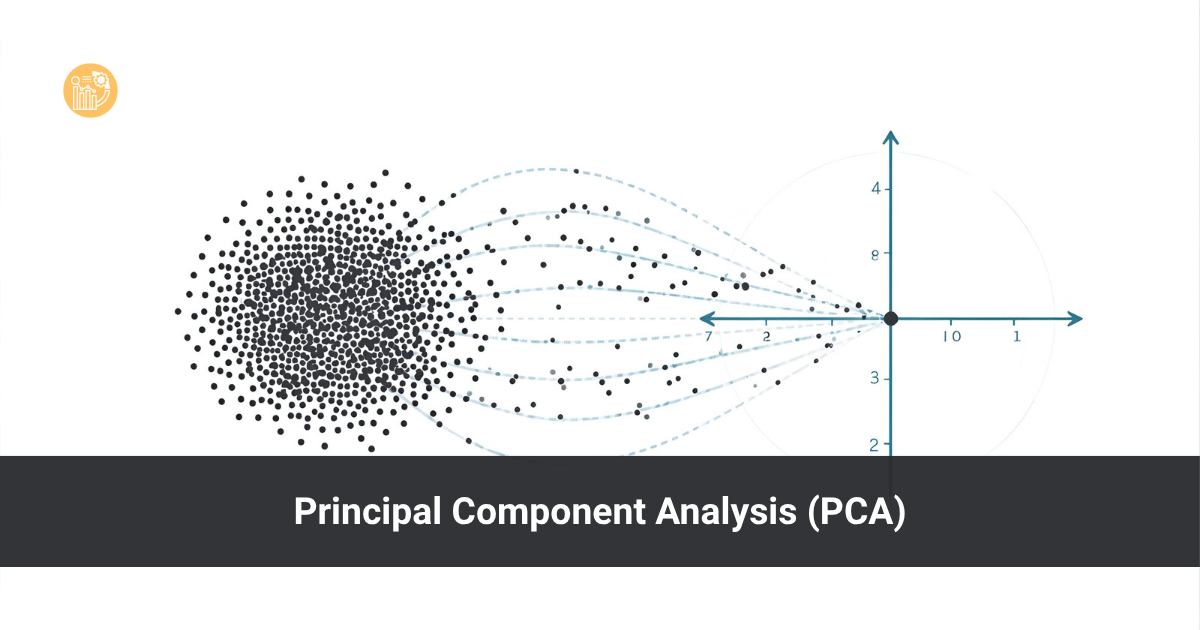

4.2. Phát hiện bất thường (Unsupervised Anomaly Detection) với PCA

Ý tưởng: các điểm “normal” nằm gần một subspace; các điểm “abnormal” nằm xa subspace đó. Thực hiện PCA trên toàn bộ dữ liệu, tính khoảng cách của mỗi điểm tới subspace được tạo bởi các thành phần chính; điểm có khoảng cách lớn được coi là bất thường.

PCA cho việc xác định các sự kiện ‘abnormal’ với giả sử rằng các sự kiện ‘normal’ chiếm đa số và nằm gần trong một không gian con nào đó. Khi đó, nếu làm PCA trên toàn bộ dữ liệu, không gian con thu được gần với không gian con của tập các sự kiện ‘normal’. Lúc này, các điểm quá xa không gian con này, trong trường hợp này là các điểm màu cam, có thể được coi là các sự kiện ‘abnormal’.

5. Thảo luận & Gợi ý mở rộng

- PCA là phương pháp unsupervised — không tận dụng nhãn. Nếu mục tiêu là phân biệt lớp, cân nhắc dùng LDA hoặc các phương pháp supervised khác.

- Với dữ liệu lớn, dùng Incremental PCA hoặc Randomized SVD để giảm tiêu thụ bộ nhớ và tăng tốc.

- Các biến thể hữu ích: Sparse PCA, Kernel PCA, Robust PCA tùy ngữ cảnh.

Hướng dẫn phân tích thành phần chính Principal Component Analysis (PCA) – Phần 1

Trong thế giới ngày nay, dữ liệu trở thành một trong những tài nguyên quý giá bậc nhất của các nhà nghiên cứu, nhà phát triển và doanh nghiệp. Đặc biệt trong lĩnh vực Machine Learning, pca hay còn gọi là phân tích thành phần chính đã trở thành một kỹ thuật không thể thiếu để xử lý các dữ liệu có đa chiều cao, giúp giảm chiều dữ liệu một cách tối ưu mà không làm mất đi quá nhiều thông tin quan trọng. Điểm đặc biệt của phương pháp này chính là khả năng tìm ra hệ cơ sở mới trong không gian dữ liệu, qua đó giúp các mô hình phân tích và dự đoán vận hành một cách trơn tru hơn.

Trong bài viết này, chúng ta sẽ đi làm rõ về các khái niệm nền tảng của pca, các bước thực hiện, cũng như các công cụ phổ biến hỗ trợ như Phân tích thành phần chính SPSS, phép phân rã giá trị riêng, hoặc biểu đồ Scree. Ngoài ra, bài viết còn phân tích chi tiết về cách xây dựng các ma trận tải trọng yếu tố, giảm chiều dữ liệu bằng các phần mềm như AMOS, nhằm giúp người đọc dễ hình dung và ứng dụng một cách rõ ràng và hiệu quả.

1. Giới thiệu

Dimensionality Reduction (Giảm chiều dữ liệu) là một trong những kỹ thuật quan trọng trong Machine Learning. Các feature vectors trong thực tế có thể có số chiều rất lớn (vài nghìn), dẫn đến khó khăn về lưu trữ và tốc độ tính toán. Giảm chiều giúp nén dữ liệu, tăng hiệu quả tính toán và loại bỏ nhiễu.

Một cách đơn giản, Dimensionality Reduction là việc tìm hàm:

x ∈ R^D → z ∈ R^K, với K < D

Trong bài này, ta sẽ tìm hiểu PCA (Principal Component Analysis) – phương pháp giảm chiều tuyến tính cơ bản và phổ biến nhất.

2. Một chút toán

2.1. Norm 2 của ma trận

||A||₂ = maxₓ (||A·x||₂ / ||x||₂)

Đặt điều kiện ||x||₂ = 1, ta có:

||A||₂ = max||x||₂=1 ||A·x||₂

Giải bằng phương pháp Lagrange:

L(x, λ) = ||A·x||₂² + λ(1 - ||x||₂²) ⇒ AᵀA·x = λ·x

⇒ λ là trị riêng (eigenvalue) của AᵀA, và x là vector riêng (eigenvector) tương ứng.

Kết luận: Norm 2 của ma trận A chính là singular value lớn nhất của A.

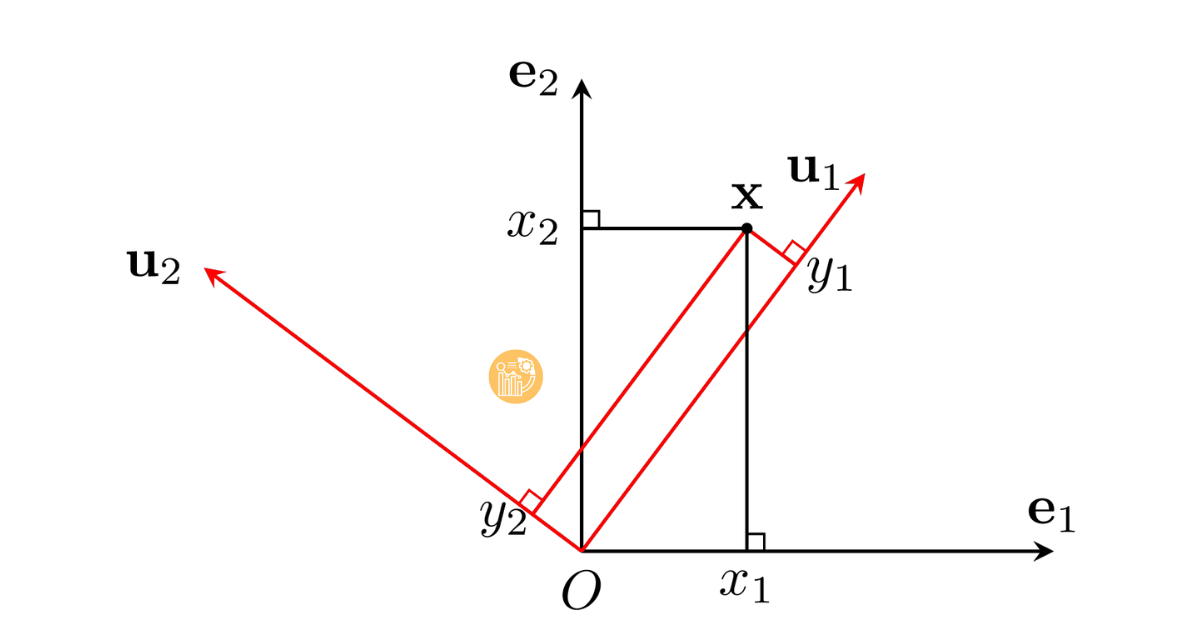

2.2. Biểu diễn vector trong các hệ cơ sở khác nhau

x = y₁u₁ + y₂u₂ + ... + y_Du_D = U·y ⇒ y = U⁻¹x

Nếu U là ma trận trực giao, thì U⁻¹ = Uᵀ, do đó:

y = Uᵀx

→ Đây là cách chuyển hệ cơ sở (xoay trục toạ độ trong không gian vector).

Hình 1: Chuyển đổi toạ độ trong các hệ cơ sở khác nhau.

2.3. Tính chất của Trace

- trace(A) = trace(Aᵀ)

- trace(AB) = trace(BA)

- ||A||F² = trace(AᵀA) = trace(AAᵀ)

- trace(A) = ∑λi (tổng các trị riêng)

2.4. Kỳ vọng và ma trận hiệp phương sai

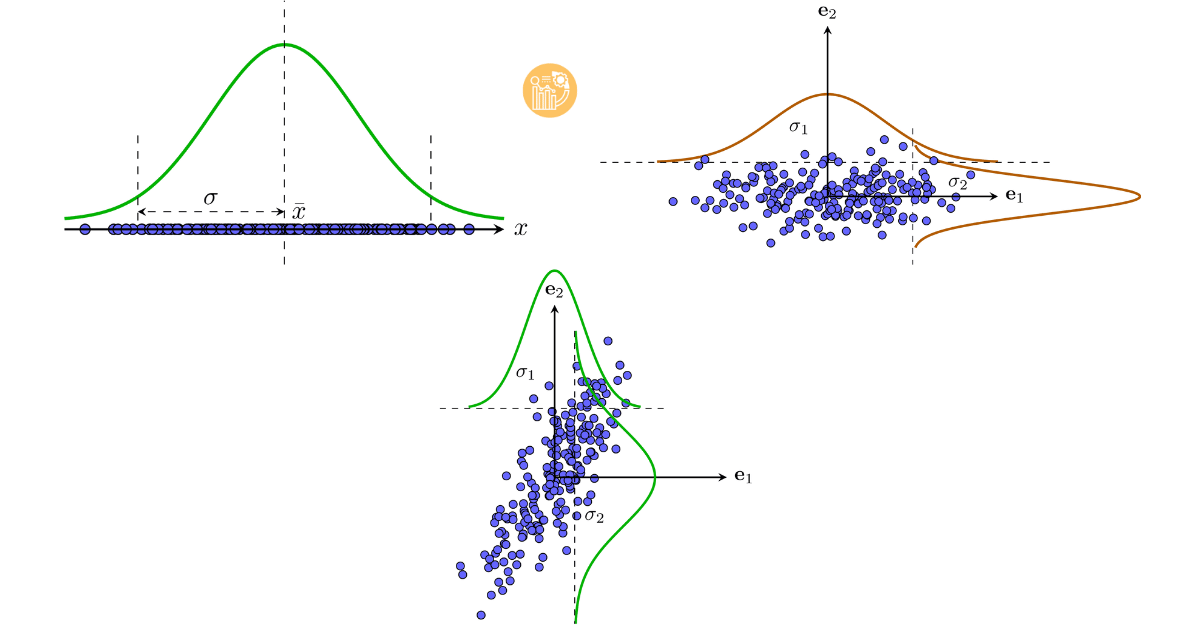

a) Dữ liệu 1 chiều

x̄ = (1/N) ∑xᵢ σ² = (1/N) ∑(xᵢ - x̄)²

b) Dữ liệu nhiều chiều

x̄ = (1/N) ∑xᵢ S = (1/N) ∑(xᵢ - x̄)(xᵢ - x̄)ᵀ

Đặc điểm:

- S là ma trận đối xứng và nửa xác định dương

- Phần tử chéo: phương sai từng chiều

- Phần tử ngoài chéo: hiệp phương sai giữa các chiều

Ví dụ về kỳ vọng và phương sai. a) Trong không gian 1 chiều. b) Không gian 2 chiều mà hai chiều không tương quan. Trong trường hợp này, ma trận hiệp phương sai là ma trận đường chéo với hai phần tử trên đường chéo là σ1, σ2, đây cũng chính là hai trị riêng của ma trận hiệp phương sai và là phương sai của mỗi chiều dữ liệu. c) Dữ liệu trong không gian hai chiều có tương quan. Theo mỗi chiều, ta có thể tính được kỳ vọng và phương sai. Phương sai càng lớn thì dữ liệu trong chiều đó càng phân tán. Trong ví dụ này, dữ liệu theo chiều thứ hai phân tán nhiều hơn so so với chiều thứ nhất.

3. Principal Component Analysis (PCA)

Ý tưởng chính

PCA tìm hệ cơ sở mới (U) sao cho thông tin dữ liệu chủ yếu nằm ở một vài trục chính (principal components). Các chiều có phương sai nhỏ sẽ bị loại bỏ.

Ví dụ: Nếu bạn có 2 camera chụp một người — ảnh chính diện chứa nhiều thông tin hơn ảnh chụp từ trên đầu → có thể bỏ ảnh thứ hai mà không mất mát đáng kể thông tin.

Ý tưởng chính của PCA: Tìm một hệ trực chuẩn mới sao cho trong hệ này, các thành phần quan trọng nhất nằm trong K thành phần đầu tiên.

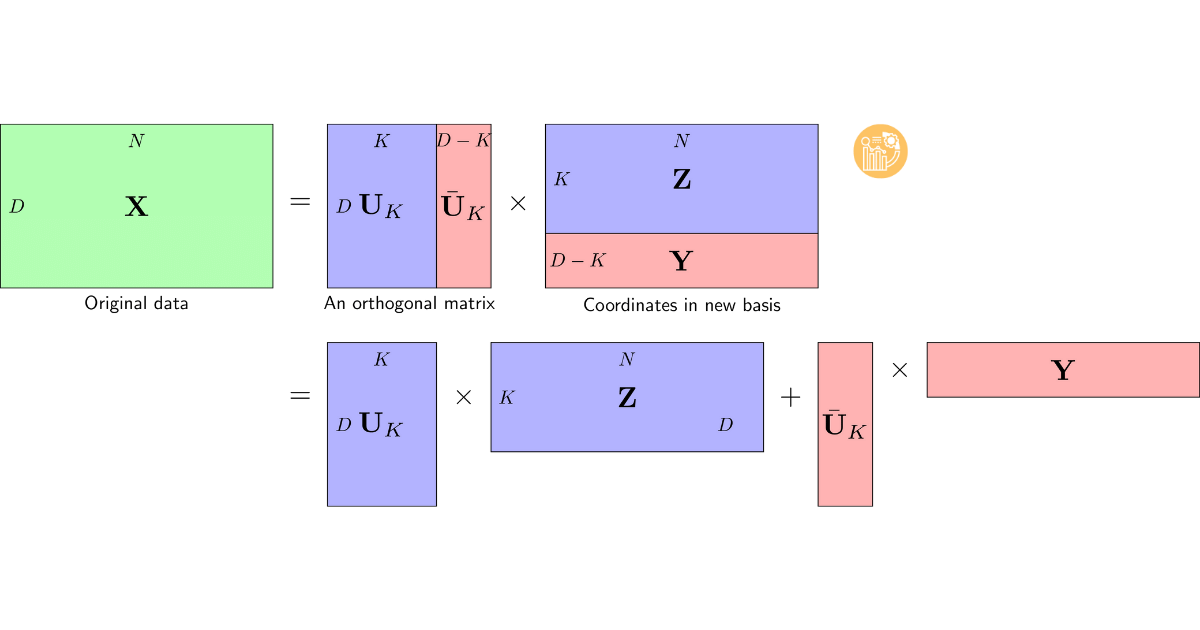

Biểu diễn PCA

U = [Uₖ, Ūₖ] X = UₖZ + ŪₖY Z = UₖᵀX, Y = ŪₖᵀX

Ta muốn tìm U sao cho phần ŪₖY là ít thông tin nhất.

Sau khi chuẩn hoá dữ liệu (trừ trung bình):

Ẋ = X - x̄·1ᵀ

Mục tiêu tối ưu PCA là:

minU ||X - UₖZ||F²

Tương đương với:

J = ∑i=K+1D uᵢᵀ S uᵢ

Định lý chính

Định lý: Hàm F = ∑i=1K uᵢᵀ S uᵢ đạt giá trị lớn nhất khi uᵢ là các vector riêng ứng với K trị riêng lớn nhất của S.

Khi đó:

- λ₁, λ₂, …, λₖ: các thành phần chính (principal components).

- PCA giữ lại các chiều có phương sai lớn nhất → chứa nhiều thông tin nhất.

Góc nhìn thống kê

PCA có thể hiểu như một phép xoay hệ trục sao cho dữ liệu tập trung chủ yếu vào vài trục chính. Các trục còn lại có phương sai rất nhỏ, có thể bỏ qua mà không ảnh hưởng nhiều.

Tổng phương sai giữ lại:

Variance_retained = ∑λi (i = 1 → K)

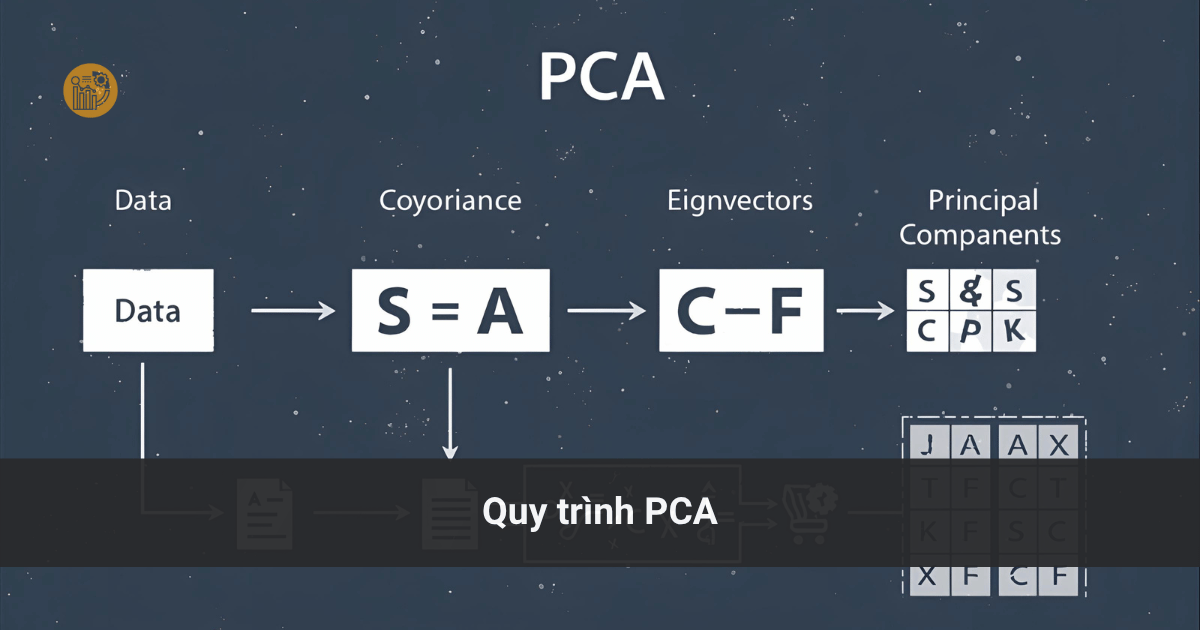

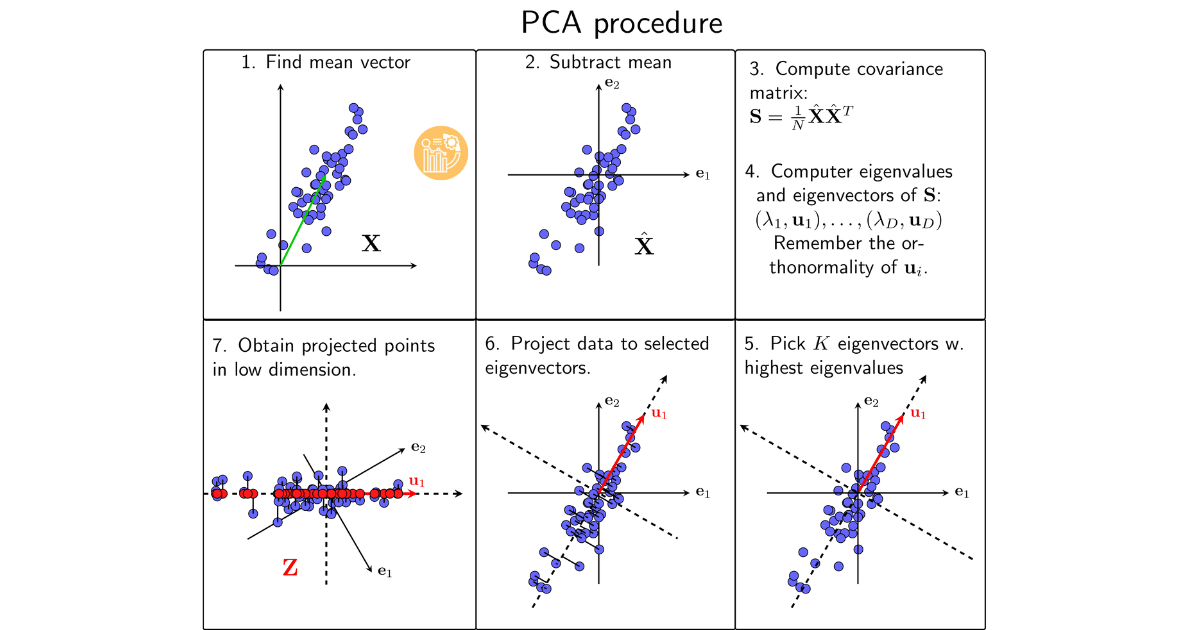

Quy trình PCA

- Chuẩn hóa dữ liệu: trừ mỗi vector cho giá trị trung bình.

- Tính ma trận hiệp phương sai: S = (1/N) ẊẊᵀ.

- Tính trị riêng và vector riêng của S.

- Chọn K vector riêng lớn nhất tương ứng với K trị riêng lớn nhất.

- Chiếu dữ liệu vào không gian mới: Z = UₖᵀẊ.

Các bước thực hiện PCA

Ghi chú

- Tổng phương sai trong mọi hệ cơ sở là không đổi.

- PCA không cần giả định phân phối dữ liệu, chỉ dựa vào phương sai.

- Ứng dụng của PCA:

- Giảm số chiều trước khi huấn luyện mô hình ML

- Trực quan hóa dữ liệu đa chiều

- Giảm nhiễu, nén dữ liệu

Kết luận

PCA là phương pháp giảm chiều tuyến tính mạnh mẽ và trực quan, giúp giữ lại phần lớn thông tin của dữ liệu, giảm số chiều tính toán, đồng thời dễ dàng phát hiện cấu trúc ẩn trong dữ liệu.

Công thức tính phương sai và độ lệch chuẩn – Hướng dẫn chi tiết

Trong phần này chúng ta trình bày các công thức tính phương sai và độ lệch chuẩn, kèm ví dụ minh hoạ và bài tập tự luyện. Bài viết theo layout rõ ràng: định nghĩa → công thức cho dữ liệu rời rạc (tập hợp) → công thức cho bảng tần số → ví dụ thực tế → bài tập. Việc hiểu và chọn đúng công thức (mẫu hay tổng thể) giúp ước lượng chính xác hơn và phát hiện ngoại lai hiệu quả.

Các khái niệm cơ bản liên quan đến độ lệch chuẩn

Để hiểu rõ hơn về công thức độ lệch chuẩn, chúng ta cần nắm vững các khái niệm nền tảng như trung bình cộng, phân phối xác suất, sai số chuẩn trung bình,… Những khái niệm này giúp xây dựng nền tảng vững chắc, từ đó áp dụng các công thức một cách chính xác và hiệu quả.

Trung bình cộng và trung bình mẫu là các khái niệm thường gặp trong thống kê mô tả. Chúng phản ánh trung tâm của tập hợp dữ liệu, đồng thời đóng vai trò quan trọng trong việc xác định độ lệch chuẩn. Phân phối xác suất và phân phối mẫu giúp dự đoán cách dữ liệu phân bố, từ đó xác định các đặc trưng như trung vị, độ lệch, và khả năng xuất hiện của các giá trị. Sai số tiêu chuẩn và độ lệch chuẩn là các chỉ số đo mức độ phân tán xung quanh trung bình, cung cấp cái nhìn toàn diện về tính ổn định của dữ liệu.

Trung bình cộng và trung bình mẫu

Trung bình cộng là một khái niệm quen thuộc, được tính bằng tổng tất cả các giá trị dữ liệu chia cho số phần tử. Đối với dữ liệu mẫu, trung bình mẫu là trung bình của các phần tử trong mẫu, thường được ký hiệu là x̄. Nó giúp xác định điểm trung tâm của dữ liệu, từ đó làm cơ sở cho các phép tính như phương sai hay độ lệch chuẩn. Trong phân tích thống kê, trung bình là chỉ số quan trọng nhất, tuy nhiên, cần phải xem xét thêm về độ phân tán để có bức tranh đầy đủ.

Tuy nhiên, trung bình không phản ánh rõ sự phân tán của dữ liệu, do đó, sự kết hợp của nó với độ lệch chuẩn mang lại hiểu biết toàn diện hơn. Các biến thể trong dữ liệu, ví dụ như các điểm dữ liệu ngoại lệ, có thể ảnh hưởng lớn đến trung bình. Vì vậy, việc phân tích độ lệch chuẩn giúp biết được mức độ phân tán và độ ổn định của dữ liệu, tránh ra quyết định dựa trên các số liệu trung bình không phản ánh đúng tình hình thực tế.

Phân phối xác suất và phân phối mẫu

Phân phối xác suất là lý thuyết mô tả cách các biến ngẫu nhiên phân bố theo những quy luật xác định, giúp dự đoán xác suất xuất hiện của các giá trị trong một tập hợp. Trong thống kê mô tả, phân phối mẫu xuất hiện khi ta lấy nhiều mẫu nhỏ từ cùng một tổng thể, qua đó xác định các đặc điểm chung của dữ liệu. Chúng ta cần hiểu rõ về phân phối để có thể áp dụng các công thức tính toán như phương sai và độ lệch chuẩn cho phù hợp.

Phân phối mẫu còn giúp xây dựng các ước lượng, kiểm định giả thuyết, và xác định mức độ tin cậy của các kết quả phân tích. Trong thực tế, các dataset lớn thường được thu thập qua nhiều mẫu nhỏ, sau đó thông qua phân phối mẫu, các nhà phân tích có thể thực hiện các phép tính chính xác hơn, đồng thời hiểu rõ hơn về tính chất của tập dữ liệu. Bên cạnh đó, việc xử lý ngoại lệ trong dữ liệu cũng liên quan mật thiết đến phân phối mẫu, giúp xác định các điểm dữ liệu bất thường cần loại bỏ hoặc xử lý phù hợp.

Sai số tiêu chuẩn và độ lệch chuẩn

Sai số tiêu chuẩn và độ lệch chuẩn là các chỉ số đo lường sự biến thiên của dữ liệu, phản ánh mức độ phân tán quanh trung bình. Trong đó, sai số chuẩn trung bình thể hiện mức độ chính xác của trung bình mẫu khi so sánh với trung bình tổng thể. Độ lệch chuẩn được xem là thước đo khả năng phân tán của các điểm dữ liệu, giúp các nhà phân tích định lượng rủi ro, biến động, và ổn định của dữ liệu.

Việc hiểu rõ sự khác nhau giữa sai số tiêu chuẩn và độ lệch chuẩn cũng giúp tránh những sai lầm phổ biến khi phân tích dữ liệu. Sai số tiêu chuẩn nhỏ cho thấy trung bình mẫu gần đúng với tổng thể, còn độ lệch chuẩn lớn cho thấy dữ liệu phân tán rộng. Trong quá trình phân tích dữ liệu thực tế, việc kiểm tra, làm sạch dữ liệu ngoại lệ và xác định đúng loại độ lệch chuẩn phù hợp là điều kiện cần thiết để đảm bảo kết quả chính xác, đáng tin cậy.

Công thức tính phương sai và độ lệch chuẩn

Giả sử mẫu số liệu gồm: x₁, x₂, …, xₙ.

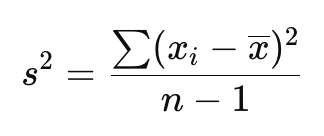

Phương sai mẫu (ký hiệu S²)

Công thức:

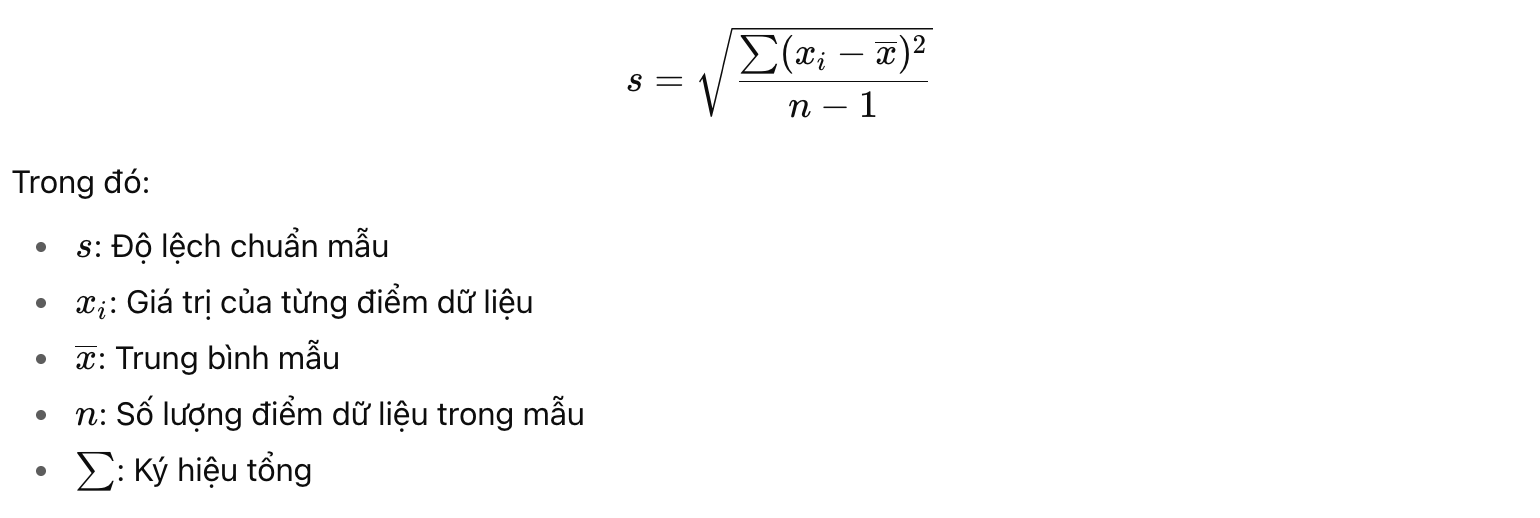

S² = (1/n) × [(x₁ - x̄)² + (x₂ - x̄)² + ... + (xₙ - x̄)²]Trong đó x̄ là trung bình mẫu:

x̄ = (1/n) × (x₁ + x₂ + ... + xₙ)Có thể biến đổi công thức phương sai thành:

S² = (1/n) × (x₁² + x₂² + ... + xₙ²) − x̄²Độ lệch chuẩn mẫu (ký hiệu S)

S = √S²Phương sai hiệu chỉnh (ước lượng không chệch)

Trong thống kê, khi muốn ước lượng phương sai tổng thể, ta dùng công thức hiệu chỉnh (chia cho n−1):

ŝ² = (1/(n−1)) × [(x₁ - x̄)² + (x₂ - x̄)² + ... + (xₙ - x̄)²]Trường hợp dữ liệu cho dưới dạng bảng tần số

Giả sử các giá trị là x₁, x₂, …, xₖ có tần số tương ứng n₁, n₂, …, nₖ (với n = n₁ + n₂ + … + nₖ), ta có:

S² = (1/n) × [n₁(x₁ − x̄)² + n₂(x₂ − x̄)² + ... + nₖ(xₖ − x̄)²]Hoặc dạng biến đổi:

S² = (1/n) × (n₁x₁² + n₂x₂² + ... + nₖxₖ²) − x̄²Ví dụ minh họa

Ví dụ 1 – Điểm Toán 10 học sinh

Dữ liệu: 10; 9; 5; 6; 1; 5; 7; 9; 5; 6.

Bước 1: Trung bình mẫu:

x̄ = (10 + 9 + 5 + 6 + 1 + 5 + 7 + 9 + 5 + 6) / 10 = 6,3Bước 2: Phương sai mẫu:

S² = (1/10) × [(10−6,3)² + 2(9−6,3)² + (7−6,3)² + 2(6−6,3)² + 3(5−6,3)² + (1−6,3)²]

⇒ S² = 6,21Bước 3: Độ lệch chuẩn:

S = √6,21 ≈ 2,492Ví dụ 2 – Cân nặng (kg) của 10 sinh viên

Dữ liệu: 59,0; 45,5; 52,7; 47,9; 40,7; 48,3; 52,1; 43,1; 55,2; 45,3.

x̄ = (59,0 + 45,5 + 52,7 + 47,9 + 40,7 + 48,3 + 52,1 + 43,1 + 55,2 + 45,3)/10 = 48,98

S² = (1/10) × Σ(xᵢ − 48,98)² = 29,3076

S = √29,3076 ≈ 5,4136Ví dụ 3 – Mẫu số liệu thực nghiệm

Dữ liệu: 2,62; 3,12; 2,75; 3,5; 3,25; 2,86; 3,15; 3,37.

x̄ = (2,62 + 2,75 + 2,86 + 3,12 + 3,15 + 3,25 + 3,37 + 3,5) / 8 = 3,0775

S² = (1/8) × Σ(xᵢ − 3,0775)² = 0,0831

S = √0,0831 ≈ 0,2883Ghi chú khi sử dụng công thức

- Dữ liệu tổng thể: Dùng công thức chia cho N (ký hiệu σ², σ).

- Dữ liệu mẫu: Khi ước lượng cho tổng thể, dùng công thức hiệu chỉnh chia cho n−1.

- Bảng tần số: Dùng công thức có tần số n₁, n₂, …, nₖ như ở trên.

Bài tập tự luyện

Bài 1

Điểm giữa kỳ của sinh viên:

Điểm: 0 5,5 6 6,5 7 7,5 8 8,5 9 9,5 10

Số sinh viên: 2 1 1 1 2 10 12 13 10 7 18Tính phương sai và độ lệch chuẩn mẫu.

Bài 2

Số điểm (thang 4): 2 2,5 3 3,5 4

Số môn: 0 1 4 3 6Tính phương sai và độ lệch chuẩn mẫu.

Bài 3

Số huy chương vàng của Việt Nam (2015–2019): 62, 130, 82, 74, 120

Tính phương sai của chuỗi dữ liệu trên.Bài 4

Nhiệt độ trung bình (°C) Nam Định 2010–2019:

24,60; 22,90; 24,00; 23,80; 24,20; 25,00; 24,60; 24,40; 24,50; 25,27

Tính phương sai mẫu và độ lệch chuẩn mẫu.Bài 5

Đánh giá sản phẩm Shopee (90 lượt):

Đánh giá: 5 4 3 2 1

Số lượt: 82 3 0 1 4

Tính phương sai mẫu và độ lệch chuẩn mẫu.Các bước thực hiện tính độ lệch chuẩn chính xác

Phân tích dữ liệu chính xác không chỉ đơn giản áp dụng công thức. Nó còn bao gồm các bước lấy dữ liệu, xử lý, kiểm tra và xác minh kết quả nhằm đảm bảo tính khách quan, chính xác cao nhất. Trong phần này, chúng ta sẽ đi theo từng bước để bạn nắm rõ mọi quy trình, từ thu thập tới phân tích cuối cùng.

Hành trình tính độ lệch chuẩn bắt đầu từ việc thu thập dữ liệu rõ ràng, có hệ thống. Sau đó, cần phân loại, làm sạch dữ liệu, đặc biệt là xử lý các điểm ngoại lai có thể làm sai lệch kết quả. Tiếp theo là tính trung bình cộng, sau đó áp dụng công thức để tính phương sai và độ lệch chuẩn một cách chính xác.

Thu thập và tổ chức dữ liệu

Điều kiện tiên quyết để đảm bảo kết quả chính xác là dữ liệu phải được thu thập đầy đủ, chính xác, đồng thời tổ chức hợp lý để thuận tiện cho quá trình tính toán. Mỗi một thông tin nên có mục đích rõ ràng, liên kết với mục tiêu phân tích. Dữ liệu có thể tổ chức thành bảng excel, hoặc trong phần mềm chuyên dụng như SPSS, R hoặc Python.

Việc làm sạch dữ liệu ngoại lệ, loại bỏ các điểm dữ liệu bất thường hoặc sai lệch là bước quyết định thành công của phân tích. Dữ liệu sạch sẽ giúp hạn chế sai số, tăng độ chính xác của kết quả tính toán phương sai hay độ lệch chuẩn, đồng thời giúp người phân tích dễ dàng kiểm soát quá trình và kết quả cuối cùng.

Tính trung bình cộng của dữ liệu

Bước này khá cơ bản, nhưng đóng vai trò trung tâm trong quá trình tính toán các tham số thống kê tiếp theo. Trung bình giúp xác định trung tâm của dữ liệu, từ đó đo lường mức độ phân tán qua các công thức độ lệch chuẩn. Phần mềm thống kê hoặc Excel đều có công cụ tính trung bình một cách nhanh chóng, chính xác.

Bạn cần chú ý kiểm tra dữ liệu sau khi tính trung bình để đảm bảo không xuất hiện lỗi do nhập liệu hoặc xử lý dữ liệu sai lệch. Đây là bước nền tảng, giúp các phép tính tiếp theo trở nên đúng đắn và chính xác hơn, từ đó tạo ra kết quả phân tích đáng tin cậy.

Áp dụng công thức để tính độ lệch chuẩn

Sau khi đã có trung bình, các bước tính tiếp theo sẽ ứng dụng ngay vào công thức độ lệch chuẩn phù hợp với dữ liệu của bạn, đó có thể là dạng mẫu, tổng thể, hoặc dữ liệu dạng tập hợp. Quá trình này đòi hỏi sự chính xác, cẩn thận, đồng thời kiểm tra lại từng bước để tránh các sai sót thường gặp như nhập sai số hoặc tính toán nhầm.

Điều quan trọng là cần hiểu rõ ý nghĩa của các giá trị trong công thức để nhận biết các điểm ngoại lai hoặc các vấn đề khác trong dữ liệu. Đặc biệt, với dữ liệu lớn hoặc phức tạp, việc sử dụng phần mềm thống kê giúp tự động hóa và chuẩn xác hơn, giảm thiểu các lỗi dò số thủ công.

Kiểm tra và xác minh kết quả tính toán

Chỉ khi kết quả được tính toán một cách chính xác, các nhà phân tích mới có thể tin tưởng vào các kết luận đưa ra. Việc kiểm tra và xác minh có thể thực hiện bằng cách so sánh kết quả từ nhiều phương pháp, hoặc bằng thủ công một số phép tính để đảm bảo tính đúng đắn.

Ngoài ra, việc kiểm tra dữ liệu ngoại lai, kiểm tra phân phối của dữ liệu, cũng giúp xác minh tính hợp lý của kết quả. Các phần mềm thống kê thường cung cấp các công cụ biểu đồ, kiểm định giả thuyết, giúp giữ vững tính khách quan và độ tin cậy của phân tích dữ liệu.

Ứng dụng của độ lệch chuẩn trong các lĩnh vực

Công thức độ lệch chuẩn không chỉ là kiến thức lý thuyết, mà còn được áp dụng trong vô vàn lĩnh vực khác nhau, giúp các chuyên gia đưa ra quyết định chính xác dựa trên dữ liệu. Từ nghiên cứu khoa học, tài chính, kiểm soát chất lượng cho đến dự báo rủi ro, độ lệch chuẩn giúp tổng hợp, phân tích dữ liệu một cách toàn diện và khách quan hơn.

Trong nghiên cứu khoa học, thống kê mô tả SPSS giúp khai thác dữ liệu, phân tích phân phối và xác định các đặc điểm chính của dữ liệu. Trong lĩnh vực tài chính, Tính toán điểm Z giúp xác định mức độ rủi ro, biến động của thị trường. Trong kiểm định chất lượng sản phẩm, độ lệch chuẩn đảm bảo sản phẩm đạt tiêu chuẩn và ổn định.

Trong nghiên cứu khoa học và thống kê xã hội

Các nhà khoa học, nhà nghiên cứu xã hội thường sử dụng công thức độ lệch chuẩn để phân tích dữ liệu thu thập được từ khảo sát, thực nghiệm hoặc điều tra. Điều này giúp họ xác định mức độ phân tán của các phản hồi, chỉ số kỹ thuật hoặc kết quả nghiên cứu. Đồng thời, độ lệch chuẩn còn giúp nhận diện các điểm ngoại lai, phân phối không chuẩn của dữ liệu.

Trong các nghiên cứu tâm lý, giáo dục, y học, phân tích thống kê mô tả SPSS cho phép các nhà phân tích hiểu rõ các đặc điểm hành vi, phản ứng, hoặc sự biến thiên của các yếu tố trong nhóm nghiên cứu. Quá trình này giúp dễ dàng tổng hợp kết quả, so sánh các nhóm, đưa ra các giả thuyết phù hợp, chính xác và có căn cứ.

Trong phân tích tài chính và đầu tư

Trong lĩnh vực tài chính, độ lệch chuẩn là công cụ đo lường rủi ro phi hệ thống của các khoản đầu tư hay danh mục. Các nhà đầu tư xác định được mức độ Biến Động của cổ phiếu, trái phiếu hay các tài sản khác giúp đưa ra quyết định đầu tư chính xác hơn, phù hợp với khẩu vị rủi ro của từng cá nhân hoặc tổ chức.

Ngoài ra, Tính toán điểm Z còn giúp phân tích sự khác biệt về lợi nhuận hoặc rủi ro so với tiêu chuẩn thị trường, từ đó xác định các điểm đầu tư tiềm năng hoặc các cơ hội sinh lời cao. Trong các báo cáo tài chính, độ lệch chuẩn còn giúp kiểm soát chất lượng, dự báo xu hướng biến động của thị trường, qua đó tối ưu hóa lợi nhuận và giảm thiểu rủi ro.

Trong kiểm định chất lượng sản phẩm

Ở lĩnh vực công nghiệp, độ lệch chuẩn ngành giúp đảm bảo các sản phẩm sản xuất ra đạt tiêu chuẩn, có độ đồng nhất cao, ít biến động. Dữ liệu về chiều dài, trọng lượng, độ bền, và các thông số kỹ thuật khác đều được phân tích để đảm bảo tính ổn định và tin cậy.

Hơn nữa, việc kiểm tra ngoại lệ và làm sạch dữ liệu là công đoạn quan trọng giúp loại bỏ những điểm dữ liệu bất thường, không đại diện cho quá trình sản xuất. Các kết quả này sẽ giúp các nhà quản lý, kỹ thuật đưa ra các quyết định tối ưu về quy trình, công nghệ sản xuất và kiểm soát chất lượng, đảm bảo sản phẩm đạt tiêu chuẩn cao nhất.

Trong dự báo và phân tích rủi ro

Dữ liệu về biến động, rủi ro thường rất phức tạp, đòi hỏi các phép tính chính xác của công thức độ lệch chuẩn để xác định các mức độ phân tán, biên độ dao động của dữ liệu. Từ đó, các mô hình dự báo có thể dự đoán chính xác hơn các xu hướng biến động, giúp các doanh nghiệp và cá nhân phòng tránh rủi ro kịp thời.

Ngoài ra, phân tích điểm Z giúp xác định các điểm ngoài biên có thể gây ảnh hưởng tiêu cực đến kết quả tổng thể hoặc dự báo. Các nhà phân tích sử dụng các kỹ thuật này để xây dựng các chiến lược phù hợp, giảm thiểu tối đa các rủi ro không mong muốn, đảm bảo an toàn và ổn định cho các hoạt động dài hạn.

Tổng kết

Công thức độ lệch chuẩn là kiến thức nền tảng không thể thiếu trong lĩnh vực phân tích dữ liệu, giúp chúng ta mô tả tốt hơn về độ phân tán, mức độ biến động của dữ liệu trong mọi lĩnh vực. Từ những dữ liệu nhỏ, dễ xử lý cho đến các tập dữ liệu lớn, phức tạp đòi hỏi các công thức và kỹ thuật xử lý phù hợp để đảm bảo kết quả chính xác, đáng tin cậy nhất.

Các phương pháp làm sạch dữ liệu, xử lý ngoại lệ, cùng với các công cụ phần mềm như SPSS, Excel, R hay Python là những trợ thủ đắc lực giúp nâng cao chất lượng phân tích. Bên cạnh đó, việc kiểm tra, so sánh nhiều phương pháp tính toán giúp phát hiện các điểm bất thường, xác định các mô hình phù hợp nhất với dữ liệu nghiên cứu.

Chúng ta cần luôn ghi nhớ rằng, chọn đúng công thức, áp dụng đúng quy trình chính là chìa khóa đảm bảo độ chính xác, tin cậy của kết quả phân tích dữ liệu. Từ đó, các kết quả này có thể đưa ra quyết định đúng đắn, góp phần thúc đẩy các hoạt động nghiên cứu, sản xuất, kinh doanh ngày càng hiệu quả và bền vững. Hãy luôn tự tin và sáng tạo trong từng bước làm việc của bạn để khai thác tối đa giá trị của dữ liệu bằng các công thức độ lệch chuẩn đúng đắn nhất!

Độ Lệch Chuẩn là gì? Khái Niệm & Ứng Dụng Trong Thống Kê

Trong lĩnh vực thống kê, độ lệch chuẩn là gì luôn là câu hỏi phổ biến đối với những người mới bắt đầu học về phân tích dữ liệu. Độ lệch chuẩn không chỉ đơn thuần là một chỉ số định lượng mà còn phản ánh mức độ biến thiên, sự phân tán thống kê của dữ liệu xung quanh giá trị trung bình. Hiểu rõ về độ lệch chuẩn sẽ giúp chúng ta có được cái nhìn chính xác và toàn diện hơn về dữ liệu, từ đó đưa ra các quyết định phù hợp trong nghiên cứu, kinh doanh, y tế, và nhiều lĩnh vực khác.

Trong bài viết này, chúng ta sẽ cùng nhau đi sâu vào khái niệm, đặc điểm, cách tính và ứng dụng của độ lệch chuẩn, cũng như những lưu ý quan trọng giúp khai thác tối đa giá trị của chỉ số này trong phân tích dữ liệu.

I. Độ Lệch Chuẩn Là Gì?

1. Khái Niệm

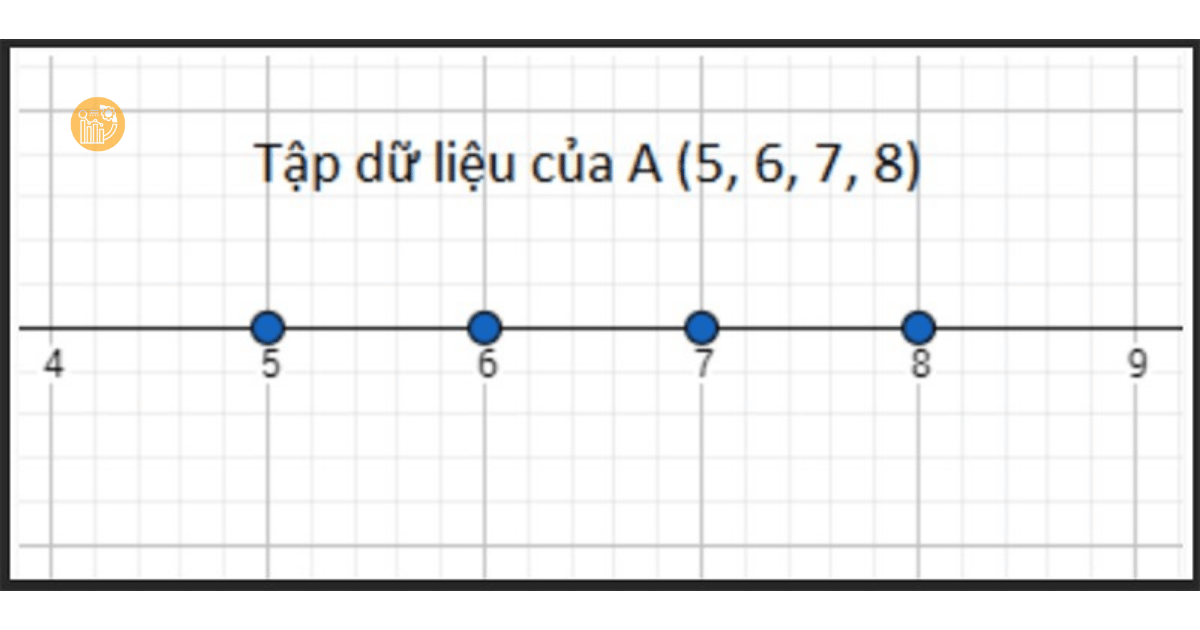

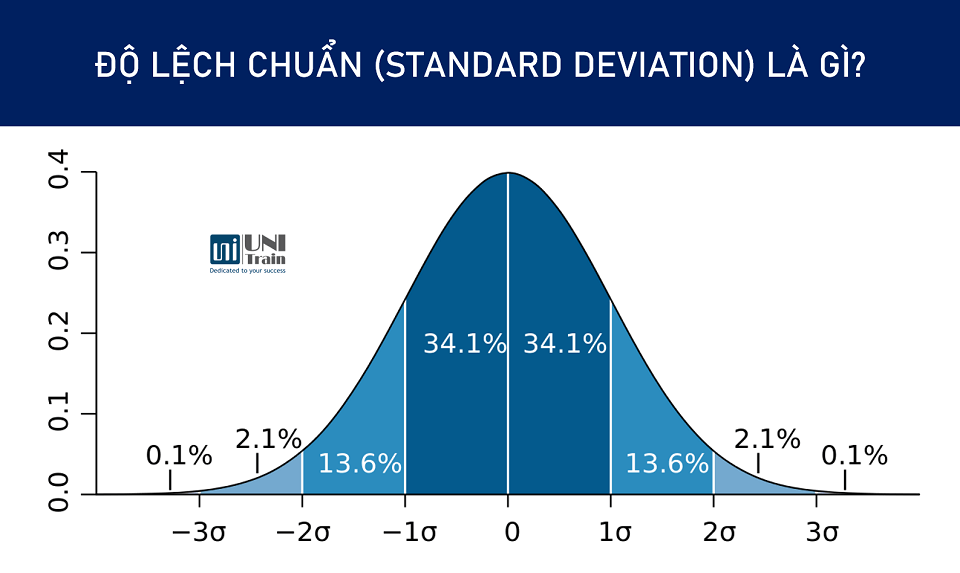

Trong thống kê mô tả, độ lệch chuẩn là thước đo độ phân tán của một tập hợp các giá trị so với giá trị trung bình của chúng. Nói cách đơn giản, khi dữ liệu có độ lệch chuẩn thấp, các giá trị đều tụ tập gần trung bình; còn nếu độ lệch chuẩn cao, các giá trị phân tán rộng hơn, chênh lệch lớn hơn so với trung bình.

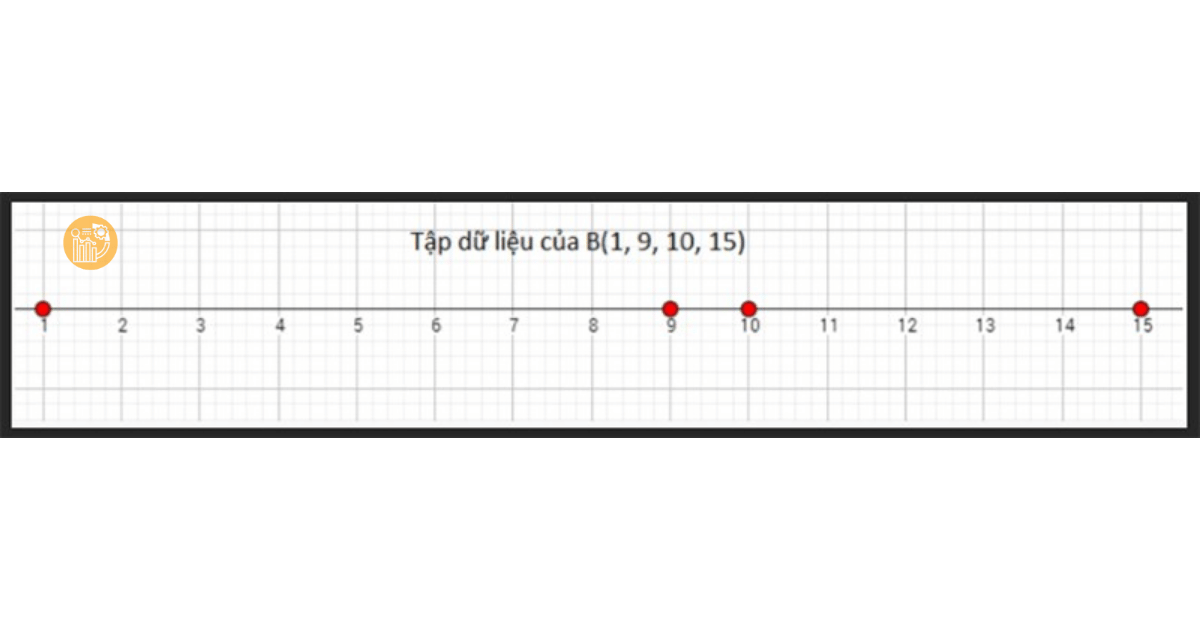

Ví dụ:

- Nhìn vào ví dụ bên dưới ta có thể thấy trong tập dữ liệu A có độ phân tán thấp, hay nói cách khác là chúng khá “gần” nhau.

- Trái lại, các giá trị của tập dữ liệu B lại có sự phân tán lớn hơn:

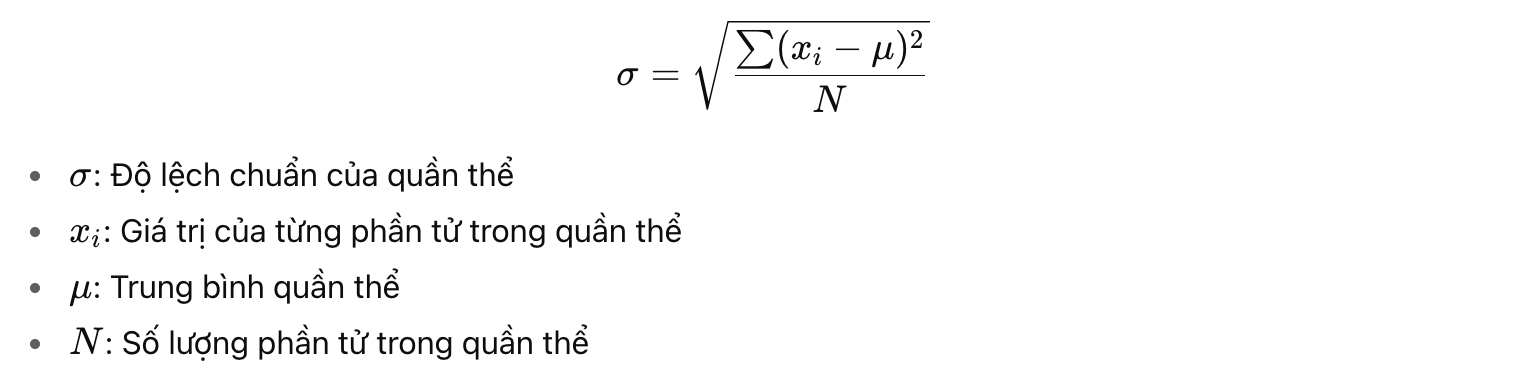

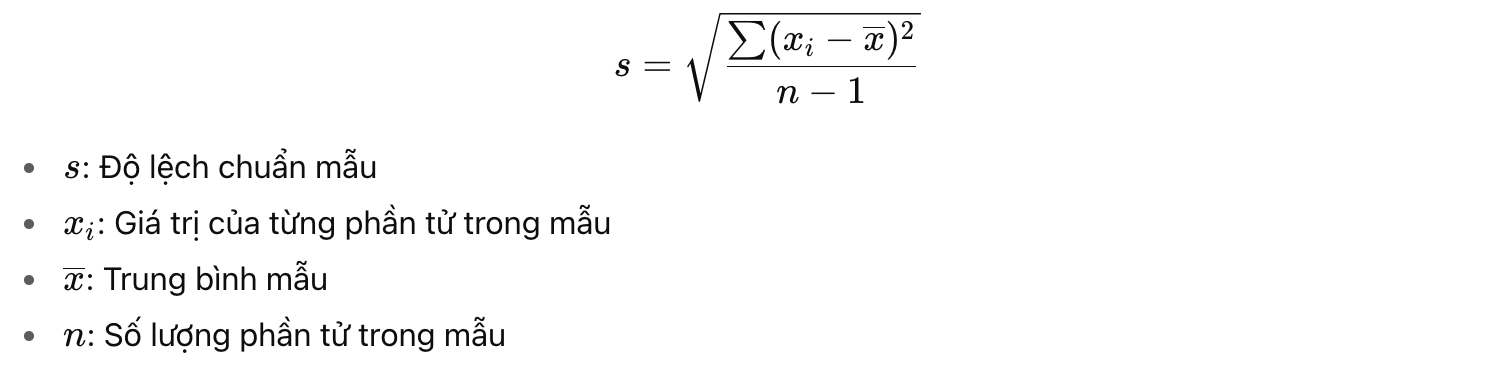

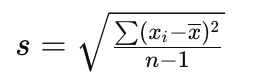

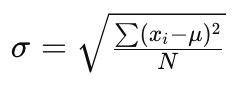

2. Công Thức Tính Độ Lệch Chuẩn

Công thức tính độ lệch chuẩn thường được sử dụng cho hai trường hợp: dân số toàn bộ và mẫu dữ liệu.

Công thức tính độ lệch chuẩn tổng thể:

Công thức tính độ lệch chuẩn mẫu:

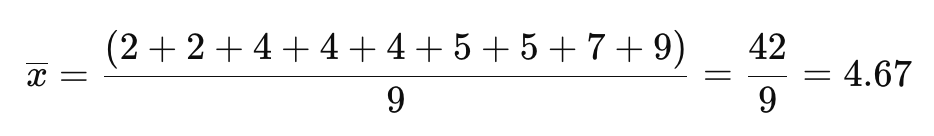

Ví Dụ Tính Độ Lệch Chuẩn

Giả sử bạn có tổng thể điểm số của 9 học sinh là: 2, 2, 4, 4, 4, 5, 5, 7, 9

Bước 1: Tính Trung Bình (Mean)

Trung bình mẫu được tính bằng cách cộng tất cả các giá trị lại và chia cho số phần tử:

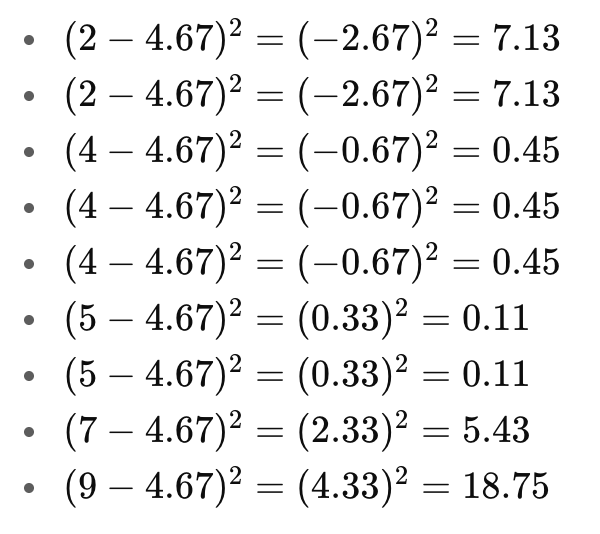

Bước 2: Tính Sự Chênh Lệch

Tiếp theo, ta tính sự chênh lệch giữa từng giá trị dữ liệu và giá trị trung bình. Sau đó, ta bình phương các sự chênh lệch này:

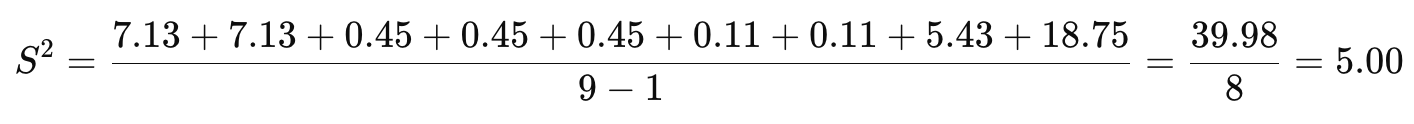

Bước 3: Tính Phương Sai

Sau khi đã tính bình phương độ lệch, ta cộng tất cả các giá trị lại và chia cho n−1n – 1n−1 (vì chúng ta đang làm việc với mẫu):

Bước 4: Tính Độ Lệch Chuẩn

Cuối cùng, ta lấy căn bậc hai của phương sai để ra độ lệch chuẩn:

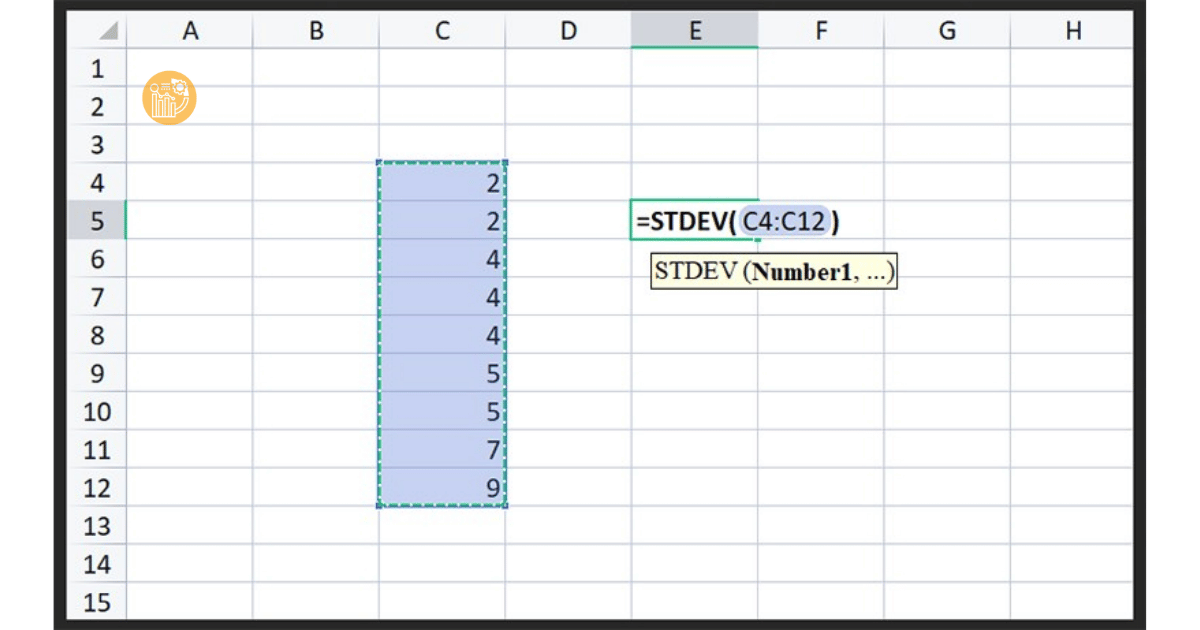

3. Tính Độ Lệch Chuẩn Trong Excel

Trong Excel, để tính độ lệch chuẩn, bạn sử dụng hàm STDEV với cú pháp:STDEV(number1, [number2], ...)

Ví dụ: Tính độ lệch chuẩn cho tập hợp dữ liệu N={2,2,4,4,4,5,5,7,9}, bạn nhập hàm sau vào Excel:

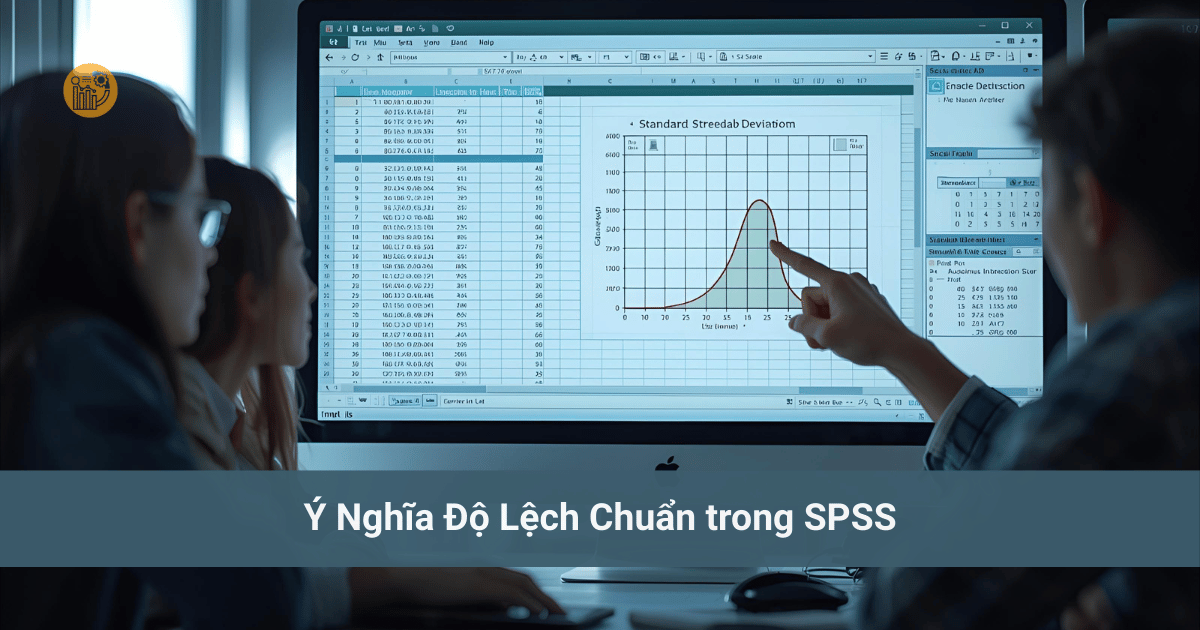

II. Ý Nghĩa Độ Lệch Chuẩn trong SPSS

1. Ý Nghĩa

Độ lệch chuẩn cho ta biết được độ phân tán của giá trị thống kê so với giá trị trung bình ở từng thời điểm khác nhau. Nếu độ lệch chuẩn thấp, tính biến động không đáng kể và ngược lại.

Độ lệch chuẩn bằng căn bậc 2 của phương sai – một đại lượng mô tả sự chênh lệch của một giá trị so với giá trị trung bình. Cả độ lệch chuẩn và phương sai đều dùng để đo lường các mức độ lan truyền của dữ liệu trong bất kỳ tập dữ liệu nào.

2. Độ Lệch Chuẩn trong SPSS

Trong phần mềm phân tích dữ liệu SPSS, độ lệch chuẩn diễn tả mức độ khác biệt giữa các câu trả lời của đáp viên. Nếu độ lệch chuẩn càng nhỏ, thì các đáp án của đáp viên không có sự khác biệt quá nhiều. Điều này cho thấy rằng các đáp viên thường trả lời gần giống nhau.

Ví dụ: Khi khảo sát, bạn kỳ vọng rằng hầu hết các đáp viên sẽ chọn mức độ đồng tình (4, 5) với một câu hỏi, nhưng nếu các câu trả lời có độ lệch chuẩn cao, điều đó có nghĩa là các đáp án phân tán rộng, không tập trung vào nhóm 4 và 5.

Trong SPSS, độ lệch chuẩn chỉ phản ánh sự phân tán của dữ liệu. Không có ngưỡng “chấp nhận được”, mà độ lệch chuẩn tốt hay xấu sẽ phụ thuộc vào kỳ vọng của bạn khi thực hiện nghiên cứu.

III. Ứng Dụng Của Độ Lệch Chuẩn Trong Thực Tế

Độ lệch chuẩn là một công cụ không thể thiếu trong phân tích dữ liệu thực tế. Dưới đây là một số ứng dụng trong các lĩnh vực:

- Phân Tích Dữ Liệu Trong Nghiên Cứu Khoa Học: Đánh giá tính đáng tin cậy và mức độ biến động của các kết quả thí nghiệm.

- Đánh Giá Mức Độ Biến Động Trong Kinh Doanh: Giúp xác định mức độ rủi ro của các khoản đầu tư, đánh giá sự ổn định trong doanh thu.

- Ứng Dụng Trong Y Tế: Giúp phân tích các chỉ số sinh học như huyết áp, lượng đường huyết, để xác định phạm vi bình thường và các bất thường.

- Ứng Dụng Trong Giáo Dục: Giúp đánh giá mức độ phân bố điểm số của học sinh và đưa ra các phương pháp giảng dạy phù hợp.

IV. So Sánh Độ Lệch Chuẩn Với Các Chỉ Số Thống Kê Khác

| Chỉ Số | Đặc Điểm |

|---|---|

| Độ lệch chuẩn | Đơn vị giống với dữ liệu gốc, dễ hiểu và trực quan hơn. |

| Phương sai | Bình phương độ lệch chuẩn, mang đơn vị là bình phương của dữ liệu. |

| Độ lệch trung bình | Trung bình độ lệch tuyệt đối so với trung bình, ít được sử dụng trong thống kê mô tả. |

Kết Luận

Trong bài viết này, chúng ta đã khám phá một cách toàn diện về độ lệch chuẩn là gì, từ khái niệm, đặc điểm, công thức tính, đến ứng dụng trong các lĩnh vực như nghiên cứu khoa học, kinh doanh, y tế và giáo dục. Độ lệch chuẩn không chỉ là một chỉ số thống kê đơn giản mà còn là công cụ đắc lực giúp đánh giá sự phân tán, biến thiên của dữ liệu, từ đó giúp đưa ra quyết định chính xác và hiệu quả hơn.

Việc hiểu rõ về độ lệch chuẩn sẽ giúp bạn phân tích dữ liệu một cách chính xác và dễ dàng đưa ra quyết định trong các lĩnh vực nghiên cứu và ứng dụng thực tế.

Công Thức Tính Độ Lệch Chuẩn và Phương Sai Trong Thống Kê

Độ lệch chuẩn là một trong những khái niệm quan trọng nhất trong thống kê, giúp chúng ta đo lường mức độ phân tán của dữ liệu xung quanh giá trị trung bình. Trong bài viết này, chúng ta sẽ cùng tìm hiểu về công thức tính độ lệch chuẩn, mối quan hệ giữa độ lệch chuẩn và phương sai, cũng như các ví dụ minh họa để giúp bạn dễ dàng hiểu và áp dụng.

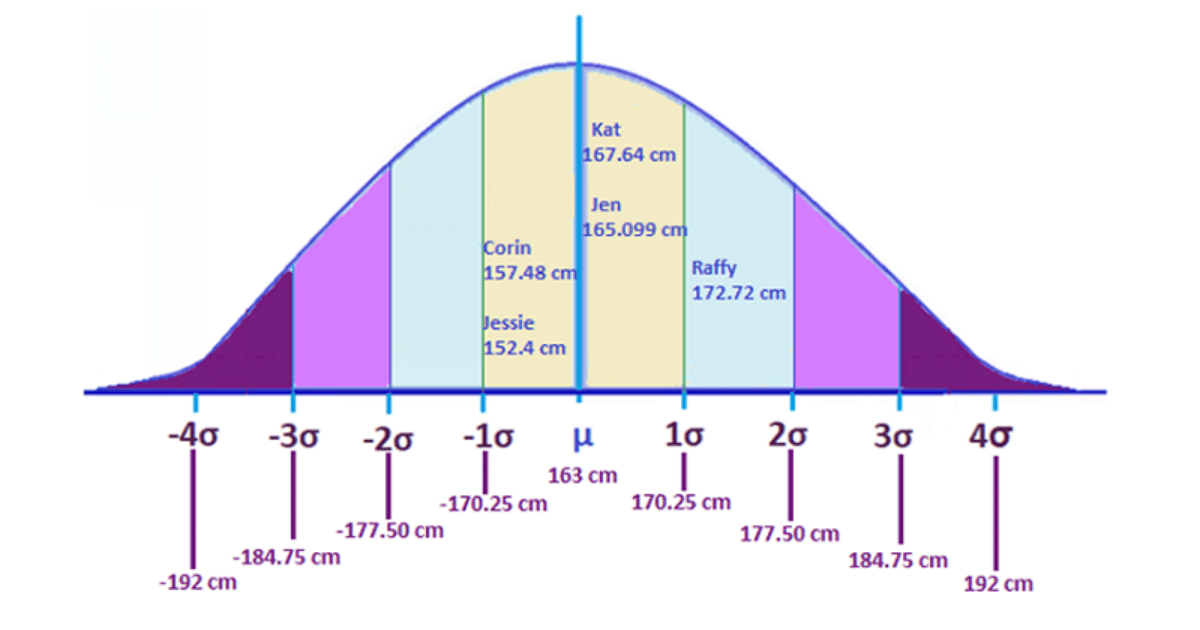

Khái Niệm Độ Lệch Chuẩn

Độ lệch chuẩn (Standard Deviation) là đại lượng thống kê đo lường mức độ phân tán của dữ liệu xung quanh trung bình. Nó cho biết trung bình mỗi điểm dữ liệu cách xa trung bình bao nhiêu đơn vị.

Ví dụ:

- Nếu độ lệch chuẩn của điểm số của học sinh trong một lớp học là 5 điểm, điều đó có nghĩa là trung bình mỗi học sinh có điểm số lệch 5 điểm so với điểm trung bình của lớp.

- Nếu độ lệch chuẩn của chiều cao của người dân trong một vùng là 10cm, điều đó có nghĩa là trung bình mỗi người có chiều cao lệch 10cm so với chiều cao trung bình của người dân trong vùng.

Vai Trò của Độ Lệch Chuẩn

Độ lệch chuẩn đóng vai trò quan trọng trong nhiều lĩnh vực, bao gồm:

- Phân tích dữ liệu: Giúp đánh giá mức độ phân tán của dữ liệu, cho phép nhà nghiên cứu đưa ra kết luận chính xác hơn.

- Kiểm tra giả thuyết: Được sử dụng để xác định xem sự khác biệt giữa hai nhóm dữ liệu có ý nghĩa thống kê hay không.

- Dự báo: Được dùng để dự báo tương lai, ví dụ như dự báo doanh thu của một công ty.

- Kiểm soát chất lượng: Được dùng để kiểm soát chất lượng sản phẩm, ví dụ kiểm tra kích thước sản phẩm có đạt tiêu chuẩn hay không.

Công Thức Tính Độ Lệch Chuẩn

Có hai công thức tính độ lệch chuẩn, tùy thuộc vào việc bạn đang làm việc với một mẫu dữ liệu hay toàn bộ quần thể.

1. Công Thức Tính Độ Lệch Chuẩn Mẫu

Công thức tính độ lệch chuẩn mẫu được sử dụng khi bạn chỉ có một mẫu con của dữ liệu:

Công thức này sử dụng n−1n – 1n−1 để điều chỉnh độ lệch chuẩn mẫu cho phù hợp với độ lệch chuẩn của tổng thể.

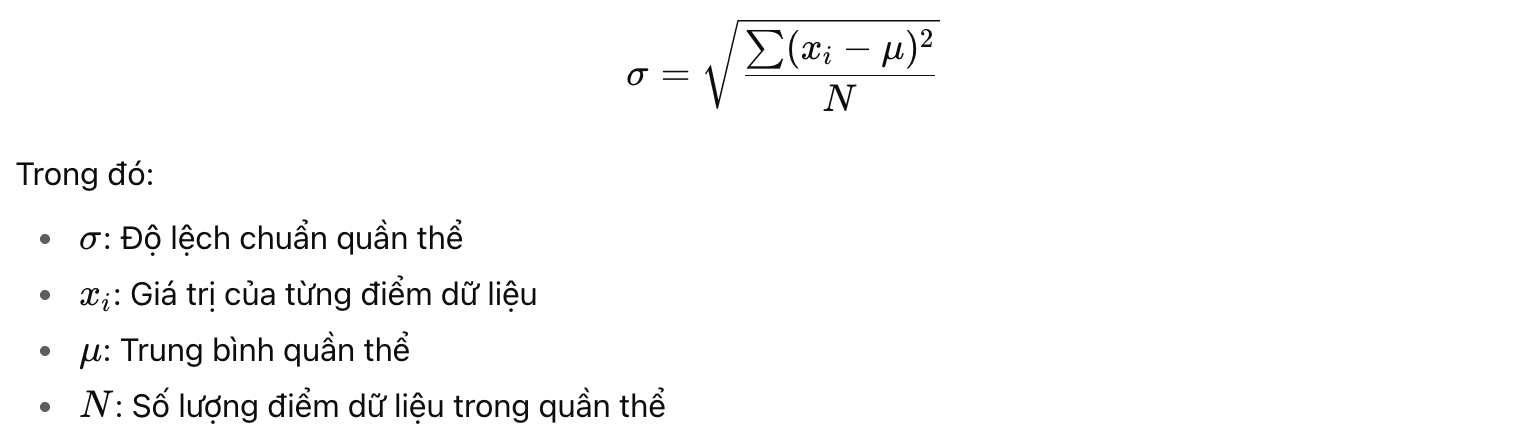

2. Công Thức Tính Độ Lệch Chuẩn Quần Thể

Khi bạn có toàn bộ dữ liệu của quần thể, công thức tính độ lệch chuẩn là:

Lưu ý: Công thức tính độ lệch chuẩn quần thể không sử dụng n−1n – 1n−1 mà dùng NNN vì bạn có toàn bộ dữ liệu của quần thể.

Mối Quan Hệ Giữa Độ Lệch Chuẩn và Phương Sai

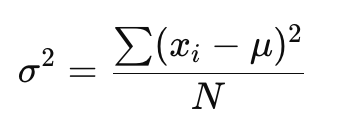

Phương sai và độ lệch chuẩn có mối quan hệ mật thiết. Phương sai (Variance) là bình phương của độ lệch chuẩn và đo lường mức độ phân tán của dữ liệu so với trung bình.

Công Thức Tính Phương Sai

- Phương sai mẫu:

- Phương sai quần thể:

Mối Quan Hệ

Ví dụ: Nếu độ lệch chuẩn của một tập dữ liệu là 3, phương sai của nó sẽ là 9 (3² = 9).

Lợi Ích Của Việc Sử Dụng Độ Lệch Chuẩn Thay Vì Phương Sai

- Đơn vị dễ hiểu: Độ lệch chuẩn có đơn vị giống với dữ liệu gốc, trong khi phương sai có đơn vị là bình phương của dữ liệu.

- Dễ hình dung hơn: Độ lệch chuẩn giúp dễ dàng hiểu được mức độ phân tán của dữ liệu theo đơn vị dữ liệu ban đầu.

Ví dụ: Nếu đơn vị dữ liệu là mét, thì độ lệch chuẩn cũng có đơn vị là mét. Trong khi đó, phương sai sẽ có đơn vị là mét vuông.

Ví Dụ Minh Họa

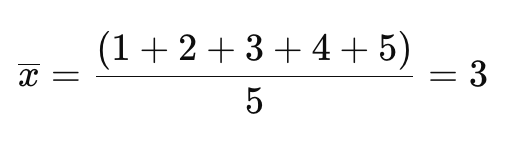

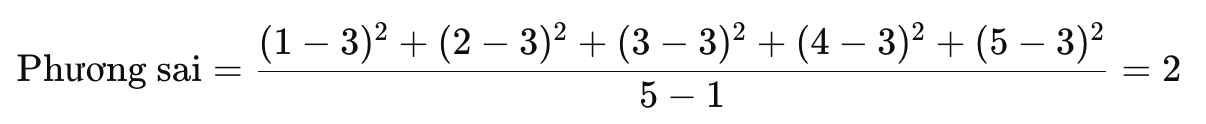

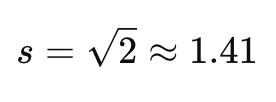

Giả sử bạn có tập hợp dữ liệu sau: 1,2,3,4,5

Bước 1: Tính Trung Bình Mẫu

Bước 2: Tính Phương Sai

Bước 3: Tính Độ Lệch Chuẩn

Kết luận: Độ lệch chuẩn của tập dữ liệu là 1.41, nghĩa là trung bình mỗi giá trị cách trung bình 1.41 đơn vị.

Tổng Bình Phương Chênh Lệch Là Gì?

Tổng bình phương chênh lệch (TBCCH) là tổng các bình phương chênh lệch giữa mỗi giá trị dữ liệu và trung bình. Nó là cơ sở để tính phương sai và độ lệch chuẩn.

Sự Khác Biệt Giữa Công Thức Quần Thể và Mẫu

| Công Thức | Công Thức Mẫu | Công Thức Quần Thể |

|---|---|---|

| Độ lệch chuẩn |  |

|

| Sử dụng | Mẫu nhỏ từ quần thể lớn | Dữ liệu đầy đủ của quần thể |

| Công thức | Điều chỉnh bằng n−1n – 1n−1 để giảm sai lệch ước lượng | Không cần điều chỉnh, sử dụng NNN |

Kết Luận

Hiểu rõ về công thức tính độ lệch chuẩn và phương sai giúp bạn phân tích dữ liệu một cách chính xác và dễ dàng đưa ra kết luận trong các nghiên cứu hoặc quyết định kinh doanh. Độ lệch chuẩn có vai trò quan trọng trong việc đo lường sự phân tán và đánh giá tính ổn định của dữ liệu. Việc lựa chọn sử dụng độ lệch chuẩn hay phương sai phụ thuộc vào ngữ cảnh và mục đích phân tích.

Các phương pháp phân tích dữ liệu trong nghiên cứu khoa học

Trong bối cảnh nghiên cứu khoa học hiện đại, phân tích dữ liệu định lượng đã trở thành một bước không thể thiếu trong quy trình thực hiện nghiên cứu. Sự phát triển vượt bậc của công nghệ thông tin và các phần mềm thống kê chuyên dụng đã mở ra những khả năng mới trong việc khai thác và phân tích dữ liệu một cách hiệu quả. Việc nắm vững các phương pháp phân tích dữ liệu định lượng không chỉ giúp người nghiên cứu xử lý số liệu một cách chính xác mà còn tạo điều kiện để hiểu sâu sắc bản chất của vấn đề nghiên cứu, kiểm định các giả thuyết một cách khoa học và đưa ra những kết luận có cơ sở vững chắc.

Tuy nhiên, với sự đa dạng và phong phú của các phương pháp phân tích hiện có, việc lựa chọn phương pháp phân tích phù hợp thường là một thách thức không nhỏ đối với nhiều nhà nghiên cứu, đặc biệt là những người mới bắt đầu trong lĩnh vực này. Mỗi phương pháp phân tích có những ưu điểm, hạn chế và phạm vi ứng dụng riêng, đòi hỏi người sử dụng phải có hiểu biết sâu sắc để có thể áp dụng một cách hiệu quả và chính xác.

Các phương pháp phân tích dữ liệu định lượng

Phân tích thống kê mô tả

Phân tích thống kê mô tả đóng vai trò như viên gạch đầu tiên trong việc xây dựng toàn bộ công trình nghiên cứu. Đây là phương pháp phân tích tập trung vào việc tóm tắt, trình bày và mô tả các đặc điểm cơ bản nhất của dữ liệu thu thập được. Mặc dù tương đối đơn giản về mặt kỹ thuật, phân tích thống kê mô tả lại có ý nghĩa vô cùng quan trọng vì nó cung cấp cái nhìn tổng quan đầu tiên về dữ liệu, giúp người nghiên cứu hiểu được bức tranh chung trước khi đi sâu vào các phân tích phức tạp hơn.

Trong thực tế, phân tích thống kê mô tả bao gồm một loạt các chỉ số quan trọng, mỗi chỉ số mang một ý nghĩa riêng biệt. Tần số và tỷ lệ phần trăm giúp chúng ta hiểu được sự phân bố của các giá trị trong dữ liệu, từ đó có thể nhận biết những đặc điểm nổi bật hoặc bất thường. Giá trị trung bình cung cấp thông tin về xu hướng trung tâm của dữ liệu, trong khi độ lệch chuẩn cho biết mức độ biến thiên xung quanh giá trị trung bình đó. Các chỉ số như phân vị, độ lệch chuẩn và biểu đồ histogram không chỉ bổ sung thêm thông tin mà còn giúp phát hiện những bất thường trong dữ liệu như các giá trị ngoại lai hoặc sự phân bố không chuẩn.

Ứng dụng của phân tích thống kê mô tả rất đa dạng và xuất hiện trong hầu hết các nghiên cứu. Khi miêu tả đặc điểm của mẫu khảo sát, người nghiên cứu thường sử dụng các chỉ số này để trình bày thông tin về tỷ lệ giới tính, phân bố độ tuổi, trình độ học vấn, thu nhập, nghề nghiệp của đối tượng tham gia nghiên cứu. Thông tin này không chỉ giúp người đọc hiểu rõ về đặc điểm của mẫu mà còn là cơ sở để đánh giá tính đại diện của mẫu so với tổng thể nghiên cứu.

Kiểm định sự khác biệt

Kiểm định sự khác biệt là một trong những phương pháp phân tích được sử dụng phổ biến nhất trong nghiên cứu định lượng, đặc biệt khi mục tiêu nghiên cứu là so sánh các nhóm khác nhau để xác định xem liệu có tồn tại sự khác biệt có ý nghĩa thống kê hay không. Phương pháp này đặc biệt hữu ích khi nghiên cứu các biến liên tục và cần so sánh giữa các nhóm được phân loại theo những tiêu chí khác nhau.

Trong họ các phương pháp phân tích kiểm định sự khác biệt, One-Sample T-Test là phương pháp đơn giản nhất, được sử dụng khi muốn so sánh giá trị trung bình của một mẫu với một giá trị chuẩn hoặc giá trị lý thuyết đã biết trước. Phương pháp này thường được áp dụng trong các nghiên cứu muốn kiểm tra xem một chỉ số nào đó có đạt được mức tiêu chuẩn đã đề ra hay không.

Independent-Samples T-Test được sử dụng rộng rãi khi cần so sánh hai nhóm độc lập với nhau. Đây là một trong những kiểm định được sử dụng thường xuyên nhất trong nghiên cứu khoa học xã hội, đặc biệt khi so sánh sự khác biệt giữa nam và nữ, giữa các nhóm tuổi khác nhau, hoặc giữa những nhóm có đặc điểm phân biệt rõ ràng. Ngược lại, Paired-Samples T-Test được áp dụng khi cần so sánh cùng một nhóm đối tượng tại hai thời điểm khác nhau, chẳng hạn như so sánh kết quả trước và sau khi tham gia một chương trình can thiệp.

Khi nghiên cứu có từ ba nhóm trở lên, One-Way ANOVA trở thành lựa chọn phù hợp. phương pháp phân tích này không chỉ cho phép kiểm định sự khác biệt giữa các nhóm mà còn có thể thực hiện các phân tích hậu kiểm để xác định cụ thể nhóm nào khác biệt với nhóm nào. Điều này đặc biệt hữu ích trong các nghiên cứu so sánh hiệu quả của nhiều phương pháp khác nhau hoặc so sánh nhiều nhóm đối tượng có đặc điểm khác nhau.

Kiểm định độ tin cậy và giá trị thang đo

Trước khi có thể tin tưởng vào bất kỳ kết quả phân tích nào, việc đảm bảo chất lượng của công cụ đo lường là điều kiện tiên quyết không thể bỏ qua. Kiểm định độ tin cậy và giá trị thang đo đóng vai trò như “bộ lọc chất lượng” giúp người nghiên cứu xác định liệu các thang đo được sử dụng có đủ tin cậy và có thực sự đo lường đúng những khái niệm mà nghiên cứu hướng tới hay không.

Cronbach’s Alpha là chỉ số được sử dụng rộng rãi nhất để đánh giá độ tin cậy nội tại của thang đo. Chỉ số này đo lường mức độ nhất quán giữa các biến quan sát trong cùng một thang đo, giúp xác định liệu các câu hỏi trong thang đo có cùng đo lường một khái niệm hay không. Một thang đo có Cronbach’s Alpha cao (thường trên 0.7) cho thấy các biến quan sát có tương quan tốt với nhau và cùng đo lường một khái niệm thống nhất.

Phân tích nhân tố khám phá (EFA) đi xa hơn bằng cách không chỉ đánh giá độ tin cậy mà còn khám phá cấu trúc tiềm ẩn của dữ liệu. EFA giúp xác định xem các biến quan sát có thể được nhóm thành bao nhiêu nhân tố tiềm ẩn và mỗi biến thuộc về nhân tố nào. Điều này đặc biệt quan trọng trong việc rút gọn dữ liệu và xác định cấu trúc khái niệm trong nghiên cứu.

Việc ứng dụng các phương pháp phân tích này trong thực tế thường bao gồm việc rút gọn thang đo bằng cách loại bỏ những biến không đạt yêu cầu về độ tin cậy, kiểm tra và xác nhận cấu trúc của các nhóm biến trong bảng hỏi, và đảm bảo rằng các thang đo được sử dụng có chất lượng đủ tốt để đưa ra những kết luận tin cậy.

Phân tích tương quan, hồi quy

Phân tích hồi quy có lẽ là một trong những phương pháp phân tích quan trọng và được sử dụng nhiều nhất trong nghiên cứu khoa học hiện đại. Sức mạnh của phương pháp phân tích này nằm ở khả năng không chỉ xác định sự tồn tại của mối quan hệ giữa các biến mà còn có thể đo lường chính xác mức độ ảnh hưởng của biến độc lập đến biến phụ thuộc. Điều này cho phép người nghiên cứu không chỉ trả lời câu hỏi “có hay không có mối quan hệ” mà còn trả lời câu hỏi “mức độ ảnh hưởng là bao nhiêu”.

Hồi quy tuyến tính đơn giản và bội là những phương pháp phân tích được sử dụng rộng rãi nhất khi biến phụ thuộc có tính chất liên tục. Hồi quy tuyến tính đơn giản tập trung vào mối quan hệ giữa một biến độc lập và một biến phụ thuộc, trong khi hồi quy bội cho phép xem xét đồng thời ảnh hưởng của nhiều biến độc lập đến cùng một biến phụ thuộc. Khả năng kiểm soát đồng thời nhiều biến này đặc biệt quan trọng trong nghiên cứu khoa học xã hội, nơi mà các hiện tượng thường chị ảnh hưởng bởi nhiều yếu tố khác nhau.

Khi biến phụ thuộc có tính chất nhị phân (chỉ có hai giá trị như có/không, thành công/thất bại), hồi quy logistic trở thành lựa chọn phù hợp. Phương pháp này không chỉ có thể xác định các yếu tố ảnh hưởng đến xác suất xảy ra một sự kiện mà còn có thể tính toán chính xác tỷ lệ khả năng (odds ratio) giữa các nhóm khác nhau.

Ứng dụng thực tế của phân tích hồi quy rất đa dạng và phong phú. Trong lĩnh vực kinh doanh, phương pháp phân tích này thường được sử dụng để đo lường mức độ ảnh hưởng của các yếu tố như chất lượng dịch vụ, giá cả, thương hiệu đến sự hài lòng của khách hàng. Trong giáo dục, hồi quy có thể giúp xác định những yếu tố nào ảnh hưởng đến kết quả học tập của học sinh. Trong y tế, phương pháp này được sử dụng để xác định các yếu tố nguy cơ gây bệnh hoặc đánh giá hiệu quả của các phương pháp điều trị.

Mô hình hóa cấu trúc SEM

Khi nghiên cứu trở nên phức tạp với nhiều biến tiềm ẩn và mối quan hệ đa chiều, các phương pháp phân tích truyền thống có thể không đủ mạnh để xử lý. Đây chính là lúc mô hình hóa cấu trúc, bao gồm phân tích nhân tố khẳng định (CFA) và mô hình cấu trúc tuyến tính (SEM), trở thành những công cụ không thể thiếu.

Phân tích nhân tố khẳng định (CFA) là phương pháp phân tích tiên tiến cho phép kiểm định một cách chính xác mô hình đo lường đã được đề xuất dựa trên lý thuyết. Khác với EFA có tính chất khám phá, CFA có tính chất khẳng định, nghĩa là người nghiên cứu đã có giả thuyết cụ thể về cấu trúc của dữ liệu và sử dụng CFA để kiểm chứng giả thuyết đó. Phương pháp này đặc biệt quan trọng trong việc đảm bảo tính hợp lệ của các thang đo phức tạp.

Mô hình cấu trúc tuyến tính (SEM) đi xa hơn nữa bằng cách cho phép kiểm định đồng thời cả mô hình đo lường và mô hình cấu trúc. SEM có khả năng xử lý các mối quan hệ phức tạp giữa nhiều biến tiềm ẩn, bao gồm cả các mối quan hệ trực tiếp và gián tiếp. Điều này làm cho SEM trở thành công cụ lý tưởng cho việc kiểm định các mô hình lý thuyết phức tạp trong nhiều lĩnh vực khoa học.

Các phần mềm như AMOS và SmartPLS đã được phát triển chuyên biệt để hỗ trợ việc thực hiện các phân tích SEM. Những phần mềm này không chỉ cung cấp giao diện thân thiện mà còn tích hợp nhiều chức năng mạnh mẽ giúp người nghiên cứu có thể thực hiện các phân tích phức tạp một cách hiệu quả.

Ứng dụng điển hình của SEM trong thực tế có thể thấy trong các nghiên cứu về hành vi tiêu dùng, nơi mà các nhà nghiên cứu cần kiểm định những mô hình phức tạp như “Nhận diện thương hiệu → Cảm nhận giá trị → Ý định mua hàng → Lòng trung thành”. Những mô hình như vậy bao gồm nhiều khái niệm trừu tượng và các mối quan hệ đa chiều, đòi hỏi những công cụ phân tích tinh vi như SEM.

Các phương pháp phân tích dữ liệu định tính

Trong nghiên cứu khoa học, bên cạnh phân tích định lượng dựa trên số liệu, phân tích dữ liệu định tính giữ vai trò quan trọng trong việc khám phá, giải thích và hiểu sâu sắc các hiện tượng xã hội. Khác với dữ liệu định lượng vốn được thu thập bằng thang đo hay bảng khảo sát, dữ liệu định tính thường xuất hiện dưới dạng văn bản, âm thanh, hình ảnh hoặc bản ghi phỏng vấn. Mục tiêu của phân tích định tính không phải là đo lường, mà là tìm ra ý nghĩa ẩn sau lời nói, hành vi và bối cảnh.

Một trong những phương pháp phân tích phổ biến là phân tích nội dung (Content Analysis). Đây là kỹ thuật mã hóa dữ liệu văn bản thành các nhóm hoặc hạng mục để phát hiện các mẫu hình, tần suất và xu hướng. Ví dụ, khi nghiên cứu hình ảnh thương hiệu, nhà nghiên cứu có thể phân tích hàng trăm bình luận trên mạng xã hội để xác định mức độ xuất hiện của các từ khóa như “giá cả”, “dịch vụ” hay “chất lượng sản phẩm”. Cách làm này giúp biến dữ liệu ngôn ngữ phức tạp thành thông tin có cấu trúc và dễ diễn giải.

Một phương pháp phân tích khác là phân tích chủ đề (Thematic Analysis), vốn tập trung vào việc tìm ra các chủ đề (themes) nổi bật từ dữ liệu. Thay vì chỉ đếm số lần xuất hiện, nhà nghiên cứu đi sâu vào nội dung để khám phá ý nghĩa và mối liên hệ giữa các phát biểu. Ví dụ, trong một nghiên cứu về trải nghiệm học trực tuyến của sinh viên, dữ liệu phỏng vấn có thể hé lộ những chủ đề quan trọng như “tính linh hoạt”, “khó khăn về công nghệ” hay “thiếu sự tương tác trực tiếp với giảng viên”. Những chủ đề này không chỉ phản ánh trải nghiệm thực tế mà còn cung cấp căn cứ cho việc cải thiện chất lượng đào tạo.

Ngoài ra, phân tích diễn ngôn (Discourse Analysis) là phương pháp phân tích nâng cao, đi sâu vào cách ngôn ngữ được sử dụng trong bối cảnh xã hội và chính trị. Thay vì chỉ quan sát nội dung, nhà nghiên cứu xem xét cách thức diễn đạt, cấu trúc ngôn ngữ và ý đồ truyền đạt để tìm ra tầng nghĩa sâu xa. Chẳng hạn, trong nghiên cứu về biến đổi khí hậu, việc phân tích các bài phát biểu của lãnh đạo có thể cho thấy cách họ sử dụng ngôn ngữ để khung hóa vấn đề và tác động đến nhận thức công chúng.

Về ưu điểm, phân tích định tính mang lại khả năng khám phá chiều sâu của hiện tượng, giúp lý giải động cơ, niềm tin và thái độ mà các con số khó diễn đạt. Nó cũng phản ánh được sự phức tạp và tính bối cảnh của hành vi con người. Tuy nhiên, phương pháp phân tích này cũng có những hạn chế như khó khái quát hóa kết quả cho toàn bộ tổng thể, dễ chịu ảnh hưởng bởi quan điểm chủ quan của nhà nghiên cứu, và thường đòi hỏi nhiều thời gian cho việc thu thập cũng như xử lý dữ liệu.

Hướng dẫn lựa chọn phương pháp phân tích phù hợp

Việc lựa chọn phương pháp phân tích dữ liệu phù hợp là một nghệ thuật đòi hỏi sự kết hợp giữa hiểu biết lý thuyết và kinh nghiệm thực tiễn. Quyết định này không chỉ ảnh hưởng trực tiếp đến chất lượng kết quả nghiên cứu mà còn quyết định mức độ thuyết phục và giá trị khoa học của toàn bộ công trình.

Yếu tố đầu tiên cần xem xét là mục tiêu nghiên cứu.

- Nếu mục tiêu là mô tả đặc điểm của mẫu nghiên cứu, thống kê mô tả trong định lượng hoặc phân tích nội dung trong định tính sẽ là những lựa chọn phù hợp.